Page 229 - 《软件学报》2025年第12期

P. 229

5610 软件学报 2025 年第 36 卷第 12 期

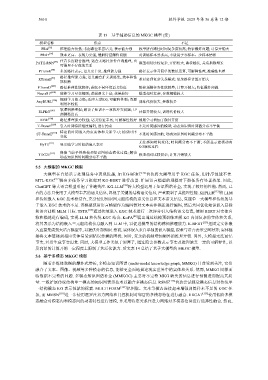

表 13 基于辅助信息的 MKGC 模型 (续)

模型名称 优点 不足

PRA [95] 推理能力较强; 考虑路径丰富语义; 表示能力强 枚举所有路径时间复杂度较高; 特征爆炸问题; 计算开销大

[96]

PRA+ 效率更高、表现力更强, 缓解特征爆炸问题 对训练样本要求高, 不适用于零样本、少样本情形

[97] 任意长度联合推理; 适合无路径条件查询推理, 也

PATH-RNN 模型相对比较复杂, 开销较大, 路径越长, 关系指数增长

可推理不存在的关系

[98]

PTransE 多条路径表示, 语义更丰富, 推理能力强 路径表示学习简单的数值运算, 可解释性差, 准确性也差

路径推理能力强; 语义融合扩充训练集, 效率和性

[99]

RTransE 难以处理复杂关系模式; 复杂路径计算开销大

能权衡

[100]

PTransD 路径推理性能较好; 获取不同环境语义特征 链接预测任务性能较差; 计算开销大; 特征爆炸问题

NeuralLP [101] 能够学习可变规则; 逻辑语义丰富; 效果较好 模型相对复杂; 参数规模较大

[106] 规则学习能力强; 适应大型KG; 可解释性强; 资源

AnyBURL 训练代价较大, 参数较多

利用率较低

[107] 软逻辑推理强; 解决了知识不一致和冲突问题; LP

ELPKG 计算开销较大; 训练代价较大

预测精度高

[108]

RPJE 路径推理能力较强; 语义特征丰富; 可解释性较好 规则学习增加了额外开销

T-TransE [109] 引入时间特征维度编码, 进行约束 不是时间感知的模型; 动态知识图时间戳分布不平衡

[110] 特定的时间嵌入约束实体和关系学习; 捕获时序

ST-TransE 不是时间感知的; 动态知识图时间戳分布不平衡

变化

无法感知时间变化; 时间戳分布不平衡; 不能显示建模动态

HyTE [111] 显示地学习时间的嵌入表示

KG演化过程

保留当前子图结构和知识图动态演化过程; 解决

[112]

TDG2E 模型相对比较复杂; 计算开销较大

动态知识图时间戳分布不平衡

5.5 大模型的 MKGC 模型

大模型在自然语言处理任务中表现优越, 如 KG-BERT [36] 首次将大模型用于 KGC 任务, 但排序性能不佳.

MTL-KGC [37] 提出多任务学习框架对 KG-BERT 进行改善. 扩展语言模型的规模对下游任务有显著效果. 因此,

ChatGPT 等大语言模型引起了普遍关注. KG-LLM [39] 将大模型运用于知识图谱补全, 实现了较好的性能. 然而, 已

有的方法只使用了大模型丰富的语义信息, 忽视了关键的结构语义信息, 严重限制了其推理性能. KEPLER [113] 将 LLM

和传统嵌入 KGC 技术相结合, 充分使用知识图元组结构的语义信息和文本语义信息, 克服单一大模型和传统的基

于嵌入 KGC 技术的不足. 该模型使用语言模型作为编码器对文本实体描述进行编码, 然后共同优化知识嵌入目标

和语言建模 MLM 目标. TSTR [114] 通过传统嵌入 KGC 技术进行二次评分引入结构语义信息, 使用 BERT 对实体名

称和描述进行编码, 实现 LLM 和传统 KGC 结合. KoPA [40] 提出通过结构预训练理解 KG 内部复杂的实体和关系,

将其表示为结构嵌入三元组结构信息融入到 LLM 中, 以促进模型的结构感知推理能力. K-BERT [115] 把固定实体嵌

入直接集成到大语言模型中, 以提供外部知识. 然而, 实体嵌入来自单独的嵌入模型, 很难与语言表示空间对齐; 实体链

接将文本链接到相应实体易受到错误传播的困扰. 同时, 复杂的机制增加额外的推理开销. 另外, 大模型无法回忆

事实, 经常生成事实幻觉. 同时, 大模型工作类似于黑匣子, 通过隐含参数表示事实及推理缺乏一定的可解释性, 以

及高昂的计算开销一定程度上限制了其泛化能力. 后文表 14 总结了基于大模型的 MKGC 模型.

5.6 基于多模态 MKGC 模型

随着多媒体数据的爆炸式增长, 多模态知识图谱 (multi-modal knowledge graph, MMKG) 日益受到关注, 它们

融合了文本、图像、视频等多种模态的信息, 能够更全面地描述现实世界中的实体和关系. 然而, MMKG 同样面

临数据不完整的问题. 多模态知识图谱补全 (MMKGC) 主要对不完整 MKG 缺失的信息进行预测进而提高其质

量. 一般扩展传统结构单一模态的知识图表示技术以融合多模态信息. RSME [116] 首次尝试视觉模态信息对传统单

一结构模态 KG 表示性能的探索. MULTIFORM [117] 把图像、文本等模态连接起来增强训练样本不足的 KGC 任

务, 而 MMSN [118] 进一步使用暹罗注意力网络和门控机制对邻居的多模态特征进行融合. HRGAT [119] 使用低阶多模

态融合对模态内和模态间的动态特性进行建模, 并采用特定关系注意力网络对多模态信息进行选择性融合. 然而,