Page 327 - 《软件学报》2025年第4期

P. 327

陈铂垒 等: 面向具身人工智能的物体目标导航综述 1733

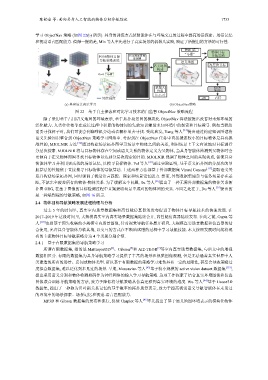

学习 ObjectNav 策略 (如图 22(b) 所示). 具身的训练方式使智能体在与环境交互的过程中提高场景探索、场景记忆

和视觉语言匹配能力. 值得一提的是, Min 等人率先进行了真实场景的机器人实验, 验证了所提出的方法的可行性.

物体目标 物体目标

“马桶”

PONI物体目标 RGB和深度图 导航策略

像观测

导航策略训练

语义地图

语义地图 高层次目标

构建

Goal: “马桶”

机器人 低层次

位姿 规划器

(x, y, o)

势能强度 动作 右转

(a) 具身场景表示学习 (b) ObjectNav策略

图 22 基于自主探索和对比学习技术的自监督 ObjectNav 策略流程

Matterport3D 、Gibson 和

除了采用基于占用语义地图的环境表示, 基于拓扑场景图的模块化 ObjectNav 算法被提出改善对未知环境的

泛化能力. 人类往往依靠在成长过程中积累的物体间的先验知识辅助未知环境中的探索和目标搜寻. 例如当我们

需要寻找杯子时, 我们可能会到咖啡机旁边或者橱柜里去寻找. 受此启发, Yang 等人 [24] 提出通过构建知识图谱将

语义先验知识整合到 ObjectNav 策略学习网络中. 考虑到在 ObjectNav 任务中直接搜索较小的目标物体是具有挑

战性的, MJOLNIR 方法 [42] 通过构建场景拓扑图学习场景中物体之间的关系, 利用场景上下文有效地对目标进行

分层次搜索. MJOLNIR 将与目标物体存在空间或语义关系的物体定义为父物体, 当具身智能体检测到父物体时会

更倾向于在父物体周围寻找目标物体以达到分层次搜索的目的. MJOLNIR 强调了物体之间的共现关系, 促使具身

智能体学习并利用更高效的场景记忆, 以搜寻目标物体. Pal 等人 [42] 通过实验证明, 基于语义拓扑图的分层次的导

航算法的性能优于直接搜寻目标物体的导航算法. 上述两种方法都基于外部数据集 Visual Genome [117] 提取语义关

系并构建场景拓扑图, 同时强调了视觉语言匹配、探索和场景记忆能力. 然而, 外部数据集通常与任务场景存在差

距, 不能完全覆盖所有的物体-物体关系. 为了缓解这个问题, Du 等人 [36] 提出了一种无需外部数据集的物体关系拓

扑图 ORG, 在基于图像的目标检测过程中直接提取场景中成对的物体间的关系. 不同之处在于, Du 等人 [36] 提出的

是一种端到端的导航策略, 如图 16 所示.

2.4 物体目标导航策略发展进程梳理与分析

过去 5 年的时间里, 真实室内场景数据集和高性能仿真器的发布促进了物体目标导航技术的快速发展. 在

2017–2019 年这段时间里, 大规模真实室内真实场景数据集陆续公开, 高性能仿真器陆续发布. 在此之前, Gupta 等

人 [118] 也曾基于预先收集的小规模室内场景图像, 针对视觉导航任务展开研究. 大规模真实场景数据和仿真器的结

合使用, 允许具身智能体身临其境, 以交互的方式在不断地试错的过程中学习导航技能. 本文按照发展时间线将现

有的主流物体目标导航策略分为 4 个类别分别介绍.

2.4.1 基于有限数据集的导航策略学习

[7]

所谓有限数据集, 指的是 [4] [5] AI2-THOR 等室内真实场景数据集, 与后文中的增强

数据相区分. 有限的数据集为具身导航策略学习提供了丰富的场景和视觉图像观测, 但是无法涵盖真实世界中人

类建造的所有的场景、房间或物体类型. 所以基于有限数据的策略学习难免具有一定的局限性, 甚至会导致策略过

度拟合数据集, 难以泛化到未见过的场景. 早期, Mousavian 等人 [43] 基于较小规模的 active vision dataset 数据集 [119] ,

提出采用语义分割和物体检测掩码作为神经网络的输入学习导航策略. 这项工作探索了结合真实环境图像和仿真

图像联合训练导航策略的方法, 致力于降低将导航策略从仿真迁移到真实环境的难度. Wu 等人 [44] 基于 House3D

数据集, 提出了一种称为贝叶斯关系记忆的基于概率的拓扑场景表示, 致力于提高视觉语义导航智能体在未见过

的环境中的场景探索、场景记忆和视觉-语言匹配能力.

MP3D 和 Gibson 数据集的发布和流行, 促使 Chaplot 等人 [45] 率先提出了基于语义地图环境表示的模块化物体