Page 370 - 《软件学报》2025年第12期

P. 370

邱巧燕 等: 局部-全局动态图学习与互补融合的点云配准方法 5751

σ 设置为 0.6、0.8 和 1 进行实验分析. 从表 9 和图 6(b) 中可以

(2) 高斯核参数 σ. 本文经验性地将高斯核参数

看出, 当 σ 较小时, 全局图的构造过于关注少数强相关的点对, 导致信息覆盖范围不足, 限制了全局特征的表达能

σ 设置

力. 当 σ 较大时, 大量低相关性的点对被赋予较高的权重, 反而引入了较多噪声. 因此, 本文将高斯核参数

为 0.8.

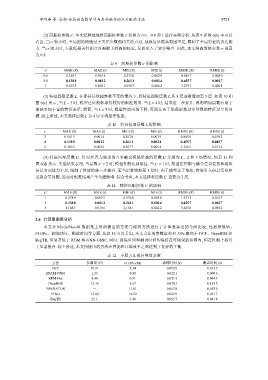

表 9 高斯核参数 σ 的影响

σ MAE (R) MAE (t) MIE (R) MIE (t) RMSE (R) RMSE (t)

0.6 0.140 7 0.001 4 0.276 0 0.002 9 0.546 7 0.008 0

0.8 0.138 8 0.001 2 0.261 1 0.002 4 0.455 7 0.002 7

1 0.365 5 0.003 1 0.698 7 0.006 2 3.279 1 0.020 4

L 从 3 层逐渐增加至 5 层. 如表 10 和

(3) 特征提取层数 L. 在保持其他超参数不变的情况下, 将特征提取层数

图 6(c) 所示, 当 L = 3 时, 模型已经能够取得较好的配准效果. 当 L = 4 时, 结果进一步提升, 说明增加层数有助于

L = 5 时, 模型性能出现下降, 可能是由于堆叠层数过多导致的特征过平滑问

捕获更加丰富的特征表示. 然而, 当

题. 综上所述, 本文选择层数 L 为 4 以实现最佳性能.

L 的影响

表 10 特征提取层数

L MAE (R) MAE (t) MIE (R) MIE (t) RMSE (R) RMSE (t)

3 0.141 5 0.001 4 0.267 8 0.002 9 0.885 0 0.010 2

4 0.138 8 0.001 2 0.261 1 0.002 4 0.455 7 0.002 7

5 0.300 3 0.002 6 0.567 7 0.005 4 1.326 5 0.011 6

′ L 分别为 1、2 和 3 的情况, 如表 11 和

′

(4) 特征匹配层数 L . 针对注意力驱动的互补融合模块堆叠的层数

图 6(d) 所示. 实验结果表明, 当层数 L = 2 时, 模型性能达到最佳. 当 L = 1 时, 模型在挖掘与融合差异信息和相似

′

′

信息方面能力不足, 限制了性能的进一步提升. 而当层数增加至 3 层时, 由于模型过于复杂, 容易引入信息冗余和

L 设置为 2 层.

′

过拟合等问题, 进而对配准结果产生负面影响. 综合考虑, 本文选择将层数

L 的影响

′

表 11 特征匹配层数

L ′ MAE (R) MAE (t) MIE (R) MIE (t) RMSE (R) RMSE (t)

1 0.278 9 0.002 5 0.536 8 0.005 0 1.257 2 0.012 3

2 0.138 8 0.001 2 0.261 1 0.002 4 0.455 7 0.002 7

3 1.104 1 0.010 6 2.134 1 0.022 2 3.829 8 0.038 2

2.6 计算复杂度分析

本文在 ModelNet40 数据集上对所提出的方法与现有方法进行了计算复杂度的全面比较, 包括参数量、

FLOPs、训练时间、测试时间等方面. 从表 12 可以看出, 本文方法的参数量和 FLOPs 略高于 DCP、DeepBBS 和

RegTR, 但显著低于 RGM 和 GNN-GSSC. 同时, 训练时间和测试时间均保持在可接受的范围内, 但在性能上取得

了显著提升. 综上所述, 本文所提出的方法在性能和计算效率之间达到了良好的平衡.

表 12 不同方法的计算复杂度

方法 参数量 (G) FLOPs (M) 训练时间 (s) 测试时间 (s)

DCP 10.91 5.34 0.052 8 0.012 7

IDAM-GNN 1.55 0.09 0.022 1 0.009 6

RPM-Net 8.48 0.91 0.051 9 0.044 3

DeepBBS 13.18 5.67 0.078 3 0.153 3

PREDATOR - 11.01 0.063 8 0.053 0

FINet 15.85 14.22 0.082 9 0.051 7

RegTR 25.1 5.48 0.095 7 0.041 8