Page 223 - 《软件学报》2025年第5期

P. 223

王益民 等: 面向卷积神经网络泛化性和健壮性权衡的标签筛选方法 2123

从表 1 中可知, TLWR 训练能够获得比 Base 模型更好的自然准确度, 且 λ T 为 e 时所得的模型具有最佳的泛

−7

化性能. 此外自然准确度的变化与 λ T 的取值不呈线性关系, 过大或过小的系数甚至会降低模型的泛化能力.

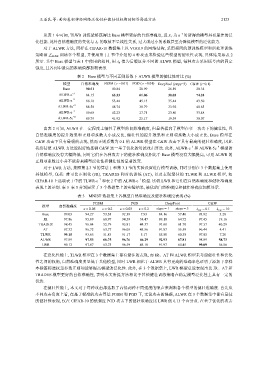

对于 ALWR 方法, 同样在 CIFAR-10 数据集上以 VGG19 的网络结构, 采用相同的预训练模型和后处理训练

策略用 L ALWR 训练多个模型, 并使用第 1.1 节中介绍的 4 种攻击来检验这些模型的健壮性表现, 具体结果如表 2

所示. 其中 Base 模型与表 1 中使用的相同, 用 λ A 值为后缀区分不同的 ALWR 模型, 每种攻击采用括号内的固定

强度, 且各列中最高的准确值都加粗表示.

表 2 Base 模型与不同正则系数下 ALWR 模型的健壮性对比 (%)

模型 自然准确度 FGSM ( ϵ =0.01) PGD ( ϵ =0.01) DeepFool (steps=3) C&W (c=0.1)

Base 90.51 40.84 20.99 26.89 20.34

ALWR-e −1 84.15 63.33 61.06 38.03 74.24

ALWR-e −2 88.18 53.44 45.15 35.44 43.50

ALWR-5e −3 88.50 48.74 38.79 33.92 40.65

ALWR-e −3 89.68 42.23 27.71 23.80 33.48

ALWR-5e −4 89.79 41.92 25.17 19.39 30.07

由表 2 可知, ALWR 在一定程度上牺牲了模型的自然准确度, 但显著提高了模型在任一攻击下的健壮性, 且

自然准确度的提升效果和正则项系数大小成反比, 健壮性的提升效果和正则项系数大小成正比. Base 模型在

C&W 攻击下具有最弱的表现, 然而正则系数为 0.1 的 ALWR 模型在 C&W 攻击下具有最高的健壮准确度, 因此

我们猜想 ALWR 方法能很好地抵御 C&W 这一基于优化的对抗攻击算法. 此外, ALWR-e 和 ALWR-5e 模型的

−4

−3

自然准确度没有大幅降低, 同时它们在各种攻击下的健壮准确度相比于 Base 模型没有大幅提高, 可见 ALWR 的

正则项系数过小并不能带来模型泛化性和健壮性的显著改变.

对于 LWR 方法, 按照第 2.3 节的算法 1 和第 3.1 节的实验设置进行模型训练, 同时分别在 3 个数据集上使用

其他模型, 包括: 雅可比正则化 (JR), TRADES 和对抗训练 (AT), 以及表现最佳的 TLWR 和 ALWR 模型, 如

−7

−1

CIFAR-10 上选取表 1 中的 TLWR-e 和表 2 中的 ALWR-e 模型. 比较 LWR 和它们在自然准确度和健壮准确度

表现上的差别. 表 3–表 5 分别展示了 3 个数据集上的实验结果, 最优的自然准确度和健壮准确度加粗显示.

表 3 MNIST 数据集上各模型自然准确度及健壮准确度表现 (%)

FGSM PGD DeepFool C&W

模型 自然准确度

ϵ = 0.05 ϵ = 0.2 ϵ = 0.05 ϵ = 0.2 steps = 1 steps = 5 λ cw = 0.1 λ cw = 10

Base 99.03 94.27 53.38 92.39 7.93 84.16 57.40 93.92 3.28

JR 97.86 95.09 60.97 94.59 34.47 89.18 64.72 97.45 19.16

TRADES 98.45 96.84 52.79 95.81 44.37 91.68 61.70 97.57 40.29

AT 97.32 96.72 63.77 96.05 45.56 91.87 55.59 96.44 4.41

TLWR 99.15 93.65 51.83 91.17 5.17 85.80 60.38 97.05 7.20

ALWR 97.89 97.53 66.75 96.76 46.29 92.93 67.81 98.89 58.73

LWR 99.12 97.07 63.73 96.59 45.18 91.97 64.45 99.09 56.86

在泛化性能上, TLWR 模型在 3 个数据集上都有最佳的表现, 而 JR、AT 和 ALWR 模型未考虑健壮性和泛化

性之间的权衡, 自然准确度明显低于其他模型, 同时 LWR 相比于 ALWR 具有更高的准确率也证明了添加干净样

本标签筛选权重参数正则项能够提高模型的泛化性. 此外, 在 3 个数据集上, LWR 模型总能表现出比 JR、AT 和

TRADES 模型更好的自然准确性, 表明本文所提方法相比于其他健壮训练策略在稳定模型泛化性上具有一定的

优势.

在健壮性能上, 本文对于每种攻击都选取了高低两种不同强度的噪声来判断各个模型的健壮准确度. 首先从

不同攻击角度上看, 在基于梯度的攻击算法 FGSM 和 PGD 下, 无论攻击的强弱, ALWR 在 3 个数据集中都有最佳

的健壮性表现, 仅在 CIFAR-10 的低强度 PGD 攻击下的健壮准确度比 LWR 低 0.13 个百分点. 在基于优化的攻击