Page 221 - 《软件学报》2025年第5期

P. 221

王益民 等: 面向卷积神经网络泛化性和健壮性权衡的标签筛选方法 2121

具体而言, 对于一个样本 x, 其正确标签和对抗标签大概率是不同的, 那么由这两种标签分别筛选出的模型权

重参数也是不同的, 对两者的权重参数同时进行优化就不会产生冲突. 即使某个样本的两种标签相同, 相应的权重

参数优化也会互相抵消. 因此我们结合上述两种正则化的方式, 在损失函数中同时优化这两个正则项, 以增大正确

标签筛选权重参数向量二范数, 同时降低对抗标签筛选权重参数向量二范数, 即定义损失函数 L LWR 为:

[ ] 2 [ ] 2

∂y T F(x;θ) ∂y A F(x;θ)

L LWR = L CE −λ T +λ A (25)

∂x ∂x

通过设置系数 λ T 和 λ A 来控制两个正则项的优化程度, 即权衡模型最终的泛化性和健壮性. 可以发现, LWR

的损失函数和公式 (10) 所示的雅可比正则化损失函数都是对输出-输入雅可比矩阵的利用, 有一定的相似之处. 区

别在于, 雅可比正则化从对抗样本的泰勒展开出发得出雅可比矩阵对模型训练的意义, 进而设计损失函数对整体

的雅可比矩阵进行优化, 旨在仅提高模型的健壮性. 而 LWR 方法从模型预测过程出发得到雅可比矩阵中对预测

结果起重要影响的部分参数, 突出雅可比矩阵的数学意义, 即向量函数中每个分量相对于其自变量偏导的意义. 因

此只针对关键的而非整体的矩阵元素进行优化, 能够对模型的泛化性和健壮性进行权衡. 同时, LWR 利用标签进

行筛选雅可比矩阵中的元素不会增加模型训练任务的复杂度, 在训练的时间开销上相比于雅可比正则化也更具

优势.

在具体的模型训练策略上, 考虑到模型刚开始训练时没有学习到任何先验知识, 此时在损失函数中添加正则

项很难保证监督损失能够收敛到使模型拥有良好的泛化性能的值上, 进而影响最终模型的泛化性能. 同时, 对抗样

本需要针对模型参数来生成, 无法准确预测干净样本的模型, 其生成的对抗样本的攻击性较弱, 相应的对抗标签并

L CE , 在固定 epochs

不一定是干净样本最容易被误判的分类. 因此, 在训练策略上, 我们仍然使用标准的监督损失

下对网络进行预训练, 在得到稳定的监督损失之后再使用 L LWR 进行训练. 可以认为 LWR 为一种后处理方法, 即

在已经具有一定泛化性能的模型参数基础上优化正确标签和对抗标签分别对应的正则损失, 使模型在训练过程中

能够维持泛化性并提高其健壮性. 算法 1 给出了该训练策略的具体流程, 其中第 9 行为对抗标签的生成方式, 判断

对抗样本预测结果中的每一个元素, 值最大的元素设为 1, 其余元素设为 0, 保证对抗标签为独热编码.

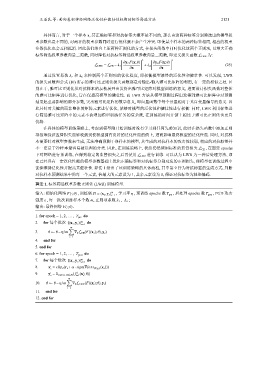

算法 1. 标签筛选权重参数正则化 (LWR) 训练模型.

输入: 初始化网络 F(·;θ) , 训练集 D = (x s ,y s ) N , 学习率 η , 预训练 epochs 数 T pre , 后处理 epochs 数 T post , PGD 攻击

s=1

ϵ , 每一批次训练样本个数 λ A ;

强度 m, 正则项系数 λ T ,

输出: 最终网络 F(·;θ) .

1. for epoch = 1, 2, ... T pre do

,

m

2. for 每个批次 {(x s ,y s )} do

s=1

m ∑

3. θ ← θ −η/m ∇ θ L CE (F((x s );θ),y s )

s=1

4. end for

5. end for

,

6. for epoch = 1, 2, ... T post do

m do

7. for 每个批次 {(x s ,y s )} s=1

′

8. x = clip ϵ (r s +α· sign(∇loss (F;y s ) (x s )))

s

k

′

′

9. y = 1 argmax f(x ′ ;θ) ( f (x ;θ))

s s i=1 s

m ∑

10. θ ← θ −η/m ∇ θ L LWR (F((x i );θ),y i )

i=1

11. end for

12. end for