Page 55 - 《爆炸与冲击》2026年第5期

P. 55

第 46 卷 苏 浩,等: 单晶金属中微孔洞生长过程的深度学习预测方法 第 5 期

施加额外的约束。根据分子模拟得到的单晶中的孔洞生长过程,深度神经网络预测得到的物理量关系

应满足以下假设。

(1) 在单调加载情况下,微孔洞生长过程中孔洞区域的扩大是不可逆的。孔洞生长过程中只能发生

原子填充区域向孔洞区域的转换,这意味着输入物理信息中的孔洞区域在输出物理信息中仍为孔洞区

域。由于统计原因,在很短的时间间隔内,分子模拟实际过程可能发生极少数的孔洞区域向原子填充区

域的转换过程,但从整个孔洞生长过程来看,这一假设是成立的。

(2) 由原子填充区域新转换得到的孔洞区域中不包含原子,因此其局部位错密度和平均 von Mises

应力值应为 0。

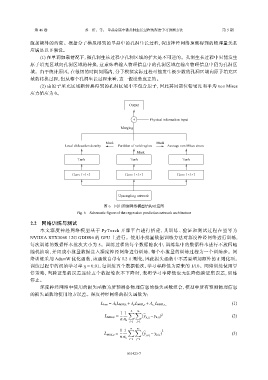

Output

+ Physical information input

Merging

Mask Mask

Local dislocation density Partition of void region Average von Mises stress

Mask

Tanh Tanh Tanh

Conv 1×1×1 Conv 1×1×1 Conv 1×1×1

Upsampling network

图 6 回归预测网络模型结构示意图

Fig. 6 Schematic figure of the regression prediction network architecture

2.2 网络训练与测试

本 文 深 度 神 经 网 络 模 型 基 于 PyTorch 开 源 平 台 进 行 搭 建 , 其 训 练 、 验 证 和 测 试 过 程 在 型 号 为

NVIDIA RTX3060 12G GDDR6 的 GPU 上进行。使用小批量数据训练方法对深度神经网络进行训练,

每次训练的数据样本批次大小为 5。训练过程的每个数据轮次中,训练集中的数据样本进行不放回地

随机抽取,并组成小批量数据送入深度神经网络进行训练,每个小批量的训练过程为一个训练步。网

络训练采用 AdamW 优化函数,该函数自带有 L2 正则化,因此损失函数中不需要增加额外的正则化项。

训练过程中的初始学习率 η = 0.01,每训练五个数据轮次,学习率降低为原来的 1/10。网络训练使用早

停策略,当验证集的误差连续五个数据轮次不下降时,表明学习率降低也无法降低验证集误差,训练

停止。

深度神经网络中使用的损失函数为所预测各物理信息的损失函数组合,模型中所有预测物理信息

的损失函数均使用均方误差。深度神经网络的损失函数为:

(1)

L loss = λ k L MSE,k +λ p L MSE,ρ +λ σ e L MSE,σ e

n n c

1 1 ∑∑ ⌢

L MSE,k = (y k,ij −y k,ij ) 2 (2)

n n c

i=1 j=1

n n c

1 1 ∑∑ ⌢ 2

L MSE,ρ = (y ρ,ij −y ρ,ij ) (3)

n n c

i=1 j=1

051423-7