Page 10 - 《中国医疗器械杂志》2026年第2期

P. 10

Chinese Journal of Medical Instrumentation 2026年 第50卷 第2期

医 疗 机 器 人

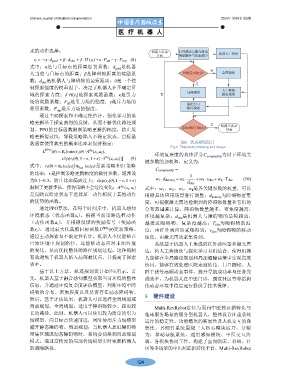

来的动作选择。 机器人运动 红外感应与激光雷达

开始 数据融合与权重调节 改进人工势场

r t = −α·d goal +β·d obs +δ· H (s t )+κ · F att −γ · F rep (8)

式中:α是与目标点的距离惩罚系数;d 是机器

goal 否

人当前与目标点的距离;β是障碍物距离的奖励系 环境是否复杂? 全局规划

数;d 是机器人与障碍物的最短距离;δ是一个控

obs

制探索强度的权重因子,决定了机器人在不确定区 是 人工势场

域的探索力度;δ·H(s )是探索奖励函数;κ是引力 否 局部规划 路径规划

t

场的奖励系数;F 是引力场的强度;γ是斥力场的 强化学习

att

惩罚系数;F 是斥力场的强度。 路径规划

rep

通过主动探索和不确定性估计,强化学习的策

略更新基于探索获得的反馈,从而不断优化路径规 是

划。PPO的目标函数限制策略更新的幅度,防止策 是否到达目标点? 机器人运动

结束

略更新得过快,导致策略陷入不稳定状态。目标函

数通常使用裁剪的概率比率来保持稳定: 图6 轨迹规划设计

Fig.6 Trajectory planning and design

[

π θ

L PPO (θ) = E t min(r t (θ)· A (s t ,a t ),

环境复杂度的总体评分C 为以下环境关

] complexity

clip(r t (θ),1−ϵ,1+ϵ)· A (s t ,a t )) (9)

π θ

/ 键参数的加权和,定义为:

式中: r t (θ) = π θ (a t |s t ) π θ old (a t |s t )是新策略和旧策略

C complexity =

的比率; ϵ是控制策略更新幅度的裁剪参数,通常设

1

为0.1~0.3,防止比率偏离过大; clip(r t (θ),1−ϵ,1+ϵ) w 1 ·d density +w 2 · +w 3 ·v obs +w 4 ·T obs (10)

d obs

限制了更新步长,使得策略不会过度变化; A (s t ,a t ) 式中:w 、w 、w 、w 是各关键参数的权重,可以

π θ

1 2 3 4

是反映在给定状态下选择某一动作相较于其他动作 根据具体应用场景进行调整;d density 为障碍物密集

的优势的函数。 度,可根据激光雷达检测到的障碍物数量和它们的

通过PPO算法,在每个时间步中,机器人感知 分布范围来计算,障碍物数量越多,密集度越高,

环境状态(状态函数s ),根据当前策略选择动作 环境越复杂;d 是机器人与障碍物的最短距离,

t

obs

(动作函数a ),并根据反馈的奖励信号(奖励函 越接近障碍物,复杂度越高;T 为障碍物的温

t

obs

数r ),通过最大化裁剪目标函数 L PPO (θ)更新策略。 度,由红外感应器采集得到;v 为障碍物的移动

t

obs

通过主动探索与不确定性估计,机器人不仅能够在 速度,由激光雷达采集得到。

已知环境中规划路径,还能够动态应对未知环境 系统基于机器人上集成的红外感应器和激光雷

的变化,从而优化整体的路径规划过程。这种机制 达,将人工势场法与强化学习有机结合,使得机器

有效避免了机器人陷入局部最优点,并提高了探索 人能够在全局路径规划和局部避障决策中实现高效

效率。 协同,能够有效处理医院走廊转角、门口拥堵、人

基于以上方法,轨迹规划设计如图6所示。首 群干扰等高频动态事件,提升导航成功率与任务完

先,机器人基于融合感知模型获取当前环境的整体 成效率,为机器人在中医门诊、康复社区等非结构

信息,并通过环境复杂度评估模型,判断环境中障 化动态环境中稳定运行提供了技术保障。

碍物的分布、密集程度以及是否存在动态障碍物。

5 硬件建设

然后,基于评估结果,机器人可以选择全局规划或

局部规划。全局规划:适用于障碍物较少、距离较 Multi-RevRobot定位为面向中医药证据转化与

长的路径。此时,机器人可以使用较为简单的引力 临床服务场景的服务型机器人,整体设计注重系统

场模型,向目标点快速前进,同时使用斥力场模型 运行的稳定性、功能模块的拓展性及人机交互的自

避开静态障碍物。局部规划:当机器人靠近障碍物 然性。其硬件系统围绕三大核心模块展开,分别

密集区域或动态障碍物时,系统会切换到局部规划 为:移动导航系统、通用感知模块、中医交互终

模式,通过高精度的局部势场模型实时更新机器人 端。各模块协同工作,构建了面向临床、科研、社

的避障路径。 区等多场景的中医药证据转化平台。Multi-RevRobot

124