Page 307 - 《软件学报》2025年第10期

P. 307

4704 软件学报 2025 年第 36 卷第 10 期

其中, τ 的大小会影响训练的稳定性, τ 太小更新缓慢, 导致训练速度大大降低.

DMEM 具体步骤如算法 2 所示.

算法 2. DMEM 算法.

N

输入: 离线数据集 D, 采样数量 , 平滑系数 τ;

′ ′

1. 初始化: 策略网络 π(· | ·;ϕ), 评论 V 网络 V ψ , 评论 Q 网络 Q θ 1 和 Q θ 2 , 目标评论 Q 网络 Q(· | ·;θ ) and Q(· | ·;θ )

1 2

2. for 每步迭代 do

′

3. 从数据集 D 采样 N 对 (s,a,r, s ) 样本

4. 从策略 π(· | s) 中采样动作 a 0

V 网络, 见公式 (27)

5. 更新

6. 更新 Q 网络, 见公式 (6)

7. for 每步迭代 do

8. 更新策略网络, 见公式 (33)

9. end for

10. 更新目标网络, 见公式 (34)

11. end for

在 DMEM 中, 输入全局经验池、随机小批量采样样本个数以及平滑系数. 第 1 行初始化策略网络、评估网络

和目标网络. 算法 2 第 3, 4 行, 随机采样 N 组样本, 在 ϕ 参数化下的策略选择动作. 第 5, 6 行, 是评估网络参数的更

新. Q 函数网络参数的更新不涉及数据集外的动作, 但 V 值网络参数的更新, 涉及策略选择的动作. 见算法 2 第

8 行, 通过梯度下降的方式更新策略, 策略参数的更新基于策略梯度方法. 值函数作为策略更新的权重, 同时引入

扩散模型预测噪声的误差. 最后软更新目标网络的参数, 见算法 2 第 10 行.

4 实验分析

4.1 实验环境

D4RL [36] 数据集种类丰富, 包括 Gym-Mujoco、Antmaze、Adroit 等. 其中 MuJoCo 是经典连续控制任务的平

台. Antmaze 环境主要是面向稀疏奖励、无向和多任务数据问题的平台. 且数据是通过随机选择目标位置, 然后使

用计划器生成航点序列来生成的. Antmaze 是一个导航任务, 其目标是训练一个四足智能体, 试图找到起点与目标

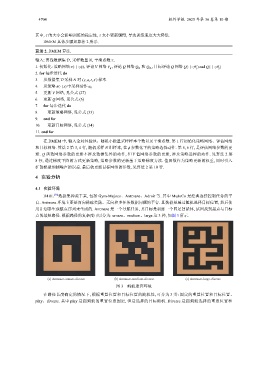

点的最短路径. 根据路径的复杂度可以分为: umaze、medium、large 这 3 种, 如图 3 所示.

(a) Antmaze-umaze-diverse (b) Antmaze-medium-diverse (c) Antmaze-large-diverse

图 3 蚂蚁迷宫环境

在路径长度确定的情况下, 根据重置位置和目标位置的随机性, 可分为 3 类: 固定的重置位置和目标位置、

play、diverse. 其中 play 是指蚂蚁的重置位置固定, 但是选择的目标随机. Diverse 是指蚂蚁选择的重置位置和