Page 306 - 《软件学报》2025年第10期

P. 306

刘全 等: 扩散模型期望最大化的离线强化学习方法 4703

策略引入扩散模型, 而扩散模型中的关键是去噪的参数. 那么值函数 V(s) 的更新也考虑了去噪参数带来的影响.

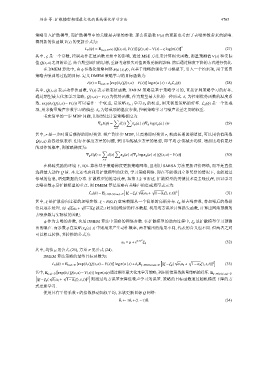

得到新的值函数 V(s) 的更新公式为:

[ ] 2

L V (ψ) = E (s,a)∼D ω τ (Q(s,a),V(s)) Q(s,a)−V(s)−ςlog(π(s)) (27)

其中, ς 是一个常数, 控制动作在值函数更新中的影响. 通过 MSE 方法来计算损失函数, 衡量预测值 V(s) 和实际

值 Q(s,a) 之间的误差. 结合期望回归的思想, 重新考虑损失对值函数更新的影响. 然后通过梯度下降的方式进行优化.

在 DMEM 算法中, 由 ϕ 参数化策略网络 π(a | s;ϕ), 在基于策略的强化学习模型下, 引入一个约束项, 用于惩罚

策略去噪训练过程的目标. 定义 DMEM 策略学习的目标函数为:

[ ]

J(π) = E (s,a)∼D exp(δ 1 (Q(s,a)−V(s)) logπ(a | s)+δ 2 L d (ϕ) (28)

其中, Q(s,a) 表示动作值函数, V(s) 表示状态值函数. DMEM 策略是基于策略学习的, 直接评判策略学习的好坏.

通过期望最大化来学习策略, Q(s,a)−V(s) 为优势函数, 作为期望最大化的一种形式. δ 1 为控制优势函数的温度系

数. exp(δ 1 (Q(s,a)−V(s)) 可以看作一个权重, 是策略 π k+1 学习 π k 的权重, 用来衡量策略的好坏. L d (ϕ) 是一个惩戒

项, 用来衡量噪声参数学习的偏差. δ 2 为惩戒项的温度参数, 控制策略学习与噪声误差之间的权重.

考虑简单的一步 MDP 问题, 用似然比计算策略梯度为:

∑ ∑

∇ ϕ J(ϕ) = d(s) π ϕ (a | s)∇ ϕ logπ ϕ (a | s)r (29)

s∈S

其中, r 是一步时间后获得的即时奖赏. 推广到多步 MDP, 只需将即时奖赏 r, 换成长期的期望值, 可以用价值函数

Q(s,a) 兼容近似表示. 但存在梯度方差的问题, 采用基线减少方差的思想, 即平均 Q 值减去均值. 增加比均值更好

的动作的概率, 则策略梯度为:

∑ ∑

∇ ϕ J(ϕ) = d(s) π ϕ (a | s)∇ ϕ logπ ϕ (a | s)[Q(s,a)−V(s)] (30)

s∈S

在稀疏奖励的环境下, IQL 算法基于策略梯度更新策略网络, 且利用 SARSA 方法更新评价网络, 而不是直接

选择最大动作 Q 值. 本文还考虑利用扩散模型的优势, 学习策略网络. 即在不能得到立即奖赏的情况下, 也能通过

邻域的信息, 增强数据的分布. 扩散模型的推导过程, 如第 3.2 节所述. 扩散模型的关键技术是去噪过程, 所以学习

去噪参数 ϕ 是扩散模型的重点. 则 DMEM 算法策略有关噪声的惩戒项可表示为:

[ √ √ ]

L d (ϕ) = E ξ∼N(0,I),(s,a 0 )∼D ||ξ −ξ ϕ ( α t a 0 + 1− ¯α t ξ), s,t)|| 2 (31)

¯

其中, ξ 是扩散前向过程的加噪参数. ξ ∼ N(0,I) 意味着服从一个简单的高斯分布. ξ ϕ 是去噪参数, 将加噪后的数据

√ √

t

信息逐步处理. 而 ¯ α t a 0 + 1− ¯α t ξ 就是 时刻加噪后的样本数据. 利用均方误差计算损失函数, 计算出网络预测的

去噪参数与实际值的差距.

ϕ 作为去噪的参数, 也是 DMEM 算法中策略的网络参数. 在扩散模型的逆向过程中, ξ ϕ 是扩散模型学习预测

出的噪声. 而参数 ϕ 在策略 π ϕ (a | s) 中则用来产生动作概率, 两者输出的结果不同, 代表的含义也不同. 但两者之间

可以相互转换, 其转换的公式为:

a 0 = µ+e 0.5σ 2 ξ ϕ (32)

µ 见公式 σ 见公式 (24).

其中, 均值 (25), 方差

DMEM 算法策略的最终目标函数为:

[ √ √ ]

[ ]

L π (ϕ) = E (s,a)∼D exp(δ 1 (Q(s,a)−V(s)) logπ(a | s)+δ 2 E ξ∼N(0,I),(s,a 0 )∼D ||ξ −ξ ϕ ( α t a 0 + 1− ¯α t ξ), s,t)|| 2 (33)

¯

[

]

其中, E (s,a)∼D exp(δ 1 (Q(s,a)−V(s)) logπ(a|s) 通过期望最大化来学习策略, 利用价值函数衡量策略的好坏. E ξ∼N(0,I),(s,a 0 )∼D

√ √

[ ]

||ξ −ξ ϕ ( α t a 0 + 1− ¯α t ξ), s,t)|| 2 则通过均方误差来降低噪声学习的误差. 策略的目标函数通过随机梯度下降的方

¯

式更新学习.

使用具有平滑系数 τ 的指数移动加权平均, 来软更新目标 Q 网络:

(34)

¯ θ i ← τθ i +(1−τ) ¯ θ i