Page 183 - 《软件学报》2025年第7期

P. 183

3104 软件学报 2025 年第 36 卷第 7 期

证, 都说明了本文提出的方法在缓解遗忘和保持性能方面的有效性.

5.3 消融实验

本节探究了 GFR-SIR 方法的不同模块对于识别准确率的影响, GFR-SIR 主要由特征蒸馏模块和生成特征重

放模块组成, 本文设置了 4 种方法进行消融实验: 微调 (不使用任何模块)、特征蒸馏、生成特征重放、GFR-SIR

(同时使用特征蒸馏模块和生成特征重放模块).

消融实验结果如表 2 所示, 可以看出在微调方法下识别准确率下降较为显著, 在完成第 1 轮任务的扩展训练

之后, 识别准确率下降到了 22.42%, 说明该方法对于之前学习到的知识的遗忘非常严重. 特征蒸馏方法下识别准

确率下降得到了缓解, 在完成第 1 轮任务的扩展训练之后, 识别准确率仍然达到 86.94%, 相对于模型微调的方法,

该方法的识别准确率在每轮都有了一定的提升. 此外, 从实验结果还可以看出, 随着任务数量的增加, 该方法的识

别准确率下降也越来越大, 在完成 5 轮扩展任务时的识别准确率只有 15.36%. 生成特征重放方法下, 相对于微调

方法和特征蒸馏的方法性能都有了一定的提升, 在完成 5 轮的扩展任务时识别准确率为 34.01%, 说明相对于特征

蒸馏模块, 生成特征重放模块在缓解遗忘方面更有效. 最后, GFR-SIR 方法相对于前面的 3 种方法, 在完成各轮的

扩展任务之后都实现了更高的识别准确率, 说明 GFR-SIR 方法在缓解遗忘方面的有效性. 相对于只有其中一个模

块的方法, 本方法识别准确率提升更大, 本文认为这是因为特征蒸馏模块只缓解了特征提取器的遗忘, 而生成特征

重放则是缓解了分类器的遗忘.

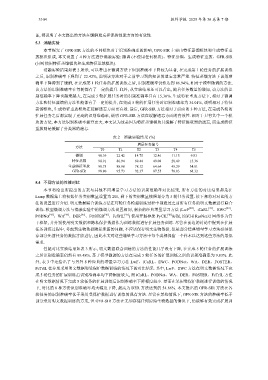

表 2 消融实验结果 (%)

增量任务编号

方法

T0 T1 T2 T3 T4 T5

微调 98.39 22.42 14.75 12.46 11.15 9.83

特征蒸馏 98.91 86.94 69.44 49.08 28.49 15.36

生成特征重放 98.73 88.98 78.12 64.64 45.29 34.01

GFR-SIR 98.80 95.73 92.37 87.55 78.03 68.32

5.4 不同方法的性能对比

本节将给出所提出的方案与其他不同增量学习方法的识别准确率对比结果, 所有方法的对比结果都是在

Lamp 数据集上将初始任务类别数量设置为 200, 剩下的类别数量按照划分为 5 轮任务设置. 接下来将对对比的方

法的设置进行介绍. 明文数据联合训练方法在每轮任务模型训练过程中都通过之前所有任务的明文数据进行联合

训练. 模型微调方法与消融实验中的微调方法设置相同, 剩余的经典增量学习方法 (LwF [40] 、iCaRL [41] 、EWC [42] 、

PODNet [43] 、WA [44] 、DER [45] 、FOSTER [46] 、FeTrIL [47] ) 使用开源框架 PyCIL [48] 实现, 均采用 ResNet32 网络作为骨

干框架, 并分别使用明文数据和隐私保护数据作为训练数据进行扩展任务训练. 尽管在前边的讨论中提到在扩展

任务训练过程中, 考虑到生物数据隐私泄露的问题, 不应该保存明文生物数据, 但是部分经典增量学习方法必须保

存部分先前任务的数据才能进行, 因此本文对这些增量学习方法中每个类都保留一个样本以达到这些方法的最低

需求.

性能对比实验结果如表 3 所示, 明文数据联合训练的方法的性能几乎没有下降, 在完成 5 轮任务的扩展训练

之后识别准确率仍然有 99.48%. 基于模型微调的方法在完成 5 轮任务的扩展训练之后的识别准确率为 9.83%. 此

外, 表 3 中还给出了与另外 8 种经典的增量学习方法 LwF、iCaRL、EWC、PODNet、WA、DER、FOSTER、

FeTrIL 在分别采用明文数据和受保护数据训练的情况下的对比结果. 其中, LwF、EWC 方法在明文数据情况下完

成 5 轮任务的扩展训练后识别准确率均下降幅度较大, 而 iCaRL、PODNet、WA、DER、FOSTER、FeTrIL 方法

在明文数据情况下完成 5 轮任务的扩展训练后识别准确率下降幅度较小. 然而在采用受保护数据进行训练的情况

下, 对比的 8 种方法识别准确率均大幅度下降, 最高为 DER 方法达到的 54.86%. 本文提出的 GFR-SIR 方法在各

轮任务的识别准确率优于采用受保护数据进行训练的现有方法. 尽管在某些情况下, GFR-SIR 方法的准确率低于

部分采用明文数据训练的方案, 但 GFR-SIR 方法在无须存储任何原始生物数据的情况下, 仍能够有效完成扩展训