Page 178 - 《软件学报》2025年第7期

P. 178

赵冬冬 等: 结合特征生成与重放的可扩展安全虹膜识别 3099

便于进行增量任务划分, 本实验中选择左眼数据集的前 400 个类别进行模型的扩展任务实验, 将初始任务类别设

置为 200, 由于在初始任务类别为 200 时剩下类别无法平均分为 3 个任务, 因此为了保持统一, 本文在实验中将剩

下的类别分别按照任务数量为 1、2、4、5 平均划分为不同的任务进行扩展任务. 对于 Thousand 数据集, 则是通

过完整的 1 000 个类别进行扩展任务, 初始任务类别数量设置为 500, 同样将剩下的类别根据不同的任务数量进行

平均划分. 对这两个数据集, 本文以 4:1 的比例划分训练集与测试集.

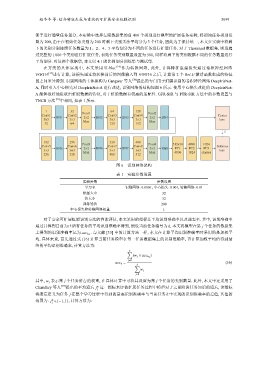

在方法的具体实现中, 本文采用 U-Net [36] 作为转换网络, 此外, 计算特征重建损失通过卷积神经网络

VGG16 [37] 进行计算, 该损失通过将转换前后的图像输入到 VGG16 之后, 计算第 2 个 ReLU 激活函数生成的特征

图之间差异得到. 识别网络的主体架构为 Gangwar 等人 [38] 提出的专门用于虹膜识别的卷积神经网络 DeepIrisNet-

A, 同时引入中心损失对 DeepIrisNet-A 进行改进, 识别网络的结构如图 6 所示. 使用中心损失改进的 DeepIrisNet-

A 能够很好地提取出虹膜数据的特征, 对于虹膜数据有较高的适配性. GFR-SIR 与 PTR-SIR 方法中的参数设置与

TNCB 方法 [31] 中相同, 如表 1 所示.

1 32 64 128

Pool1 Pool2

Conv1 Conv2 Conv3 Conv4 Center

BN1 2×2 BN2 BN3 2×2 BN4

5×5 3×3 3×3 3×3 loss

Max Max

32 64 128 192

λ

+

192 256 320 480

Pool3 Pool4 512×16 4096 1024

Conv5 Conv6 Conv7 Conv8 Softmax

BN5 2×2 BN6 BN7 2×2 BN8 FC1 FC2 FC3

3×3 3×3 3×3 3×3 loss

Max Max 4096 1024 classes

256 320 480 512

图 6 识别网络架构

表 1 实验参数设置

实验参数 参数设置

学习率 识别网络: 0.000 1; 中心损失: 0.001; 转换网络: 0.01

批量大小 32

块大小 32

训练轮次 200

中心损失和转换网络权重 1

对于安全可扩展虹膜识别方法的性能评估, 本文采用的指标是平均识别准确率以及遗忘率. 其中, 识别准确率

j

通过计算到目前为止所有任务的平均识别准确率得到, 假设当前任务编号为 k, 本文将模型在第 个任务的数据集

acc k,j . 与文献 [33] 中的计算方法一样, 本文在计算平均识别准确率时采用的是加权平

上得到的识别准确率记为

均. 具体来说, 首先通过式 (16) 计算当前任务模型在每一任务数据集上的识别准确率, 再计算加权平均值得到最

终的平均识别准确率, 计算方法为:

k ∑

(w j ×acc k,j )

j=0

acc k = (16)

k ∑

w j

j=0

其中, w j 表示第 个任务所占的权重, 在具体计算中可将其设置为第 个任务的类别数量. 此外, 本文中还采用了

j

j

k

Chaudhry 等人 [39] 提出的平均遗忘 f 这一指标来评估扩展任务过程中模型对于之前阶段任务知识的遗忘, 该指标

j

k

将遗忘定义为任务 j 在整个学习过程中得到的最高识别准确率与当前任务 中实现的识别准确率的差值, 其值的

k

范围为: f ∈ [−1,1], 计算方法为:

j