Page 174 - 《软件学报》2025年第7期

P. 174

赵冬冬 等: 结合特征生成与重放的可扩展安全虹膜识别 3095

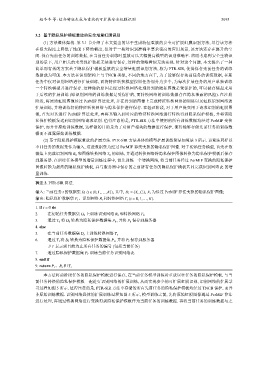

3.2 基于隐私保护模板重放的安全增量虹膜识别

(1) 方法整体架构. 第 3.1 节介绍了本文提出的基于生成特征重放的安全可扩展虹膜识别方法, 尽管该方法

在很大程度上降低了性能下降的幅度, 但对于一些对识别准确率要求很高的应用场景, 该方法还存在提升的空

间. 保存先前任务的训练数据, 在当前任务训练时重放可以大幅提高模型的识别准确率. 然而考虑到安全生物识

别场景下, 用户相关的未受保护数据无法进行保存, 这样的策略看似无法实现. 针对这个问题, 本文提出了一种

简单而有效的方案基于隐私保护模板重放的安全增量虹膜识别方法, 称为 PTR-SIR, 使得保存先前任务的训练

数据成为可能. 本方法在识别架构上与 TNCB 类似, 不同的地方在于, 为了能够保存先前任务的训练数据, 在新

任务中仅对识别网络进行扩展训练, 而将特征转换模型按照任务划分为多个, 为每次扩展任务的用户单独训练

一个转换模型并进行保存. 这样做的原因是经过转换网络处理得到的隐私图像是受保护的, 可以被存储起来用

于后续的扩展训练 (即识别网络的训练数据是受保护的, 而转换网络的训练数据存在隐私泄露的风险). 在注册

阶段, 将原始虹膜图像经过 PerMIF 算法处理, 并在得到的图像上完成特征转换网络的训练以及虹膜识别网络的

扩展训练, 并将训练好的特征转换网络与隐私保护进行保存. 在验证阶段, 对于用户提交用于请求识别的虹膜图

像, 首先对其进行 PerMIF 算法处理, 再将其输入到对应的特征转换网络进行转换得到隐私保护模板, 并将该隐

私保护模板发送到识别网络请求识别. 值得注意的是, PTR-SIR 方法中使用的所有训练数据均经过 PerMIF 变换

保护, 而并非原始训练数据, 这样做的目的是为了对用户相关的数据进行保护, 使得能够存储先前任务的训练数

据而不泄露原始训练数据.

(2) 基于隐私保护模板重放的扩展方法. PTR-SIR 方法具体的模型扩展训练算法如算法 3 所示. 该算法同样以

不同任务的数据集作为输入, 这些数据集为经过 PerMIF 算法变换的隐私保护图像. 对于初始任务模型, 首先在数

据集上完成识别网络 R 0 和图像转换网络 T 0 的训练, 并通过转换网络将隐私保护图像转换为隐私保护模板后保存

到服务器. 在后续任务模型的增量训练过程中, 首先训练一个转换网络, 将当前任务经过 PerMIF 变换的隐私保护

图像转换为最终的隐私保护模板, 并与服务器中保存的之前所有任务的隐私保护模板共同完成识别网络 R t 的增

量训练.

算法 3. PTR-SIR 算法.

,

输入: 当前任务 t 的数据集 D t (t ∈ {0,1,...,K}), 其中, D t = (X t ,C t ) X t 为经过 PerMIF 算法变换的隐私保护图像;

输出: 隐私保护数据集 P t 、识别网络 R t 和转换网络 T t (t = 0,1,...,K).

1. if t = 0 do

2. 在初始任务数据集 D 0 上训练识别网络 R 0 和转换网络 T 0

P 0 保存到服务器

3. 通过 T 0 将 D 0 转换为隐私保护数据集 P 0 , 并将

4. else

5. 在当前任务数据集 D t 上训练转换网络 T t

6. 通过 T t 将 D t 转换为隐私保护数据集 , 并将 P t 保存到服务器

P t

// t 表示到目前为止所有任务的编号 (包括当前任务)

′

7. 通过隐私保护数据集 P t ′ 训练当前任务识别网络 R t

8. end if

9. return P t 、 R t 和 T t

本方法将前阶段任务的隐私保护模板进行保存, 在当前任务模型训练时重放以往任务的隐私保护模板, 与当

前任务转换的隐私保护模板一起进行识别网络的扩展训练, 从而实现安全的可扩展虹膜识别, 识别网络的扩展学

习过程如图 5 所示. 值得注意的是, PTR-SIR 方法中存储的所有先前任务的隐私保护模板均经过 TNCB 保护, 而并

非原始训练数据. 识别网络具体的扩展训练过程如图 5 所示, 模型训练之前, 先将原始虹膜图像通过 PerMIF 算法

进行处理, 再通过转换网络进行变换得到隐私保护模板作为当前任务的训练数据. 再将当前任务的训练数据与之