Page 204 - 《软件学报》2025年第5期

P. 204

2104 软件学报 2025 年第 36 卷第 5 期

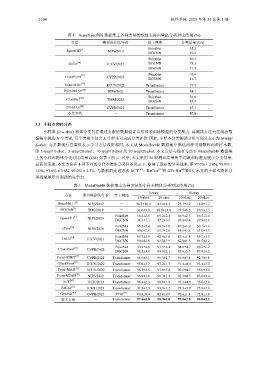

表 4 ScanObjectNN 数据集上各种方法的线性支持向量机分类对比结果 (%)

方法 期刊或会议/年份 骨干网络 分类结果 (OA)

PointNet 55.2

Jigsaw3D [9] NIPS/2019

DGCNN 59.5

PointNet 69.5

OcCo [10] ICCV/2021 DGCNN 78.3

DGCNN 77.9

CrossPoint [13] CVPR/2022 PointNet 75.6

DGCNN 81.7

Point-MAE [19] ECCV/2022 Transformer 77.7

[20]

Point-M2AE NIPS/2022 Transformer 84.1

CrossNet [48] TMM/2023 PointNet 76.8

DGCNN 83.9

I2P-MAE [28] CVPR/2023 Transformer 87.1

本文方法 - Transformer 87.8

3.3 小样本物体分类

小样本 (few-shot) 物体分类旨在通过有限的数据验证自监督预训练模型的分类能力. 其测试方法为在现有数

据集中挑选 N 个类别, 每个类别中包含 K 个样本以完成分类评价. 因此, 小样本分类测试分组可划分表示为 N-way/

K-shot. 与多数现有自监督表示学习方法设定相同, 本文从 ModelNet40 数据集中挑选两种类别数和两种样本数,

即 5-way/10-shot、5-way/20-shot、10-way/10-shot 及 10-way/20-shot. 本文方法与现有方法在 ModelNet40 数据集

上的小样本物体分类对比结果 (OA) 如表 5 所示. 其中, 本文采用 10 轮测试结果的平均数和标准差展示分类结果.

显而易见地, 本文方法在 4 种不同的小样本物体分类任务设定下, 取得了最好的分类效果, 即 97.6% ± 2.0%, 98.9% ±

1.0%, 93.6% ± 3.8%, 96.0% ± 2.2%. 与最新的先进方法 ACT [30] 、ReCon [35] 和 GPr-Net [49] 相比, 本文的小样本物体分

类效果展示出强劲的竞争力.

表 5 ModelNet40 数据集上各种方法的小样本物体分类对比结果 (%)

5-way 10-way

方法 期刊或会议/年份 骨干网络

10-shot 20-shot 10-shot 20-shot

PointNet++ [4] NIPS/2017 - 38.5±16.0 42.4±4.5 23.1±2.2 18.8±1.7

[5]

DGCNN TOG/2019 - 31.6±9.0 40.8±14.6 19.9±6.5 16.9±1.5

[9] PointNet 66.5±2.5 69.2±2.4 56.9±2.5 66.5±1.4

Jigsaw3D NIPS/2019

DGCNN 34.3±1.3 42.2±3.5 26.0±2.4 29.9±2.6

cTree [50] NIPS/2020 PointNet 63.2±3.4 68.9±3.0 49.2±1.9 50.1±1.6

DGCNN 60.0±2.8 65.7±2.6 48.5±1.8 53.0±1.3

OcCo [10] ICCV/2021 PointNet 89.7±1.9 92.4±1.6 83.9±1.8 89.7±1.5

DGCNN 90.6±2.8 92.5±1.9 82.9±1.3 86.5±2.2

CrossPoint [13] CVPR/2022 PointNet 90.9±4.8 93.5±4.4 84.6±4.7 90.2±2.2

DGCNN 92.5±3.0 94.9±2.1 83.6±5.3 87.9±4.2

Point-BERT [17] CVPR/2022 Transformer 94.6±3.1 96.3±2.7 91.0±5.4 92.7±5.1

[21]

MaskPoint ECCV/2022 Transformer 95.0±3.7 97.2±1.7 91.4±4.0 93.4±3.5

Point-MAE [19] ECCV/2022 Transformer 96.3±2.5 97.8±1.8 92.6±4.1 95.0±3.0

[20]

Point-M2AE NIPS/2022 Transformer 96.8±1.8 98.3±1.4 92.3±4.5 95.0±3.0

ACT [30] ICLR/2023 Transformer 96.8±2.3 98.0±1.4 93.3±4.0 95.6±2.8

[35]

ReCon ICML/2023 Transformer 97.3±1.9 98.9±1.2 93.3±3.9 95.8±3.0

GPr-Net [49] CVPR/2023 PNet [51] 80.4±0.6 82.0±0.9 70.4±1.8 72.8±1.8

本文方法 - Transformer 97.6±2.0 98.9±1.0 93.6±3.8 96.0±2.2