Page 43 - 《爆炸与冲击》2026年第5期

P. 43

第 46 卷 刘传志,等: 基于深度学习的亚稳态高熵合金高应变率冲击响应预测 第 5 期

0.35

0.25

0.30 0.20

Normalized true stress 0.20 0.15 Phase volume fraction

0.25

0.15

0.10

0.10

0.05 Prediction 0.05

Ground truth

0 0

0 0.05 0.10 0.15 0.20 0.25 0.30 0.35

True strain

(c) True stress and phase volume fraction

curves for shear

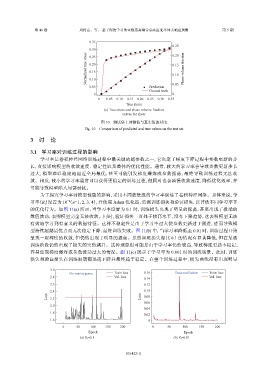

图 10 测试集上预测值与真实值的对比

Fig. 10 Comparison of predicted and true values on the test set

3 讨 论

3.1 学习率对训练过程的影响

学习率是卷积神经网络训练过程中最关键的超参数之一,它决定了梯度下降过程中参数更新的步

长,直接影响模型的收敛速度、稳定性以及整体的优化性能。通常,较大的学习率会导致参数更新步长

过大,模型难以稳定地逼近全局最优,甚至可能引发梯度爆炸或参数振荡,最终导致训练过程无法收

敛。相反,较小的学习率通常可以获得更稳定的训练过程,但同时也会减慢收敛速度,降低优化效率,并

可能导致模型陷入局部最优。

为了探究学习率对模型性能的影响,采用不同数量级的学习率训练了卷积神经网络。具体来说,学

习率(R )设置为 10 (n=1,2,3,4),并使用 Adam 优化器,监测训练损失和验证损失,以评估不同学习率下

−n

l

的优化行为。如图 11(a) 所示,当学习率设置为 0.1 时,训练损失出现了明显的振荡,甚至出现了极端的

数值波动,表明模型完全无法收敛。同时,验证损失一直处于较高水平,没有下降趋势,这表明模型无法

有效地学习到有意义的数据特征。这种不稳定性是由于学习率过大使参数更新过于激进,进而导致模

型持续超越最优点而无法稳定下降,最终训练失败。图 11(b) 中,当学习率降低至 0.01 时,训练过程开始

呈现一定程度的收敛,但仍然出现了明显的振荡。虽然训练损失相比 0.1 的情况有显著降低,但在某些

训练阶段仍然出现了损失的突然飙升。这种现象很可能是由于学习率仍然较高,导致梯度更新不稳定,

容易出现梯度爆炸或参数波动过大的情况。图 11(c) 展示了学习率为 0.001 时的训练场景。此时,训练

损失和验证损失在训练初期都迅速下降并最终趋于稳定。在整个训练过程中,损失曲线没有出现明显

3.0

No-convergence Train loss 0.16 Data oscillation Train loss

2.8 Val. loss Val. loss

0.14

2.6 0.12

2.4 0.10

Loss 2.2 Loss 0.08

0.06

2.0

0.04

1.8

0.02

1.6 0

0 50 100 150 200 0 50 100 150 200

Epoch Epoch

(a) R l =0.1 (b) R l =0.01

051422-11