Page 186 - 《爆炸与冲击》2026年第5期

P. 186

第 46 卷 韩思豪,等: 机器学习驱动的折纸超材料夹芯结构低速冲击响应预测及多目标优化 第 5 期

首先将 3 个关键角度参数 (α, β, θ) 通过线性变换投影到 256 维高维特征空间((α, β, θ)→256 维),随后通

过堆叠的残差特征提取模块进行多层次特征提取(256→512→1 024→512 维)。模块内的残差连接可有

效缓解梯度消失问题,同时增强特征复用。最后由全连接前馈网络回归模块完成高维特征到 128 维冲击

响应(力-时间曲线)的非线性映射(512→256→128 维)。在整个模型中,均使用 LeakyReLU 作为激活函

数以引入非线性并缓解梯度问题,其负斜率参数定义为 0.15。同时,在全连接前馈网络回归模块应用了

Dropout 机制抑制过拟合,并提高模型的泛化能力,其失活率定义为 0.3。

首先利用 Matlab 生成符合正态分布的 2 411 组样本数据,然后使用 Abaqus CAE 2021 调用脚本进

行参数化有限元仿真并提取相应结果数据。在 ResANN 模型的训练中,数据集按比例划分为:训练集

1 600 组、验证集 400 组和测试集 411 组。如图 5(b) 所示,训练过程中训练集(蓝色曲线)和验证集(红

色曲线)的 Smooth L loss [27] 值均在大约 1 500 轮次训练之后趋于稳定并一致。这表明训练过程中没有出

1

现过拟合或欠拟合的现象。为定量评估模型性能,相关系数 R 被用来对 ResANN 在测试集上的预测表

2

现进行评价。结果表明,预测数据与仿真数据高度吻合,对应的 Smooth L loss 为 393.052,R 为 2 0.990 6,

1

充分说明了预测模型的准确性。图 5(c) 进一步描述了测试集上预测值与仿真值的数据分布对比。可

见二者分布形态近乎一致,进一步证明了 ResANN 优异的预测精度。此外,在计算效率方面,训练好

的 ResANN 完成 411 组数据预测仅需 2.14 s。与此相比,单次有限元数值仿真耗时约 5 267 s。因此,模

型在计算速度上实现了大幅的提升。模型训练过程中使用的主要超参数设置如下:批大小为 16,优化

−4

器选用 AdamW [28] ,初始学习率为 5×10 ,权重衰减系数为 1×10 ,总训练轮次为 2 000。这些超参数均

−4

通过试错决定,其余超参数则保持 PyTorch 框架的默认设置。所提出 ResANN 模型的伪代码见图 6 和

图 7。

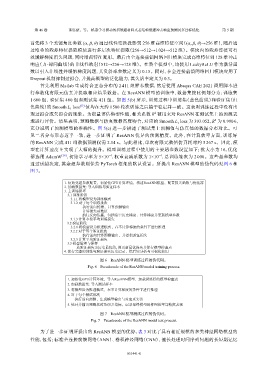

1. 初始化超参数配置,初始化GPU计算环境,构建ResANN模型,配置损失函数与优化器

2. 加载数据集: 导入训练与验证样本

3. 主训练循环

3.1 训练阶段

3.1.1 将模型设为训练模式

3.1.2 对于每个训练批次

执行前向传播,计算预测输出

计算损失函数值

执行反向传播,包括清空历史梯度、计算梯度并更新模型参数

3.1.3 计算本轮平均训练损失

3.2 验证阶段

3.2.1 将模型设为推理模式,在不计算梯度的条件下进行推理

3.2.2 对于每个验证批次

执行前向计算预测输出,并累积验证损失

3.2.3 计算平均验证损失

3.3 模型管理与保存

若验证损失为历史最优值, 则更新最优损失并保存模型检查点

4. 保存完整的训练与验证损失历史记录,供后续分析与可视化使用

图 6 ResANN 模型训练过程的伪代码。

Fig. 6 Pseudocode of the ResANN model training process.

1. 初始化GPU计算环境,导入ResANN模型,加载训练好的模型检查点

2. 加载数据集: 导入测试样本

3. 将模型设为推理模式,在不计算梯度的条件下进行推理

4. 对于每个测试批次

执行前向预测,生成模型输出与对应真实值

5. 统计并输出预测耗时及误差指标,记录最终模型的推理效率与精度表现

图 7 ResANN 模型测试过程的伪代码。

Fig. 7 Pseudocode of the ResANN model test process.

为了进一步证明所提出的 ResANN 模型的优势,表 3 对比了具有相近规模的多类神经网络模型的

性能,包括:标准全连接前馈网络(ANN)、卷积神经网络(CNN)、擅长处理时间序列问题的长短期记忆

051441-8