Page 236 - 《软件学报》2025年第9期

P. 236

郝志峰 等: 基于增强条件独立性检验的鲁棒因果发现算法 4147

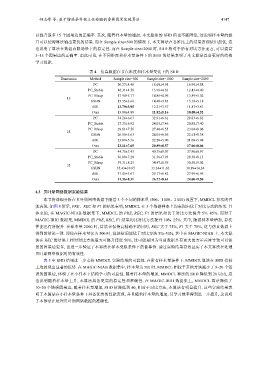

以提升最多 15 个因果边的正确率. 其次, 随着样本量的增加, 本文算法的 SHD 值也不断降低, 这说明样本量的提

升可以使得算法输出更优的结果. 而在 Sample size=500 的情况下, 本文算法在各维度上的结果表现依旧最优, 这

也说明了算法在数据有限场景下的稳定性. 而在 Sample size=2000 时, SHD 相对于所有对比方法而言, 可以提高

5–15 个因果边的正确率. 由此可见, 在不同维度和样本量条件下的 SHD 的结果表明了本文算法具备更好的结构

学习性能.

表 4 仿真数据在节点维度和样本量变化下的 SHD

Dimension Method Sample size=500 Sample size=1000 Sample size=2000

PC 20.27±4.48 18.60±4.98 16.99±4.88

PC_Stable 16.31±4.58 13.96±4.63 12.43±4.40

PC_Maxp 17.94±5.17 14.86±4.96 13.89±5.02

15

GSBN 15.55±3.66 14.40±3.85 13.18±5.18

ADL 13.79±3.95 12.21±3.57 11.87±3.81

Ours 13.88±4.89 11.82±5.16 10.08±4.52

PC 34.26±6.67 32.91±6.61 29.83±6.81

PC_Stable 27.35±6.92 24.03±7.46 20.88±7.40

PC_Maxp 29.61±7.56 27.40±6.55 23.04±8.06

25

GSBN 26.18±5.63 24.05±8.56 22.61±8.38

ADL 23.89±5.56 22.20±5.90 21.08±5.08

Ours 23.11±7.65 20.89±8.57 17.06±8.06

PC 44.75±7.43 40.75±8.07 37.90±8.97

PC_Stable 36.09±7.28 31.36±7.93 28.38±8.13

PC_Maxp 39.31±8.25 34.47±8.59 30.50±9.02

35

GSBN 35.43±10.65 33.24±11.62 30.89±14.24

ADL 31.45±5.67 29.17±6.82 27.99±6.95

Ours 31.36±8.31 26.72±8.61 24.00±9.50

4.3 贝叶斯网络数据实验结果

本节将详细分析在贝叶斯网络数据下随着 3 个不同的样本量 (500、1 000、2 000) 设置下, MMDCL 算法的性

能表现. 如图 8 所示, PRE、REC 和 F1 的结果表明, MMDCL 在 3 个数据样本上均表现出优于对比方法的结果. 具

体来说, 在 MAGIC-NIAB 数据集下, MMDCL 的 PRE, REC, F1 的结果相比于对比方法提升 5%–45%. 而对于

MAGIC-IRRI 数据集, MMDCL 的 PRE, REC, F1 结果均比对比方法提升 10%–25%. 其中, 随着样本量增加, 算法

性能也有所提升. 在样本量 2 000 时, 算法在保持高精确率的同时, REC 大于 75%, F1 大于 70%, 这与仿真数据上

得到的结论一致. 即使在样本量仅为 500 时, 算法依旧能优于对比方法 5%–30%, 其中在 MAGIC-NIAB 上, 本文算

法在 REC 的结果上相对对比方法最大可提升接近 50%, 这可能是因为当前数据具有更大的方差差异导致可以恢

复的因果边更多, 也进一步验证了本算法在样本受限条件下的鲁棒性. 通过实验结果有效证实了本文算法在处理

贝叶斯网络数据时的有效性.

表 5 中 SHD 结果进一步支持 MMDCL 实验结果的可靠性. 在所有样本量条件下, MMDCL 算法在 SHD 指标

上均展现出显著的优势. 在 MAGIC-NIAB 数据集中, 样本量为 500 时, MMDCL 相较于其他方法减少了 8–20 个错

误的因果边, 体现了在小样本下结构学习的可靠性. 随着样本量的增加, MMDCL 算法的 SHD 降低到 20 以内, 这

也说明随着样本量上升, 本算法具备更高的稳定性和准确性. 在 MAGIC-IRRI 数据集上, MMDCL 算法降低了

10–20 个错误因果边, 随着样本量增加, SHD 值降低到 40, 相对于对比方法, 本算法有明显提升. 这些实验结果表

明了本算法在小样本量条件下具备优秀的性能表现, 并且随着样本量的增加, 其学习效率得到进一步提升, 这说明

了本算法在处理贝叶斯网络数据的准确性.