Page 345 - 《软件学报》2025年第7期

P. 345

3266 软件学报 2025 年第 36 卷第 7 期

MNIST→USPS 任务中, 当一致性正则化损失项前的权重因子 λ t 的值为 0.01 时, 模型的分类性能急剧下降, 其准确

率为 85.9%. 在相同任务中, 当 MK-MMD 度量损失项前的权重因子 λ d 的系数为 2 时, 模型的分类性能较低, 其准

确率为 88.3%. 但当抛开两个相对极端的系数值时, 我们从中可以观察到, 超参数的值在 0.1–1 的范围内准确性以

稳定的方式逐步增长.

由于模型在不同参数下的运行比较稳定, 所以在整个实验过程中选择固定超参数 λ t = 1 和 λ d = 1 来获得最佳

性能. 实验证明本文所提出的模型在超参数上具有泛化性, 同样也进一步验证了 A-UDA 算法的鲁棒性.

3.4 消融实验

为了更好地验证 A-UDA 方法中每部分的有效性, 本节在数字分类数据集上设置 4 组对比实验, 使用准确率

的平均值和标准差, 对 A-UDA 方法中各个损失项的有效性进行验证. 各个实验的设置如下.

(1) 实验 1. l s : 源域交叉熵分类损失;

(2) 实验 2. l s +l d : 源域交叉熵分类损失和 MK-MMD 度量损失;

(3) 实验 3. l s +l t : 源域交叉熵分类损失, 一致性正则化损失;

(4) 实验 4. l s +l t +l d : 源域交叉熵分类损失, 一致性正则化损失和 MK-MMD 度量损失, 即 A-UDA 方法.

各种方法的消融实验对比结果如表 7 所示.

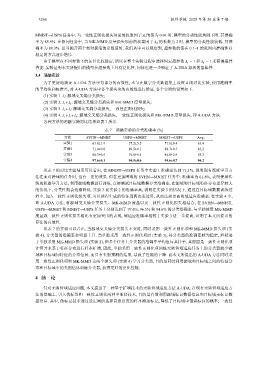

表 7 消融实验的分类准确率 (%)

方法 SVHN→MNIST USPS→MNIST MNIST→USPS Avg.

实验1 61.8±1.9 57.2±5.5 71.1±0.4 63.4

实验2 71.4±0.8 89.5±0.1 88.7±0.7 83.2

实验3 88.3±0.5 76.8±9.4 84.8±2.9 83.3

实验4 97.6±0.1 96.5±0.6 94.6±0.7 96.2

从表 7 的对比实验结果可以看出, 在 MNIST→USPS 任务中实验 1 准确率达到 71.1%, 说明现有深度学习方

法在面对跨域的任务时, 也有一定的效果. 但在更加困难的 SVHN→MNIST 任务中, 准确率为 61.8%, 表明使用传

统的机器学习方法, 利用源域数据进行训练, 直接测试目标域数据分类准确率, 在源域和目标域特征分布差异较大

的情况下, 分类性能会逐渐降低. 实验 3 比实验 2 的准确率高, 说明在实验 3 的情况下, 通过在目标域数据训练过

程中, 加入一致性正则化损失项, 可以使得生成的特征远离决策边界, 从而达到更高的域适应准确率. 在实验 4 中,

即 A-UDA 方法, 将源域交叉熵分类损失、MK-MMD 度量以及一致性正则化损失相结合, 在 SVHN→MNIST,

USPS→MNIST 和 MNIST→USPS 任务上分别达到了 97.6%, 96.5% 和 94.6% 的分类准确率. 与单独使用 MK-MMD

度量或一致性正则化损失相比有更加突出的表现, 域适应准确率相较于实验 3 进一步提高, 证明了本文所提出的

算法的有效性.

从表 7 的实验可以看出, 当源域交叉熵分类损失不变时, 同时采用一致性正则化项和 MK-MMD 损失项 (实

验 4), 分类器的准确率会明显上升. 当单独采用一致性正则化项时 (实验 3), 其分类器的准确率较为稳定, 但稍逊

于单独采用 MK-MMD 损失项 (实验 2), 但多个任务上分类器的准确率平均值与其持平. 其原因是一致性正则化项

计算并未基于特征分布进行样本扩增, 因此, 单独采用一致性正则化项训练无监督域适应任务上的分类器缺少源

域和目标域间特征的分布信息, 而只有类别预测的结果, 导致了性能的下降. 而本文所提出的 A-UDA 方法同时采

用一致性正则化项和 MK-MMD 这两个损失项 (实验 4) 学习分类器, 目的是同时利用源域和目标域之间的特征分

布和目标域中的类别信息训练分类器, 获得更好的泛化性能.

4 结 论

针对无监督域适应问题, 本文提出了一种基于扩增技术的无监督域适应方法 A-UDA. 在现有无监督域适应方

法的基础上, 引入伪标签和一致性正则化两种半监督技术, 目的是有效利用源域标记数据信息和目标域无标记数

据信息. 其中, 伪标记技术通过设定阈值选择高置信度的样本添加标记, 降低了目标域中错误标注的概率; 一致性