Page 411 - 《软件学报》2025年第4期

P. 411

邹慧琪 等: 基于图神经网络的复杂时空数据挖掘方法综述 1817

z t = S ((I + ˆ A)[x t ,h t−1 ]EW z + Eb z ) (3)

r t = S ((I + ˆ A)[x t ,h t−1 ]EW r + Eb r ) (4)

c t = tanh((I + ˆ A)[x t ,r t ⊙h t−1 ]EW c + Eb c ) (5)

(6)

h t = z t ⊙h t−1 +(1−z t )⊙c t

t

t

t

t

其中, z t 表示 时刻的更新门, r t 代表 时刻的复位门, h t 表示 时刻的隐藏状态, [·] 表示连接操作, c t 表示 时刻的

E 是用来表示节点嵌入的可学习的矩阵, 用于自适应

存储单元, W 和 b 分别表示各个门中待训练的权重和偏置,

学习, A 是邻接矩阵, D 是度矩阵, S 是激活函数. 与其他时空融合模型类似, DeepSTUQ 可用于交通预测, 并可以

被集成于其他更复杂的时空融合架构中. 然而, DeepSTUQ 在建模时没有考虑到不同尺度交通数据的时空特征, 这

制约了它对于时空信息的深度挖掘能力.

值得注意的是, 虽然近年来基于图卷积神经网络的时空融合架构中集成时间特征和空间特征的方法有所不

同, 但是现有主流方法中有不少研究是基于 GCN 变体和时间序列预测方法通过模块堆叠或耦合的方式进行融合.

(2) 基于注意力机制的时空融合架构

(3) 基于图卷积神经网络和注意力机制结合的时空融合架构

虽然基于图卷积神经网络的时空融合架构在不同的时空预测任务上取得了较好的效果, 但它仍存在两个主要

的缺陷: 1) GCN 在建模图时对于图的处理是静态的, 没有考虑到图结构的变化, 这使得基于固定图结构训练得到

的模型在其他图结构上泛化能力不高. 虽然有些方法通过采用自适应学习等方法, 在一定程度上解决了这个问题,

但是将提取空间层面和时间层面信息的组件融合后, 模型的运算成本也随之升高. 2) GCN 各个邻居节点的权重只

和度有关, 而没有考虑到其他因素对节点重要性的影响, 这导致了该类模型对节点的表达能力不足, 影响了后续对

时空特征的挖掘性能. 因此, 除了图卷积神经网络, 另一种应用广泛的时空融合架构采用了注意力机制提取空间层

面信息, 其中, 图注意网络 (GAT) [12] 是一种较为主流的选择.

随着时间和空间组件结构变得复杂或单元组件数量的增加, 基于模块堆叠或耦合的方法需要训练的参数量不

[9]

断累积. 与堆叠或耦合方法不同, Lu 等人 [11] 提出的 ST-GFSL 结合元学习的方法, 在时间域上采用 GRU 的方法,

在空间域上采用 GAT [12] 的方法, 并以数据驱动的方式对时间元知识学习件和空间元知识学习件进行加权和, 最终

得到时空融合后的元知识学习件. 该方法中时间组件和空间组件中的参数是独立的, 可以在很大程度上减少需要

训练的参数量, 并通过元学习的方法在一定程度上解决了跨城市数据分布偏差的问题, 在进行跨城市时空数据的

特征迁移学习时表现更佳. ST-GFSL 中使用的时空融合过程可通过公式 (7) 进行表示:

sp

γ

tp

Z MK = W (γ ⊙Z +(1−γ)⊙Z ) (7)

⊙ 表示 Hadamard Z MK Z tp Z sp 分别表示时间元知识学习件和空间元知识学

其中, 积, 表示了时空元知识学习件, 和

sp

sp

sp

sp

tp tp tp tp tp 是 Z = (z ,z ,...,z ) , 节点级空

习件, Z = (z ,z ,...,z ) , 节点级时间元知识 z GRU 隐藏状态的最后一个输出;

1 2 N i 1 2 N

间元知识 z sp 通过独立执行 K 次注意力机制并取平均获得.

i

然而, 在进行不同城市的知识迁移时图可能会产生结构偏差, ST-GFSL 在可解释性等方面仍有提升的空间.

总的来说, 虽然注意力机制在处理动态图时具有很多优点, 但它也存在一些潜在的缺点和限制, 比如计算复杂

和随机性较高. 在运用注意力机制时, 大多数方法中都需要计算每个节点与其他节点之间的注意力权重, 这增加了

计算开销, 限制了注意力机制在大规模图上的应用. 此外, 用于训练的注意力权重是随机初始化的, 经过不同的训

练运行, 模型的性能可能会有所不同, 为获得可靠的结果, 需要进行多次训练和验证.

除了基于图卷积神经网络的时空融合架构和基于注意力机制的时空融合架构, 还有一类时空融合架构结合了

图卷积神经网络和注意力机制, 它们兼具了图卷积神经网络计算简便、鲁棒性高和注意力机制能够更好地学习节

点的不同特征的特点.

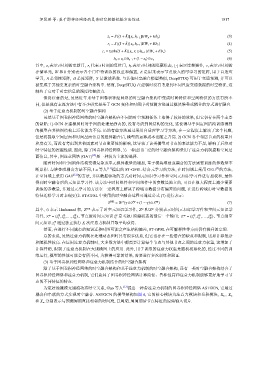

为更好地建模交通流动态时空关系, Guo 等人 [13] 提出一种带注意力机制的图卷积神经网络 ASTGCN, 它通过

耦合和串联的方式实现时空融合. ASTGCN 的模型架构如图 4, 它的核心模块为注意力模块和卷积模块, X h , X d

和 X w 分别表示与预测周期直接相邻的时间段, 日周期, 周周期后节点特征的原始输入切片.