Page 328 - 《软件学报》2020年第11期

P. 328

李阳 等:基于对象位置线索的弱监督图像语义分割方法 3643

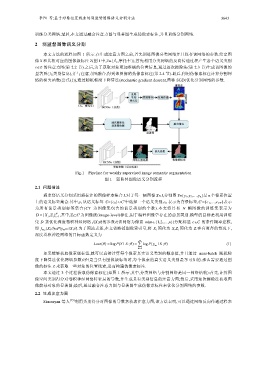

训练分类网络.最后,本文通过融合注意力图与显著图生成伪像素标注,并且训练分割网络.

2 弱监督图像语义分割

本文方法的流程如图 1 所示.在生成注意力图之前,首先训练图像分类网络并且保存该网络的参数.给定图

像 X 和其相对应的图像级标注 Z(图 1 中,Z={人,摩托车}),首先利用分类网络的反向传递过程产生各个语义类别

c∈Z 的注意力图(第 2.2 节).之后,为了获取对象更加准确的位置信息,通过逐次擦除法(第 2.3 节)生成该图像的

显著图(无类别信息),并与注意力图融合,得到该图像的伪像素标注(第 2.4 节).最后,利用伪像素标注计算分割网

络的损失函数(公式(1)),通过随机梯度下降算法(stochastic gradient descent,简称 SGD)优化分割网络的参数.

Fig.1 Pipeline for weakly supervised image semantic segmentation

图 1 弱监督图像语义分割流程

2.1 问题描述

弱监督语义分割采用弱标注的图像样本集合 I.对于每一幅图像 X∈I,分割图 Y={y 1 ,y 2 ,…,y n }是 n 个像素位置

上的语义标签集合.其中,y i 从语义标签 C={c 0 }∪C′中选择一个语义类别,c 0 表示为背景标签,C′={c 1 ,…,c CT }表示

为所有前景类别标签集合(CT 为图像集包含的前景类别的个数).本文将具有 N 幅图像的训练集表示为

D = {X i , }Z i i= N 1 ,其中,Z i ⊂C′为图像级(image-level)标注,用于编码图像中存在的前景类别.模型的目标是利用训练

集 D 来优化深度卷积神经网络 f(X;θ)的参数θ,该网络为像素 m(m∈{1,2,…,n})分配标签 c∈C 的条件概率建模,

即 f m,c (X;θ)=P(y m =c|X;θ).为了简洁表述,本文省略掉图像索引号,将 X i 简化为 X,Z i 简化为 Z.在有监督的情况下,

深度卷积神经网络的目标函数定义为

n

Loss ()θ = log ( |P Y X ; )θ ∑ log (P y m | X ; )θ = (1)

m= 1

如果能够获取像素级标签,就可以直接计算每个像素真实语义类别的概率值,并且通过 mini-batch 随机梯

度下降算法优化网络参数θ.但是当只有图像级标签时,每个像素的真实语义类别是不可知的.那么需要通过图

像的标注 Z 来获取一些对象的位置线索,进而构建伪像素标注.

本文通过 3 个过程获取伪像素标注(如图 1 所示,其中,分类网络与分割网络是同一网络结构):首先,计算图

像空间类别得分对卷积神经网络特征层的导数,并生成具有类别信息的注意力图;然后,采用逐次擦除法获取图

像前景对象的显著图;最后,通过融合注意力图与显著图生成伪像素标注来优化分割网络的参数.

2.2 生成注意力图

Simonyan 等人 [25] 利用类别得分对图像的导数来获取注意力图,该方法表明,可以通过网络反向传递过程来