Page 24 - 《软件学报》2020年第9期

P. 24

葛道辉 等:轻量级神经网络架构综述 2645

Liu 等人 [75] 提出了另一种基于进化算法的搜索策略,设计了分层的搜索空间.在每次迭代中,突变操作都会

选择要修改的层次以及对该层次的修改.该种群由 200 个小的基因型初始化,这些基因型通过应用 1 000 个随机

突变增加种群的多样性.此外,对父代中的个体采用利用锦标赛算法(5%的种群数量)进行选择,并且在进化过程

中不会移除任何个体.该方法中,突变可以执行添加、改变和删除基因型等操作.

Real 等人 [54] 的后续工作是在使用进化算法进行神经网络架构搜索方面最重要的工作之一,该方法主要用

于发现 AmoebaNet-B 和 AmoebaNet-C 神经网络架构,它在具有不同规模大小的 CIFAR-10 和 ImageNet 数据集

上的图像分类任务创造了新的记录,超过了人工设计的深度神经网络模型的性能.然而,在该方法的搜索过程共

使用了 3 150 个 GPU 小时,并且可以在 NasNet 搜索空间上执行,并使用锦标赛选择算法在每次迭代中选择父代

个体.所选择的个体在正常块或降维块的操作或连接中随机改变而发生突变,并训练 25 个周期.与之前的工作

相反,该算法不仅仅依赖于性能评估策略的准确性,而且还包括了个体存在的时间.这有助于抑制重复选择表现

良好的突变模型并为种群引入多样性,其等价于为目标函数添加了一个正则化约束,确保搜索到的神经网络架

构不仅能够一次性能评估具有高精度,而且每次评估都具有高性能.

之前讨论的基于进化算法的搜索策略主要关注点的是找到一个忽略 GPU 预算限制的良好性能架构.这些

方法中使用的最短搜索时间仍然需要 17 个 GPU天.接下来讨论的两项工作更关注搜索效率,将搜索时间缩短到

1 个 GPU 天以内,并提供了可比较的结果.实现这一目标的关键是不同突变的组合,这些突变是功能保持转换和

更具侵略性的贪婪策略.

Elsken 等人 [76] 提出了一种简单而有效的进化算法实现搜索,其灵感来自于功能保持变换.该方法采用精英

选择策略来选择父代,用功能保持突变产生 8 个不同的后代,并且每个后代训练 17 个周期.初始的神经网络架构

包括 3 个卷积层和两个最大池化层.如前所述,功能保持转换操作显著地减少了每个神经网络架构的训练时间,

从而缩短了整个搜索过程的持续时间.

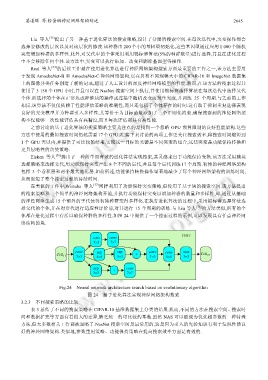

在类似的工作中,Wistuba 等人 [77] 同样利用了功能保持突变策略,但使用了基于块的搜索空间.该方法提出

的搜索策略从一个简单的神经网络架构开始,并执行功能保持突变以增加种群的数量和多样性,即,通过从基础

的神经网络生成 15 个额外的子代使得初始种群变得多样化.在执行进化算法的过程中,采用锦标赛选择算法选

择父代的个体,并在对后代进行适应性评价前,对其进行 15 个周期的训练.与 Liu 等人 [75] 的方法类似,所有的个

体都在进化过程中存活以确保种群的多样性.如图 24 中提供了一个搜索过程的示例,可以发现具有任意神经网

络结构的块.

Cell i

conv conv

3 3 7 7

conv sep sep conv conv max

3 3 5 5 3 3 3 3 5 5 3 3

Cell i-1 + Cell i+1

sep + conv

3 3 7 7

Fig.24 Neural network architecture search based on evolutionary algorithm

图 24 基于进化算法实现神经网络架构搜索

3.2.3 不同搜索策略的比较

表 3 总结了不同的搜索策略在 CIFAR-10 基准数据集上分类的结果.然而,不同的方法在搜索空间、搜索时

间和数据扩充等方面有着很大的差异,缺乏统一的可比较的基准.虽然 NAS 可以被视为优化超参数的一种特殊

方法,但大多数相关工作都被忽略了.NasNet 搜索空间是最常用的,这是因为引入的先验知识有利于发现性能良

好的神经网络架构.类似地,参数重用策略、功能保持策略在提高搜索效率方面是有效的.