Page 22 - 《软件学报》2020年第9期

P. 22

葛道辉 等:轻量级神经网络架构综述 2643

并使用递归神经网络(recurrent neural network,简称 RNN)对其进行建模,如图 20 所示.

Softmax 滤波 滤波 步长 步长 滤波器的

高度 宽度 高度 宽度 数量

隐状态

编码器

Fig.20 Autoregressive control structure

图 20 自动回归控制结构

在每次迭代中,每个动作以服从某一概率分布在搜索空间中采样,按序连接并传输到下一次迭代中.通过性

能评估策略(第 3.3 节中介绍)度量预测神经网络架构的性能,并根据强化更新规则更新控制器的参数:

⎡ T ⎤

t ⎥∑

(

E π ∇ θ ⎢ lnπα t | )s G .

θ

t

⎣ t= 0 ⎦

[6]

学者们同样研究了基于块的搜索空间下的策略梯度控制器.NasNet 定义了递归网络控制器,该控制器顺

序地确定搜索空间内预定义数量的块结构的输入和动作.Cai 等人 [60] 提出了不同动作空间的控制器,并采用强

化学习算法训练.该方法需要一个初始框架,通过 Chen 等人 [72] 提出的方法加宽或加深神经网络,虽然神经网络

架构发生了变化,但是它学习到的功能仍然保持不变.

3.2.2 基于进化算法的优化策略

进化算法(evolutionary algorithm,简称 EA)是基于种群的全局优化算法,包括初始化、父选择 [73] 、重组和突

变、种群选择等基本组件.初始化定义了如何生成初始种群,初始化后,优化器通过反复迭代以下步骤直到种群

收敛:

(1) 从种群中选择父节点进行迭代;

(2) 应用重组和变异操作来创建新的个体;

(3) 评估新个体的适应度;

(4) 选择合适的个体.

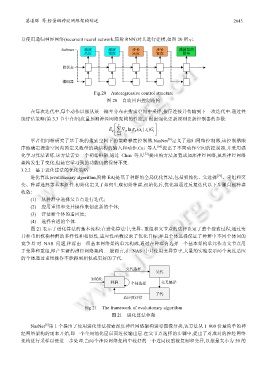

图 21 表示了进化算法的基本流程:在进化算法中,变异、重组和父节点的选择决定了整个搜索过程,通过变

异和重组权衡种群的多样性和相似性,适应性函数反映了优化目标,并且个体选择保证了种群中不同个体间的

竞争.针对 NAS 问题,种群由一组基本网络架构单元构成,通过在种群内选择一个基本架构单元作为父节点用

于变异和重组,即产生新的神经网络架构.一般而言,在 NAS 中只使用变异算子,大量的实验表示两个高度适应

的个体通过重组操作不能得到相似或更好的子代.

父代选择

父代

初始化

种群 个体选择 交叉编译

子代

适应度评估

Fig.21 The framework of evolutionary algorithm

图 21 进化算法框架

[6]

NasNet 第 1 个提出了使用进化算法搜索深度神经网络架构进行图像分类,该方法从 1 000 份最简单的神

经网络架构的副本开始,即一个全局池化层后面连接输出层.在父节点选择的步骤中,提出了对成对的神经网络

架构进行采样以便进一步处理.当两个神经网络架构中较好的一个连同权重被复制和变异,以批量大小为 50 的