Page 15 - 《中国医疗器械杂志》2025年第6期

P. 15

Chinese Journal of Medical Instrumentation 2025年 第49卷 第6期

研 究 与 论 著

用与健康关联紧密,故其风险评估尤为重要 [18] 。 比约10%;评估人工智能技术或仪器设备干预效果

相比其他医学研究,医学人工智能研究伦理风险主 的研究占比5%。实际操作过程中,不同类型的医学

要从技术层面、数据层面及社会层面3个方面进行 人工智能研究关注的风险点应当有所侧重(见表1)。

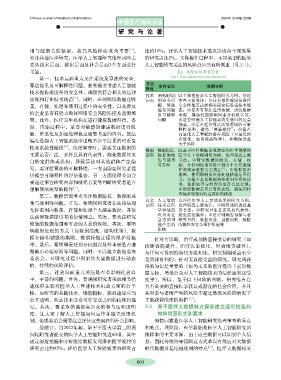

考量。 表1 风险评估考量因素

第一,技术层面重点关注系统及算法的安全、 Tab.1 Risk assessment considerations

算法偏见及可解释性问题。首先需要考虑人工智能 考量 审查要点 案例分析

维度

技术操作或设备的安全性,确保其符合相关的法律

技术 系 统 及 算 法 以干预性医学人工智能研究为例,伦理

[19]

法规和行业技术规范 。同时,必须确保数据在收 层面 的安全问 审查主要关注:①技术操作或设备器件

集、存储、处理和使用过程中的安全性,以及涉及 题、算法 安全性是否达到相关国家标准或技术规

偏见问题 范;②是否有算法选用依据、训练数据

的企业是否有能力做好网络安全风险防控及监测预 及可解释 来源、算法性能影响因素分析报告等;

警。此外,医疗卫生机构在进行健康数据归档、备 问题 ③是否明确人工智能系统失效时的应急

预案;④是否提供算法决策逻辑的可解

份、传输过程中,是否对敏感的健康数据进行脱

释性说明,避免“黑箱操作”;⑤是否

敏、匿名化及加密处理也是需要考虑的内容。算法 有量化人工智能的潜在风险(可量化的

偏见是指人工智能系统中出现不公平结果的可重复 应量化,如系统故障率),并确保受益

大于风险

性和系统性错误 。伦理审查时,需要关注数据的

[20]

数据 数据隐私、以基于医疗数据发现潜在的医学规律的

来源是否广泛、多样且具有代表性,避免数据仅来 层面 数据的收 医学人工智能研究为例,伦理审查主要

自特定群体或机构,导致算法对其他群体产生偏 集与使用 关注:①研究数据的收集、存储、挖

等方面 掘、分析和使用等是否符合个人信息保

见。要评估算法的可解释性,一方面需要研究者提 护和国家数据安全规定 ;②数据保密

[8]

供模型可解释性的评估报告,另一方面伦理委员会 范围、使用限制及应急处理措施是否得

当;③是否具备数据转移使用合作协议

要通过审查研究内容和研究方案等判断研究者是否 书,数据处理方的资质是否合法合规;

[10]

理解算法模型的操作 。 ④训练数据是否具有代表性,避免因样

本偏差导致对特定群体的歧视

第二,数据层面重点关注数据隐私、数据的采

社会 人工智能 以评价医学人工智能效果的研究为例,

集与使用等问题。首先,要确保研究者在法律法规

层面 技术在医 伦理审查主要关注:①研究场所选择是

允许范围内收集、存储和处理个人健康数据,并依 学领域的 否合理;②研究对象是否具有代表性,

应用对社 避免结论偏差;③是否明确告知参与者

法获得数据提供者的知情同意。其次,要关注研究

会方面可 研究目的、数据用途、自愿原则、数据

收集的数据范围和可查阅人员的权限。再次,要明 能产生的 的隐私和安全保护措施等

确数据处理的方式(如数据清洗、结构化等)、数 影响

据存储和销毁的期限、数据传输过程的保护措施 针对有诊断、治疗或预防直接受益的研究(如

等。最后,要明确责任划分机制以及样本量是否遵 诊断效能提升、治疗决策优化、时效性突破等),

循最小必要原则等问题。同时,可以建立数据监查 与任何可得到的替代方法相比,研究预期受益至少

委员会,对研究过程中积累的大量数据进行动态 是同样有利的;针对无直接受益的研究,研究所获

的、持续的风险评估。 得的知识是重要的(如为未来的医疗提供丰富的数

第三,社会层面重点关注是否有影响社会公 据支持、增强公众对人工智能技术的信任感和接受

平、平等的问题。首先,要确保研究者采取相关措 度等)。所以,基于以上风险的判断,研究唯有在

施保障在获得医学人工智能技术机会方面的公平 具有重要的直接医学获益或潜在的社会价值,并且

性,如研究的关键技术、性能指标、获取途径应当 其对参与者所产生的风险不超过最低风险的情况下

[21]

公开透明,防止技术受众与非受众之间的歧视和偏 才能获得伦理的辩护 。

见。其次,要采取措施提高公众的参与度和透明 3.3 基于医疗大数据特点探索建立适用性强的

度,让大家了解人工智能如何运作并建立反馈机 知情同意形式和要求

制。伦理委员会需要注意评估这些潜在的社会影响。 知情同意是医学人工智能研究伦理审查的重点

经统计,自2022年起,陆军军医大学第二附属 和难点。现阶段,医学数据是医学人工智能研究训

医院研究者提交的医学人工智能研究近60项,其中 练样本的主要来源,由于这些数据可以识别个人信

通过深度挖掘和分析医疗数据发现潜在医学规律的 息,因此传统的知情同意方式难以有效应对大数据

[22]

研究占比约85%;评价医学人工智能效果的研究占 时代数据反复挖掘使用的特点 。医疗大数据相关

601