Page 326 - 《软件学报》2025年第7期

P. 326

黄靖 等: 基于特征融合动态图网络的多标签文本分类算法 3247

了 12.14%, Micro-F1 提升了 5.72%. 此外, 与 CNN-RNN、LSAN 等不考虑标签之间关系的方法相比, 一些基于标

签之间相关性的经典模型 (如 MRMP) 在多标签文本分类任务中具有明显优势, 因而建模标签相关性对多标签分

类问题非常重要. 此外还可以看出, 基于注意力机制和序列生成的 LANRTN 性能要高于 SGM 等基于序列生成的

模型. 尽管 SGM 使用有序序列来对标签之间的关系进行建模, 但它忽略了标签和文档内容之间的交互. LANRTN

使用多标签注意力, 可以关注内容中最相关的部分, 并为每个标签提取不同的语义信息.

2) 本文所提出的模型在 3 个数据集上的性能都优于其他模型, 这是由于 FDGN 通过动态图为每个文本都生成

了一个标签相关图, 因此可以改善基于共现的静态图的不足. 其中在 BIBTEX 数据集上, FDGN 的汉明损失为 0.012 7,

是所有基线方法中最好的, 与基于注意力机制的 LSAN 相比, 本文模型在汉明损失指标上减少了 6.62%, 在 Micro-F1

指标上提升了 3.14%, 在 Micro-Precision 指标上提升了 2.86%. 与基于图卷积神经网络和注意力机制的 MRMP

相比, 本文模型在汉明损失指标上减少了 3.79%, 在 Micro-F1 指标上提升了 2.92%, 在 Micro-Precision 指标上提

升了 1.59%. 在 RCV1-V2 数据集上, FDGN 的汉明损失为 0.007, 是所有基线方法中最好的, 与基于注意力机制的

LSAN 相比, 本文模型在汉明损失指标上减少了 11.40%, 在 Micro-F1 指标上提升了 3.40%, 在 Micro-Precision 指

标上提升了 0.55%. 与基于图卷积神经网络和注意力机制的 MRMP 相比, 本文模型在汉明损失指标上减少了 4.11%,

在 Micro-F1 指标上提升了 3.40%, 在 Micro-Precision 指标上提升了 0.33%. 最后, 在 AAPD 数据集上, FDGN 的汉

明损失为 0.021, 是所有基线方法中最好的, 与基于注意力机制的 LSAN 相比, 本文模型在汉明损失指标上减少了

14.63%, 在 Micro-F1 指标上提升了 7.26%, 在 Micro-Precision 指标上提升了 3.61%. 与 MRMP 相比, 本文模型在

汉明损失指标上减少了 0.62%, 在 Micro-F1 指标上提升了 0.53%, 在 Micro-Precision 指标上提升了 0.62%. 因此,

本文提出的特征融合动态图网络是有意义和有效的.

问题 2: FDGN 的各模块如何改善分类结果?

为了评估 FDGN 中所提改进对分类结果的影响, 本文通过选择不同的模型改进结构, 进行了一系列消融实验,

并将结果记录在了表 3 中. 实验表明: 1) FDGN 的各模块均能带来一定的提升, 其中的核心模块动态图对结果有着

重要贡献; 2) 模型在 BIBTEX 和 RCV1-V2 数据集上的性能明显优于 AAPD, 这是由于 BIBTEX 和 RCV1-V2 数据

集中的低频标签较多, FDGN 通过结合文本特征、重构标签关系, 改善了标签统计偏差对结果的影响; 3) 融合特征

对实验结果有着积极意义, 这表明整合当前文档的标签特征确实能够更好地描述标签特性.

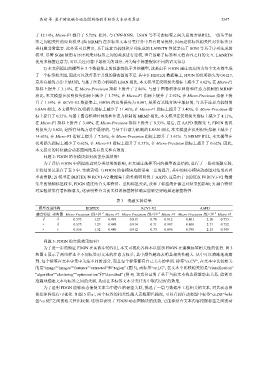

表 3 消融实验结果

模型改进结构 BIBTEX RCV1-V2 AAPD

融合特征 动态图 Micro-Precision HL×10 −2 Micro-F1 Micro-Precision HL×10 −2 Micro-F1 Micro-Precision HL×10 −2 Micro-F1

√ √ 0.575 1.27 0.493 0.915 0.70 0.912 0.801 2.10 0.753

× √ 0.573 1.29 0.489 0.914 0.71 0.907 0.800 2.11 0.752

× × 0.566 1.32 0.480 0.912 0.73 0.896 0.798 2.13 0.749

问题 3: FDGN 的实践效果如何?

为了进一步的验证 FDGN 在实践中的作用, 本文可视化各样本以展示 FDGN 在建模标签相关性的优势. 图 3

和图 4 展示了两组样本中不同标签对文本的注意力权重, 其中颜色越深表明其相关性越大. 从中可以清晰地观察

到, 每个标签在文本中集中关注不同的部分, 而且每个标签都有自己关心的单词. 标签“cs.CV”, 在文本中比较相关

的是“image”“images”“features”“extracted”和“region” (图 3), 而标签“cs.LG”, 在文本中比较相关的是“classification”

“algorithm”“clustering”“optimization”和“classified” (图 4). 这充分证明了基于当前文本构造标签动态关系, 能够更

准确地描述文本与标签之间的关联, 从而在多标签文本分类任务中取得更好的效果.

为了证明 FDGN 能够动态捕捉文本当中潜在的标签关联, 挑选了一篇与数据库工程相关的文本, 对其动态图

邻接矩阵进行可视化. 如图 5 所示, 两个标签的相关性越大表格颜色越深, 可以看到在动态图中标签“cs.DB”与标

签“cs.SE”之间的相关性比较强. 这明显表明了 FDGN 动态图模块的优势, 它能够结合文本内容挖掘标签之间的动