Page 195 - 《软件学报》2025年第4期

P. 195

陈强 等: 融合任务知识的多模态知识图谱补全 1601

1.8%. 在 WN9 数据集上的性能分别提升了 15.4% 和 0.2%.

值得注意的是, 1) 对于在两个数据集上性能提升的差异, 我们认为 WN9 数据集相比于 FB15k-237 数据集在难易

程度上相对容易, 使用简单的方法就可以得到很好的效果, 因此在 WN9 数据集上提升幅度较小. 2) ConvE 在 3 个解

码器中表现最优, 我们认为这是由于 ConvE 解码器中使用卷积操作对实体和关系向量进行了更复杂的融合所导致的.

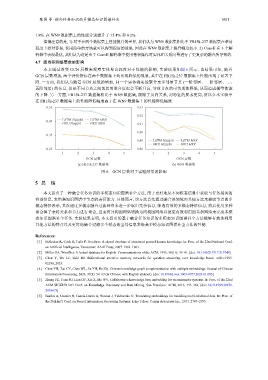

4.7 图卷积网络层数的影响

本文通过改变 GCN 层数来观察实体聚合深度对于性能的影响, 实验结果如图 6 所示. 由结果可知, 随着

GCN 层数增加, 两个评价指标在两个数据集上均出现降低的现象, 其中在 FB15k-237 数据集上性能出现了显著下

降. 一方面, 我们认为随着 GCN 层数的增加, 同一个实体确实能聚合更多邻居节点 (一阶邻居、二阶邻居、…、

五阶邻居) 的信息, 但是不同节点之间邻居的重合度也会不断升高, 导致节点的可判别性降低, 从而造成模型性能

的下降. 另一方面, FB15k-237 数据集相比于 WN9 数据集, 剔除了反向关系, 对特征的要求更高, 所以在本实验中

在 FB15k-237 数据集上的性能降低幅度高于在 WN9 数据集上的性能降低幅度.

0.55 0.93

on Artificial Intelligence. Vancouver: AAAI Press, 2007. 1962–1963.

0.92

LSTM Hit@10 LSTM MRR

0.45

GRU Hit@10 GRU MRR 0.91

0.90

0.35

0.89 LSTM Hit@10 LSTM MRR

GRU Hit@10 GRU MRR

0.25 0.88

1 2 3 4 5 1 2 3 4 5

GCN 层数 GCN 层数

(a) FB15k-237 数据集 (b) WN9 数据集

图 6 GCN 层数对于实验结果的影响

5 总 结

本文提出了一种融合任务知识的多模态知识图谱补全方法, 用于更好地从不同模态信息中获取与任务相关的

有效信息, 来增强知识图谱中节点的表征能力. 具体而言, 该方法首先通过融合该领域内其他方法来提取节点的多

模态特征表示, 其次通过多模态融合过滤网络来进一步取出冗余信息, 筛选有效的多模态特征信息, 然后使用多种

聚合算子来将关系和节点进行聚合, 进而将异构图网络转换为同构图网络以便更有效利用图卷积网络来完成多模

态知识图谱补全任务. 实验结果表明, 本文提出的基于融合任务知识的多模态知识图谱补全方法能够有效地利用

其他方法的特点以及更好地融合过滤多个模态的全局信息来提高多模态知识图谱补全方法的性能.

References:

[1] Bollacker K, Cook R, Tufts P. FreeBase: A shared database of structured general human knowledge. In: Proc. of the 22nd National Conf.

[2] Miller GA. WordNet: A lexical database for English. Communications of the ACM, 1995, 38(11): 39–41. [doi: 10.1145/219717.219748]

[3] Chen Y, Wu LF, Zaki MJ. Bidirectional attentive memory networks for question answering over knowledge bases. arXiv:1903.

02188, 2019.

[4] Chen YH, Tan CY, Chen WL, Jia YH, He ZQ. Chinese knowledge graph complementation with multiple embeddings. Journal of Chinese

Information Processing, 2023, 37(1): 54–63 (in Chinese with English abstract). [doi: 10.3969/j.issn.1003-0077.2023.01.005]

[5] Zhang FZ, Yuan NJ, Lian DF, Xie X, Ma WY. Collaborative knowledge base embedding for recommender systems. In: Proc. of the 22nd

ACM SIGKDD Int’l Conf. on Knowledge Discovery and Data Mining. San Francisco: ACM, 2016. 353–362. [doi: 10.1145/2939672.

2939673]

[6] Bordes A, Usunier N, Garcia-Durán A, Weston J, Yakhnenko O. Translating embeddings for modeling multi-relational data. In: Proc. of

the 26th Int’l Conf. on Neural Information Processing Systems. Lake Tahoe: Curran Associates Inc., 2013. 2787–2795.