Page 82 - 《软件学报》2024年第4期

P. 82

1660 软件学报 2024 年第 35 卷第 4 期

−q

−3

的学习率被设置为 1e . 参考文献[30], 本文使用动态的学习率 lr p =lr 0 (1+mz) , 其中, lr 0 表示基础学习率; z 表

示相对步骤, 在训练期间从 0 到 1 变化; 设 m=10, q=0.75 在总体训练损失来动态调优模型时, α=0.3, η=

2/(1+e −step/max_step )−0.5, η∈[0.5,1.0). step 表示当前迭代次数, max_step 表示最大迭代次数. 随着 step 接近最大轮

次, η从 0.5 接近于 1.0, 对开放类别赋予的训练权重也越来越大. 轮次 Epoch 设置为 15, K-means 中的 K=α×n t ,

邻居数量 N=15. 参考主动域自适应工作 [49] , 本文报告了主动样本比例β=0.05 上的结果. 另外, 本节在消融实

验部分也报告了β=0.01,0.03,…,0.1 等比例的结果.

• 衡量指标

参考现有的开集域自适应方法 [13,50] , 本文选择 H-score (HOS)作为模型的衡量指标, H-score 的计算公式:

2 acc× × acc

HOS = kn un (5)

acc + acc un

kn

其中, acc kn 表示公共类的每一类的识别准确率, acc un 表示开放类的识别准确率. H-score 表示公共类识别准确

率和开放类识别准确率的调和平均值, HOS 越大, 表示模型对于开放类和公共类的分离效果和对于公共类的

辨别效果都达到最优.

3.4 实验结果

3.4.1 实验结果

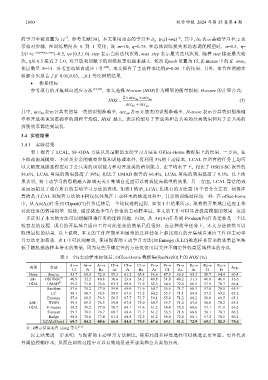

表 1 报告了 LCAL, SF-ODA 方法以及最新的主动学习方法在 Office-Home 数据集上的结果. 一方面, 在

不修改源域模型、不涉及多余的模型参数和训练成本外, 仅利用 5%的主动样本, LCAL 在所有的任务上均可

以大幅度地提高模型对于公共类的识别能力和对开放类的辨别能力. 在平均水平上, 相比于 OSHT-SC 报告的

36.6%, LCAL 算法的效果提高了 39%; 相比于 UMAD 报告的 66.4%, LCAL 算法的效果提高了 9.5%. 以上结

果表明, 将主动学习的思路融入源域无关开集域自适应可以有效提高模型的效果. 另一方面, LCAL 算法的效

果远远超过了现有所有的主动学习方法的表现. 如表 1 所示, LCAL 比现有的方法高 10 个百分点左右. 值得注

意的是: LCAL 和现有方法的不同仅仅体现在主动样本的挑选过程中, 其余的训练过程均一样. 在 office-home

中, 从 Art(Ar)任务到 Clipart(Cl)任务迁移是一个比较难的过程. 如表 1 中结果所示, 现有的开集域自适应工作

对此任务的效果很差. 但是, 通过挑选少量有价值的主动样本后, 本文的工作可以显著提高模型的效果. 这进

一步证明了本文的方法可以缓解困难任务的迁移问题. 再如, 从 Art(Ar)任务到 Product(Pr)任务迁移是一个比

较容易的过程. 现有的开集域自适应工作对此任务的效果已经很好. 在这种简单任务上, 本文方法依然可以

取得最优的结果. 以上说明, 本文的工作在简单和困难的迁移任务上都比现有的开集域自适应工作和主动学

习方法更加有效. 表 1 中可以观察到, 使用现有的主动学习方法(如 Entropy 或 LC)挑选样本带来的效果甚至略

低于随机挑选样本带来的效果, 因为这些不确定性的方法仅仅可以关注不确定性较高区域样本的分离.

表 1 5%主动样本标注后, Office-Home 数据集(ResNet50)上的 HOS (%)

Ar→ Ar→ Ar→ Cl→ Cl→ Cl→ Pr→ Pr→ Pr→ Re→ Re→ Re→

类别 方法 Avg.

Cl Pr Re Ar Pr Re Ar Cl Re Ar Cl Pr

None Source 53.7 65.3 72.0 55.3 61.2 65.4 56.6 47.9 66.9 65.3 50.7 64.4 60.4

#

SF- OSHT-SC 40.9 32.2 40.8 30.6 23.8 24.2 49.8 31.8 40.2 31.3 46.8 46.1 36.6

#

ODA UMAD 59.2 71.8 76.6 63.5 69.0 71.9 62.5 54.6 72.8 66.5 57.9 70.7 66.4

Random 57.6 70.2 77.0 59.0 69.0 71.6 60.7 55.6 71.7 68.3 57.8 70.8 65.9

LC 58.1 68.7 76.3 59.5 67.6 71.2 60.2 55.7 71.1 68.0 57.2 69.2 65.2

Entropy 57.4 69.5 76.3 58.5 67.7 71.7 59.1 55.9 71.2 68.2 56.0 69.5 65.1

ASF- BVSB 59.3 69.2 76.3 59.0 67.8 72.0 60.7 55.7 71.4 67.6 56.6 70.2 65.5

ODA K-means 58.2 70.2 77.0 59.7 69.1 71.6 61.2 58.4 72.0 68.6 57.1 71.1 66.2

Coreset 59.3 70.6 76.7 60.7 68.6 71.7 61.2 56.5 71.6 68.6 58.1 70.3 66.2

Badge 58.8 70.0 77.4 61.4 68.8 72.2 61.2 56.6 72.0 68.1 57.2 70.5 66.2

LCAL(Ours) 69.7 84.2 80.6 66.8 84.5 79.3 67.6 69.1 81.2 72.9 69.1 82.3 75.6

注: #表示结果来自 Liang 等人 [13]

以上结果进一步表明: 与现有的主动学习方法相比, 使用局部多样性选择可以挑选出更全面、更具代表

性阈值模糊样本, 从而在训练过程中可以有效地促进开放类和公共类的分离.