Page 467 - 《软件学报》2024年第4期

P. 467

何建航 等: 基于人体和场景上下文的多人 3D 姿态估计 2045

32−1 H G −1 W G −1

∑ ∑ ∑

′

′

J k = (z,y, x) = (z ,y , x )×Softmax(H k )(z ,y , x ) (4)

′

′

′

′

z ′ =0 y ′ =0 x ′ =0

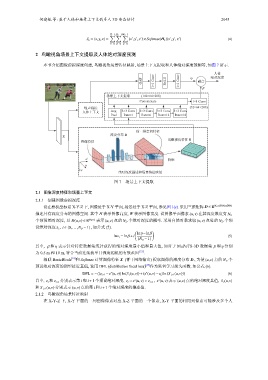

2 鸟瞰视角场景上下文提取及人体绝对深度预测

本节介绍图像虚拟深度创建, 鸟瞰视角场景特征映射, 场景上下文提取和人体绝对深度预测等, 如图 7 所示.

人体

GAP 1×1 Conv ReLU 1×1 Conv Ψ 融合 绝对深度

P

场景上下文提取 (160×64×208)

Concatenate 1×1 Conv

噪声抵抗 (32×64×208)

人体上下文 Avg. 3×3 Conv 3×3 Conv 3×3 Conv 3×3 Conv

Pool Rate=1 Rate=6 Rate=12 Rate=18

伪三维空间特征

深度分布 D

X

鸟瞰视角特征 B

图像特征

d 降维

u

v

绝对深度描述和场景特征映射

图 7 场景上下文提取

2.1 图像深度特征和场景上下文

2.1.1 创建图像虚拟深度

设在相机坐标系 X-Y-Z 下, 图像处于 X-Y 平面, 场景处于 X-Z 平面, 参见图 1(c). 采用三维矩阵 D ∈ R N D ×(H/4)×(W/4)

描述具有深度分布的图像空间. 其中 H 表示图像高度, W 表示图像宽度. 设图像平面像素 (u,v) 在其深度维度有 N D

D(u,v) ∈ R N D ×1 N D 个预

个预设绝对深度, 以 表示 (u,v) 点的 N D 个绝对深度的概率. 采用自然对数求取 (u,v) 点处的

z i i ∈ {0,...,N D −1} , 如公式 (5).

设绝对深度 ,

( )

lnη−lnβ

lnz i = lnβ+i (5)

(N D −1)

η 表示针对特定数据集统计获得的绝对深度最小值和最大值, 如对于 MuPoTS-3D η 分别

其中, β 和 数据集 β 和

为 0.5 m 和 10 m, 符合当前连续波单目深度相机的有效范围 [22] .

级联 BasicBlock [13] 和 Softmax 计算图像特征 X (骨干网络输出) 提取图像的深度分布 D , 为使 (u,v) 点的 N D 个

预设绝对深度的期望接近真值, 选用 DFL (distribution focal loss) [23] 作为监督学习损失函数, 如公式 (6).

∗

DFL = −((z i+1 −z (u,v))ln(S i (u,v))+(z (u,v)−z i )ln(S i+1 (u,v))) (6)

∗

∗ ∗

其中, z i 和 z i+1 分别表示第 i 和 i+1 个预设绝对深度, z i < z (u,v) < z i+1 z (u,v) 表示 (u,v) 点的绝对深度真值, S i (u,v)

,

和 S i+1 (u,v) 分别表示 (u,v) 点的第 i 和 i+1 个绝对深度的概率值.

2.1.2 鸟瞰视角场景特征映射

在 X-Y-Z 下, X-Y 平面的一列图像像素对应 X-Z 平面的一个像素, X-Y 平面的相同列像素可能涉及多个人