Page 40 - 《软件学报》2020年第10期

P. 40

3016 Journal of Software 软件学报 Vol.31, No.10, October 2020

batch 训练之后会更新参数,导致原来缓存的预测结果在新模型上失效,无法复用.(4) 在不同终端设备上的训练

时间有最高将近 2 倍的差异,原因是,不同终端设备上计算资源存在着差异.但是,AutLearn 的优化技术在不同的

设备上都有相应的性能提升,具有一定的普适性.

结合第 2 节中提到的我们对真实用户的行为数据所进行的分析后发现,超过半数的终端每天都有约 120 分

钟处于可训练阶段.这意味着 LSTM 模型和 MobileNet 模型都可以在 1 天内完成多轮迁移学习的训练,即新模型

下发后的第 2 天就可以用于部署,并达到定制化后的高准确率.

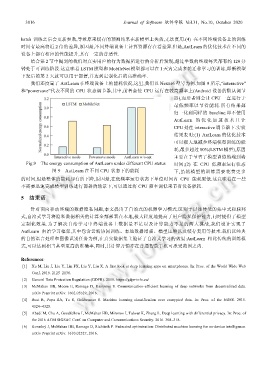

我们还度量了 AutLearn 在终端设备上的能耗状况,这里,我们以 Nexus6 型号为例.如图 9 所示,“interactive”

和“powersave”代表不同的 CPU 状态调节器,其中,前者会使 CPU 运行在较高频率上(Android 设备的默认调节

器),而后者则会让 CPU 一直运行于

最低频率以节省能耗.所有结果都

归一化到同样的 baseline:即不使用

AutLearn 的优 化加速技术 且让

CPU 处在 interactive 调节器下.实验

结果表明:(1) AutLearn 的优化技术

可以极大地减少终端模型训练的能

耗,最多超过 80%(LSTM 模型),原因

主要在于节省了模型训练的端到端

Fig.9 The energy consumption of AutLearn under different CPU status 时间;(2) 在 CPU 低频率运行状态

图 9 AutLearn 在不同 CPU 状态下的能耗 下,虽然模型的训练需要花费更多

的时间,但是整体的能耗却有所下降,原因是,在低频率运行状态下单位时间内 CPU 能耗更低.这意味着在一些

不需要迅速完成模型训练进行部署的场景下,可以通过将 CPU 频率调低来节省设备能耗.

5 结束语

针对面向移动终端的数据隐私问题,本文提出了自治式的机器学习模式.区别于以往传统的集中式和联邦

式,自治式学习将隐私数据相关的计算全都部署在本地,极大程度地提高了用户隐私保护能力,同时提供了模型

定制化效果.为了解决自治学习中终端设备上数据量不足以及计算能力不足的两大挑战,我们设计实现了

AutLearn 自治学习框架,其中包含云端协同训练、本地数据增强、模型压缩以及缓存复用等技术.我们以经典

的自然语言处理和图像识别任务为例,在真实数据集上验证了自治式学习的效果:AutLearn 相比传统的训练模

式,可以达到相当甚至更高的准确率,同时,其计算开销亦在普通智能手机可承受范围之内.

References:

[1] Xu M, Liu J, Liu Y, Lin FX, Liu Y, Liu X. A first look at deep learning apps on smartphones. In: Proc. of the World Wide Web

Conf. 2019. 2125–2136.

[2] General Data Protection Regulation (GDPR). 2018. https://gdpr-info.eu/

[3] McMahan HB, Moore E, Ramage D, Hampson S. Communication-efficient learning of deep networks from decentralized data.

arXiv Preprint arXiv: 1602.05629, 2016.

[4] Bost R, Popa RA, Tu S, Goldwasser S. Machine learning classification over encrypted data. In: Proc. of the NDSS. 2015.

4324−4325.

[5] Abadi M, Chu A, Goodfellow I, McMahan HB, Mironov I, Talwar K, Zhang L. Deep learning with differential privacy. In: Proc. of

the 2016 ACM SIGSAC Conf. on Computer and Communications Security. 2016. 308–318.

[6] Konečný J, McMahan HB, Ramage D, Richtárik P. Federated optimization: Distributed machine learning for on-device intelligence.

arXiv Preprint arXiv: 1610.02527, 2016.