Page 455 - 《软件学报》2026年第1期

P. 455

452 软件学报 2026 年第 37 卷第 1 期

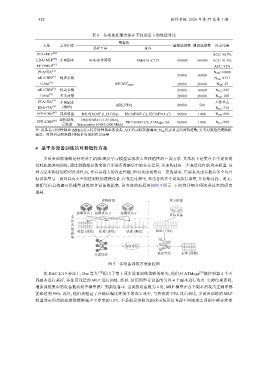

表 6 各类预处理方法在不同场景下的性能对比

数据集

方法 差异因素 建模轨迹数 测试轨迹数 攻击结果

采样工具 设备

PCA+MLP [66] ACC: 90.7%

LDA+MLP [66] 不同副本 H-field 传感器 XMEGA-C7.37 100 000 100 000 ACC: 91.5%

FFT+MLP [66] ACC: 91%

[51]

PCA+TA N GE >10000

35 000 10 000

AE+CNN [51] 噪声参数 N GE : 8 751

f

U-Net [52] ASCAD desy0 20 000 20 000 N GE : 25

AE+CNN [51] 抖动参数 35 000 10 000 N GE : 822

U-Net [52] 多类对策 20 000 20 000 N GE : 100

PCA+TA [55] 不同副本 无法攻击

AES_PTv2 10 000 500

EDA+TA [55] (掩码) N EG : 310

FFT+CNN [46] 同质设备 DSOX3034T (1.25 GS/s) PIC16F887-C3, PIC16F914-C3 16 000 1 000 N GE : 600

[46] 异构设备, DSOX3034T (1.25 GS/s),

FFT+CNN PIC16F887-C3, ATMega-163 16 000 1 000 N GE : 800

示波器 Waverunner 6100A (500 MS/s)

注: 设备名-C[时钟频率 (MHz)]表示特定时钟频率的设备; ACC代表标签准确率; N GE 代表攻击所需轨迹数; 多类对策指的是随机

延迟、时钟抖动和洗牌3种防护对策的组合场景

4 基于多设备训练的可移植性方案

多设备训练策略是针对基于机器/深度学习模型实现攻击可移植性的一类方法. 其本质上是集合多个设备的

功耗轨迹共同训练, 通过调整超参数来拟合多设备数据集中的分布差异, 从而构建出一个高泛化性的攻击模型. 这

种方法所构建的模型泛化性高, 并有着强大的攻击性能, 但对攻击场景有一定的要求. 它要求攻击者拥有多个与目

标设备型号一致且具有完全的控制权的建模设备. 在攻击过程中, 攻击者向多个设备执行加密, 并获取功耗、明文、

密钥等信息构建可供模型训练的多设备数据集, 该方法的流程图如图 5 所示. 下面将详细介绍这类技术的研究

进展.

建模阶段 攻击阶段

…

建模设备 1 建模设备 2 建模设备 n

多 目标设备

设

备

数 轨迹 (目标)

据 标签 (训练) 轨迹 (训练) 轨迹 (测试)

集

选取最优

分类算法 最优算法 标签 (预测)

图 5 多设备训练方案流程图

在 DAC 2019 会议上, Das 等人 [38] 提出了第 1 项多设备训练策略的研究, 他们对 ATMega [76] 微控制器 4 个不

同副本进行采样, 并使用浅层的 MLP 进行训练. 然后, 使用同型号设备的另外 4 个副本进行攻击. 实验结果表明,

增加训练集中的设备数有利于模型推广到新设备中. 当训练设备数为 4 时, MLP 模型在各个副本的攻击正确率都

能够达到 99%. 此外, 他们还验证了在低信噪比环境下的攻击效率, 与传统的 CPA 攻击相比, 多设备训练的 MLP

模型攻击所需的轨迹数能够减少至原来的 10%. 不足的是该研究的攻击场景仅考虑不同副本之间的少部分样本