Page 326 - 《软件学报》2025年第12期

P. 326

钱忠胜 等: 结合时间间隔数据增强的对偶视图自监督会话推荐模型 5707

交互预测用户偏好.

8) TiCoSeRec: 一种基于自监督学习会话推荐模型, 目标是同时建模用户交互序列中的时间、上下文和顺序

模式. 先构建一个时间感知的 GCN 来学习会话中的上下文和时间信息, 再利用一个基于自注意力机制的序列推荐

网络来学习用户交互的顺序依赖关系, 从而综合序列、上下文和时间多个维度对用户偏好建模.

9) SSDRec: 一种最新的序列数据恢复自监督框架, 通过构建多关系图和分层去噪策略来高效地处理损坏或不

完整的序列数据, 从而提高推荐结果的准确性.

4

10) S Rec: 一种最新的对抗学习模型, 通过在线聚类和对抗学习来学习用户潜在意图, 并利用自蒸馏将有丰富

行为数据的用户 (老师) 知识传递给行为数据稀疏的用户 (学生), 从而提高推荐性能.

11) SparseEnNet: 一种最新的鲁棒对抗生成方法, 旨在通过生成适应性更强的增强项目来缓解序列推荐中的

数据稀疏问题.

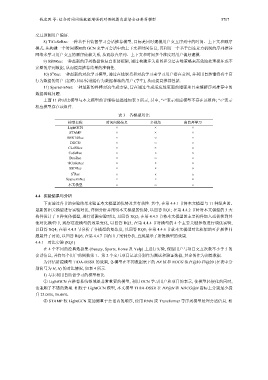

上面 11 种对比模型与本文模型的详细特征描述如表 3 所示, 其中, “×”表示相应模型不存在该组件; “○”表示

相应模型存在该组件.

表 3 各模型对比

模型名称 时间间隔信息 多视角 自监督学习

LightGCN × × ×

STAMP × × ×

BERT4Rec × ○ ×

DHCN × ○ ○

CL4SRec × × ○

CoSeRec × × ○

DuoRec × ○ ○

TiCoSeRec ○ × ○

SSDRec × × ○

4

S Rec × × ○

SparseEnNet × × ○

本文模型 ○ ○ ○

4.4 实验结果与分析

下面通过各节的实验结果来验证本文模型的优势及其有效性. 其中, 在第 4.4.1 节将本文模型与 11 种经典的、

最新的相关模型进行实验对比, 详细分析并阐明本文模型的优势, 以回答 RQ1; 在第 4.4.2 节针对本文模型的 3 大

构件设计了 5 种变体模型, 进行消融实验对比, 以回答 RQ2; 在第 4.4.3 节将本文模型的主要构件加入或替换到其

他对比模型中, 观察这些模型的效果变化, 以回答 RQ3; 在第 4.4.4 节对模型的 4 个主要关键参数进行调优实验,

以回答 RQ4; 在第 4.4.5 节分析了各模型的复杂度, 以回答 RQ5; 在第 4.4.6 节就本文模型对比框架的可扩展性问

题展开了讨论, 以回答 RQ6; 在第 4.4.7 节给出了案例分析, 直观展示了所提模型的效果.

4.4.1 对比实验 (RQ1)

在 4 个不同的经典数据集 (Beauty, Sports, Home 及 Yelp) 上进行实验, 保留用户与项目交互次数不小于 5 的

会话信息, 并将每个用户的倒数第 1、第 2 个交互项目记录分别作为测试和验证数据, 其余的作为训练数据.

为评估所提模型 TIDA-DSSR 的效果, 各模型在不同数据集下的 HR 值和 NDCG 值在@10 和@20 (在表中分

别简写为 H, N) 的对比情况, 如表 4 所示.

1) 与未利用自监督学习的模型相比

① LightGCN 在推荐系统领域是非常重要的模型, 利用 GCN 学习用户和项目的表示, 使模型轻便化的同时,

也兼顾了不错的效果. 相较于 LightGCN 模型, 本文模型 TIDA-DSSR 在 HR@N 和 NDCG@N 指标上分别最少提

升 23.06%, 16.46%.

② STAMP 较 LightGCN 更加侧重于会话内的顺序, 使用 RNN 或 Transformer 等序列模型处理会话信息. 相