Page 459 - 《软件学报》2025年第10期

P. 459

4856 软件学报 2025 年第 36 卷第 10 期

ICFG-PEDES [24] 包含 4 102 个身份的 54 522 个图像, 包含了比 CUHK-PEDES 更多的以身份为中心和细粒度

的文本描述. 每个图像只有一个对应的文本描述. 该数据集分为训练集和测试集, 训练集包含 34 674 个图像-文本

对, 其中有 3 102 个标识, 而测试集包含 19 848 个图像-文本对, 用于剩余的 1 000 个标识.

RSTPReid [18] 包含来自 15 个摄像头的 4 101 个身份的 20 505 张图像. 每个身份都有 5 张由不同摄像机拍摄的

对应图像, 每个图像都有 2 个文本描述. 拆分官方数据之后, 分别使用 3 701、200 和 200 个身份进行训练、验证和

测试. 每个句子不少于 23 个单词.

本文的评估指标采用排名前 k 命中率 Rank-k (k=1, 5, 10) 作为主要的评价度量. 当给定一个查询文本描述, 所

有图库图像都根据其相似度值进行排名. 成功的搜索意味着在前 k 个图像中存在匹配的人物图像. 另外, 对于综合

评价, 我们还采用了平均正确率均值 (mAP) 和平均逆负惩罚 (mINP) 作为另外的检索准则. Rank-k、mAP 和 mINP

的值越高, 性能越好.

3.2 实验配置及细节

我们使用 PyTorch 实现了所提出的模型, 在单个 RTX 3090 24 GB GPU 上进行了训练. 本文采用 CLIP 的图像

编码器 ViT 提取视觉特征, 所有输入图像的大小均调整为 384×128, 在训练过程中采用随机水平翻转、随机填充

裁剪和随机擦除等方法增强图像数据. 本文采用 CLIP 的文本编码器 Transformer 提取文本特征, 将文本序列的最

大长度设置为 L=100. 图像和文本特征的嵌入维度被设置为 d=768. 对于多元交互编码器的每一层, 头的大小和个

数被设置为 512 和 8. 在训练阶段, 我们采用 Adam 作为优化器, 训练 200 个周期, 批量大小为 32, 学习速率初始化

−5

−5

为 1×10 , 余弦学习速率衰减. 初始时, 我们花了 5 个周期来预热, 将学习速率从 1×10 −6 线性增加到 1×10 . 对

−5

于随机初始化的模块, 我们将初始学习速率设置为 5×10 . CMPM 损失函数中的温度超参数 τ 设置为 0.02.

在测试阶段, 使用余弦距离来度量图像-文本对的相似度值. 根据文本查询, 对相似度得分进行排序, 从图像库

中检索出人物图像.

3.3 与 SOTA 方法的对比分析

为了验证本方法在文本-图像行人重识别任务中的优越性, 我们将所提方法与现有主流方法在 CUHK-PEDES、

ICFG-PEDES 及 RSTPReid 这 3 个数据集上进行比较, 结果如表 2–表 4 所示. 这些方法可分为两类: (1) 以 GNA-

[5]

[6]

[9]

[7]

RNN 、IATV 、Dual Path 等方法为代表的全局匹配方法; (2) 以 PWM+ATH 、GLA [22] 、ViTAA [12] 等方法为

代表的局部匹配方法. 我们的方法在所有 3 个基准数据集上始终取得最先进的结果, 并取得了重大改进.

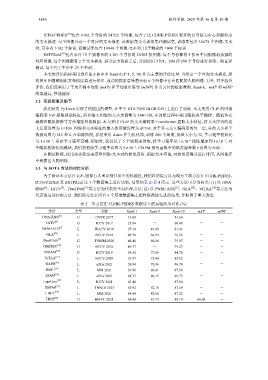

表 2 各方法在 CUHK-PEDES 数据集上的实验结果对比 (%)

方法 类型 来源 Rank-1 Rank-5 Rank-10 mAP mINP

[6]

GNA-RNN G CVPR 2017 19.05 - 53.64 - -

[9]

IATV G ICCV 2017 25.94 - 60.48 - -

[5]

PWM+ATH L WACV 2018 27.14 49.45 61.02 - -

[22]

GLA L ECCV 2018 43.58 66.93 76.26 - -

[7]

Dual Path G TOMM 2020 44.40 66.26 75.07 - -

[10]

CMPM/C G ECCV 2018 49.37 - 79.27 - -

[19]

TIMAM G ICCV 2019 54.51 77.56 84.78 - -

[12]

ViTAA L ECCV 2020 55.97 75.84 83.52 - -

[20]

NAFS L arXiv 2021 59.94 79.86 86.70 - -

[18]

DSSL L MM 2021 59.98 80.41 87.56 - -

[24]

SSAN L arXiv 2021 61.37 80.15 86.73 - -

[33]

LapsCore L ICCV 2021 63.40 - 87.80 - -

[34]

ISANet L TNNLS 2023 63.92 82.15 87.69 - -

[35]

LBUL L MM 2021 64.04 82.66 87.22 - -

[36]

TBPS G BMVC 2021 64.08 81.73 88.19 60.08 -