Page 456 - 《软件学报》2025年第10期

P. 456

孙锐 等: 隐式多尺度对齐与交互的文本-图像行人重识别方法 4853

与第 3 层得到的 token 序列进行尺寸上的对齐. 融合的二维图像特征结果为 X 2 , 尺寸为 [H/8,W/8,4C], 既包含了

第 4 层准确的全局信息又包含了第 3 层较为丰富的局部信息.

接下来, 令 X 1 和 X 2 再进行一次交叉注意力操作, 对经过 Patch embedding 处理的 X 1 而得到的 token 序列需做

X 2 得到的 token V [H/8,W/8,4C], 包含了丰富的局部

降采样, 从而与 序列进行对齐. 此次融合的结果为 X , 尺寸为

和全局信息, 更好进行跨模态交互.

2.3 多元交互注意力模块

为了学习图像和文本之间的对应关系, 实现准确地语义对齐, 我们设计了一个多元交互注意力模块来整合图

像和文本特征. 在这个模块中, 本文使用受多样性损失约束的多头注意 [23] 模块实现图像-文本对齐, 其中, Q 表示

Query, 用于查询相应的信息; K 和 V 分别是 Key 和 Value 的缩写, 作为键和值去匹配和获取相应的特征. 经过

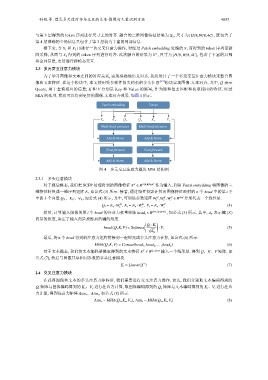

MIA 的处理, 我们可以得到更好的图像-文本对齐效果. 如图 4 所示.

Patch embedding Linear

V V K V Q T Q V K T V T

Multi-head attention Multi-head attention

Add & Norm Add & Norm

Feed forward Feed forward

Add & Norm Add & Norm

图 4 多元交互注意力模块 MIA 结构图

2.3.1 多头注意模块

对于视觉模态, 我们把 SCFP 处理得到的图像特征 X ∈ R H/8,W/8,4C 作为输入, 利用 Patch embedding 将图像的三

V

维特征转换成一维序列矩阵 E, 如公式 (3) 所示. 接着, 通过线性投影计算出图像特征映射的 n 个 head 中的第 i 个

Q

中的 3 个向量 Q V 、K V 、V V , 如公式 (4) 所示, 其中, 可训练参数矩阵 W ,W ,W ∈ R d×d 分别代表一个线性层.

K

V

i i i

Q

K

Q i = E v ·W , K i = E v ·W , V i = E v ·W V i (4)

i

i

然后, 计算输入图像的第 i 个 head 的注意力权重矩阵 head i ∈ R (N+1)×(N+1) , 如公式 (5) 所示, 其中, d K 表示键 (K)

向量的维度, 决定了输入向量投影后的键的维度.

( )

Q i · K i

head i (Q,K,V) = Softmax √ ·V i (5)

d K

n 个 head 得到的注意力矩阵拼接到一起即完成多头注意力计算, 如公式 (6) 所示.

最后, 将

MHA(Q,K,V) = Concat(head 1 ,head 2 ,...,head n ) (6)

T

对于文本模态, 我们将文本编码器提取得到的文本特征 X ∈ R (L+1)×d 输入一个线形层, 得到 Q、K、V 矩阵, 如

公式 (7), 然后与图像共享相同参数的多头注意模块.

T

E t = Linear(X ) (7)

2.4 交叉注意力模块

在获得图像和文本的多头注意力矩阵后, 我们需要进行交叉注意力操作. 首先, 我们分别取文本编码得到的

Q t 矩阵与图像编码得到的 K v 、V v 进行注意力计算, 取图像编码得到的 Q v 矩阵与文本编码得到的 K t 、V t 进行注意

Attn v 、Attn t , 如公式 (8) 所示.

力计算, 得到注意力矩阵

Attn v = MHA(Q t ,K v ,V v ), Attn t = MHA(Q v ,K t ,V t ) (8)