Page 453 - 《软件学报》2025年第10期

P. 453

4850 软件学报 2025 年第 36 卷第 10 期

N

I

T

D = {I i ,T i } , N 表示每批数据集中文本-图像对的总数, 每个文本-图像对由一幅图像 和一个相应的文本描述 .

i=1

为了简单起见, 下文中省略下标 i.

A woman in blue

空间引空间引 jean shorts, light

通道去噪模块 导定位 ViT colored shoes and Transformer 随机语言掩码

CDM a pink top carries

SGL

a light colored

shoulder bag.

前景增强判别器 图像编码器 输入图像-文本对 文本编码器

多元交互注意力 MIA

H W

× × C

2 2

H W CA H W ×2C

×

× ×2C

4 4 4 4

H W

H W × ×4C

× ×4C H W CA 8 8

8 8 × ×4C ... ...

8 8

H W CA

× ×8C

16 16 图像特征 文本特征

映射 映射

L CMPM + L id + L div

语义一致特征金字塔 基于语义中心的隐式多尺度对齐

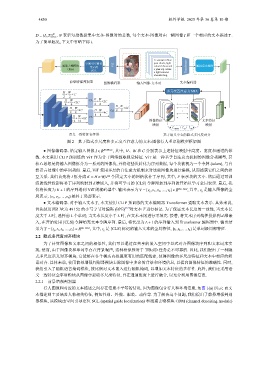

图 2 基于隐式多尺度和多元交互注意力的文本-图像行人重识别模型框架图

● 图像编码器. 给定输入图像 I ∈ R H×W×C , 其中, H、W 和 C 分别表示上述特征映射中高度、宽度和通道的维

数. 本文采用 CLIP 预训练的 ViT 作为骨干网络提取视觉特征. ViT 是一种基于自注意力机制的图像分类模型, 其

核心思想是将输入图像拆分为一系列的图像块, 并将这些块转化为序列数据, 每个块被视为一个令牌 (token), 与自

然语言处理中的单词类似. 最后, ViT 使用多层的自注意力机制来对这些图像块进行建模, 从而捕获它们之间的相

2

互关系. 我们首先将 I 拆分成 K = H ×W/P 个固定大小的网格状补丁序列, 其中, P 表示块的大小. 然后通过可训

练的线性投影将补丁序列映射到 d 维嵌入, 并将可学习的 [CLS] 令牌附加到序列的开始以学习全局表示. 最后, 我

{

K +1 的序列送到 ViT V = v g ,v 1 ,v 2 ,...,v k ∈ R (K+1)×d , 其中, v g 是输入图像的全

}

们将长度为 的编码器中. 输出表示为

局表示, {v 1 ,v 2 ,...,v k } 是补丁局部表示.

T , 本文使用 CLIP 预训练的文本编码器 Transformer 提取文本表示. 具体来说,

● 文本编码器. 对于输入文本

首先使用词汇量为 49 152 的小写字节对编码 (BPE) [32] 对文本 T 进行标记. 为了保证文本长度的一致性, 当文本长

度大于 L 时, 选择前 L 个单词; 当文本长度小于 L 时, 在文本末尾进行零填充. 接着, 将文本序列线性投影到 d 维嵌

入, 在开始处用 [CLS] 令牌填充文本令牌序列. 最后, 将长度为 L+1 的序列输入到 Transformer 编码器中. 输出结

{ } (L+1)×d

果为 T = t g ,t 1 ,t 2 ,...,t L ∈ R , 其中, t g 是 [CLS] 标记的输入文本的全局特征, {t 1 ,t 2 ,...,t L } 是单词级局部特征.

2.2 隐式多尺度对齐模块

为了计算图像和文本之间的相似性, 我们可以通过在共享的嵌入空间中显式对齐图像块序列和文本词来实

现. 然而, 由于图像块和单词中存在背景噪声, 这种相似性对于 TIReID 任务是不可靠的. 因此, 我们提出了一种隐

式多尺度语义对齐模块, 它能够在各个模态内挖掘更有用的匹配线索, 使得图像的多尺度特征和文本中相应的短

语对齐. 具体来说, 使用前景增强判别器模块去除图像中多余的背景和环境信息, 以提高图像特征的准确性. 同时,

我们引入了随机语言掩码模块, 按比例对文本嵌入进行随机掩码, 以增加文本特征的多样性. 此外, 我们还采用语

义一致特征金字塔模块从图像中提取多尺度特征, 并在通道维度上进行融合, 以充分利用图像信息.

2.2.1 前景增强判别器

行人图像和对应的文本描述之间存在信息不平等的情况. 因为图像包含行人和环境信息, 如图 1(a) 所示; 而文

本描述则主要涵盖人物相关特征, 例如性别、外貌、服装、动作等. 为了解决这个问题, 我们提出了前景增强判别

器模块, 该模块由空间引导定位 SGL (spatial guide localization) 和通道去噪模块 CDM (channel denoising module)