Page 365 - 《软件学报》2025年第10期

P. 365

4762 软件学报 2025 年第 36 卷第 10 期

因此我们将选取的基准方法分为基于传统预训练语言模型的方法和基于大语言模型的方法两大类, 具体如下所述.

(1) 基于传统预训练语言模型的方法

基于传统预训练语言模型的方法使用参数量较小的模型以微调全部参数的方式训练模型.

● T5 [13] . T5 使用 encoder-decoder 架构采用生成的方式来得到结果, 在本次实验中我们采用和 Zhang 等人 [40]

一样的实验设置.

[6]

● DiaASQ . DiaASQ 将 RoBERTa 作为编码器, 引入了一个多视图的交互层来增强模型对对话的理解, 在多

视图的交互层中引入 3 个注意力掩码矩阵来捕捉对话中的信息. 此外, 该文将四元组关系抽取转化为不同词元对

的关系矩阵. 本次实验中我们采用和该工作一样的实验设置.

(2) 基于大语言模型的方法

基于大语言模型的方法主要被分为两类: 1) 以 Zero-Shot 的方式通过提示词直接获得结果; 2) 通过低资源微

调的方式获得结果. 具体介绍如下.

● ChatGPT (https://platform.openai.com/docs/overview) (Zero-Shot). 在这条基线中, 我们采用 GPT-3.5 Turbo 复

[41]

现了 ChatIE 中提出的方法. 在此方法中, 先对观点描述语进行提取, 之后分别提取出观点描述语指向的属性实体、

代指提及以及观点描述语的情感极性.

● ChatGPT (ICL). 在这条基线中, 我们采用 GPT-3.5 Turbo, 以 ICL 的方式得到结果. 具体来说, 在每一条输入

数据中, 我们从训练集选取一条数据作为上下文示例.

● MACR (Zero-Shot). 在这条基线中, 我们采用 GPT-3.5 Turbo, 以 Zero-Shot 的设定进行多代理反思. 具体来

说, 首先通过 ICL 的方式得到出主任务和 3 个代理任务的结果, 之后采用一致性增强的反思来得到最终的抽取

结果.

● ChatGLM3. ChatGLM3 基于 GLM [23] 的一款大模型, 在 GLM 中, 模型通过自回归空白填充进行训练.

ChatGLM3 在训练过程中训练了大量的中文数据, 因此该模型对中文有着较强的理解能力, 在这条基线中, 我们采

用与 T5 一样的范式, 通过 LoRA 来微调 ChatGLM3.

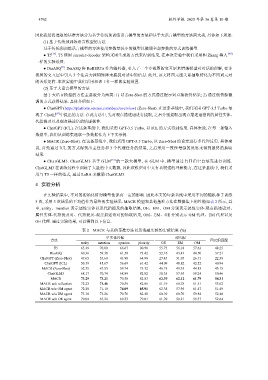

4 实验分析

在实验结果中, 不同的初始化值对模型性能有一定的影响. 因此本文的每条基线中采用不同的随机种子训练

3 次, 采用 3 次结果的平均值作为最终的实验结果. MACR 模型和其他基准方法在数据集上的性能如表 2 所示, 其

中, entity、mention 表示属性实体以及代指提及的抽取结果, OE、EM、OM 分别表示属性实体-观点描述语对、

属性实体-代指提及对、代指提及-观点描述语对的抽取结果, OM、EM、OE 分别表示 OM 代理、EM 代理以及

OE 代理. 通过实验结果, 可以得到以下信息.

表 2 MACR 与其他基准方法以及消融实验的实验结果 (%)

单实体匹配 对匹配

方法 四元组匹配

entity mention opinion ploarity OE EM OM

T5 65.39 70.00 66.67 80.90 55.75 56.18 57.63 48.25

DiaASQ 60.36 59.38 61.58 73.42 52.16 43.43 44.50 37.21

ChatGPT (Zero-Shot) 47.65 55.60 41.88 64.99 27.43 31.05 26.71 22.38

ChatGPT (ICL) 50.39 45.67 56.69 61.42 44.09 48.82 42.52 40.94

MACR (Zero-Shot) 52.35 67.53 59.74 75.32 46.75 49.35 44.15 43.15

ChatGLM3 68.17 70.74 68.89 82.82 58.35 57.95 59.24 50.46

MACR 73.29 73.21 70.58 82.83 62.39 62.12 61.79 54.31

MACR w/o reflection 72.23 73.46 70.59 82.86 61.19 60.78 61.51 53.02

MACR w/o OM agent 72.28 71.10 74.09 85.91 62.38 57.95 61.47 51.49

MACR w/o EM agent 73.18 73.26 70.70 82.48 60.39 60.70 59.84 52.48

MACR w/o OE agent 70.04 67.26 69.33 79.01 61.70 58.21 59.37 52.64