Page 364 - 《软件学报》2025年第10期

P. 364

刘一丁 等: 针对 LLM 对话属性情感理解的多代理一致性反思 4761

后, “有个演员”不会被修改为代指提及.

3) 本文只标注评价对象, 对于对话者本身的一些属性不做标注, 比如对话中对话者关于自身的评价“我真笨”,

那么我们不会标注“我”, 并且也不会标注观点描述语“真笨”.

● 代指提及

我们将对话中具体程度不如属性实体的提及标注为代指提及, 比如图 1 的对话中, 在第 2 句和第 3 句中出现

了“她”, 但是“她”的具体程度不如第 1 句出现的“杨幂”, 因此我们将其标注为代指提及.

● 情感倾向

我们根据观点描述语的情感程度将情感倾向划分为积极、消极和中性这 3 大类.

特别地, 因为 OE 代理的定义, 一段话中相同的属性实体可能被标注多次 (因为一句话中可能会多次出现同一

属性实体). 例如一句话如果出现了两次“杨幂”, 那么我们对这两个“杨幂”都进行标注.

数据集由 10 名领域内专业人员进行标注, 当标注结果发生不一致时, 有一名评估专家会做出最后的评估. 标

注好的数据集中一共有 11 300 个四元组, 其中包含 11 266 个属性实体以及 7 675 个代指提及, 为了验证模型的能

力, 我们按照 8:1:1 的比例从数据集中划分出训练集, 验证集和测试集. 最终的数据集中大语言模型对话属性情感

理解任务的四元组数量以及子任务数量如表 1 所示, 其中, Main agent、EM agent、OE agent、OM agent 表示情感

理解任务、EM 任务代理、OE 任务代理、OM 任务代理的训练数据量. 参考 Cai 等人 [36] 的工作, 我们采用两位标

注者之间的 Macro-F1 作为数据标注中一致性衡量指标, 标注好的数据集中属性实体, 代指提及以及观点描述语

的 F1 分数为分别为 89.50%、72.51% 以及 86.77%.

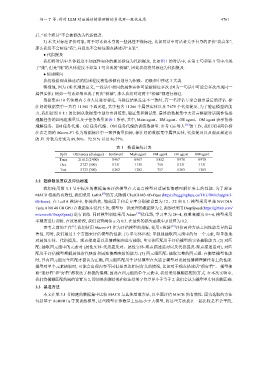

表 1 数据集统计表

Split Utterances (dialogue) Sentiment Main agent EM agent OE agent OM agent

Train 21 612 (2 400) 8 967 8 967 5 852 8 970 8 970

Dev 2 727 (300) 1 131 1 131 758 1 131 1 131

Test 2 723 (300) 1 202 1 202 757 1 203 1 203

3.2 超参数设置以及评估标准

我们使用第 3.1 节中标注的数据集来评估模型在大语言模型对话属性情感理解任务上的性能. 为了验证

MACR 框架的有效性, 我们采用 LoRA [37] 的方式微调 ChatGLM3-6B-Base (https://huggingface.co/THUDM/chatglm3-

6b-base). 在 LoRA 模块中, 矩阵的秩, 缩放因子和丢弃率分别被设置为 12、32 和 0.1. 模型采用单张 NVIDIA

Tesla A100 40 GB GPU 在数据集中迭代 5 次, 模型每一批处理的数据量为 2, 训练时采用 DeepSpeed (https://github.com/

microsoft/DeepSpeed) 进行训练. 同时模型训练采用 Adam [38] 优化器, 学习率为 2E–4, 权重衰减为 5E–4, 模型采用

半精度进行训练. 在反思阶段, 我们设置阈值 α 为 0.5. 在最终的损失函数中 β 设置为 0.2.

参考之前的工作 [6] , 我们使用 Macro-F1 作为评估模型的指标, 使用 t 检验 [39] 评价两种方法之间性能差异的显

著性. 同时, 我们通过 3 个方面来评估模型的性能. (1) 单实体匹配: 单独地抽取四元组中的每一个元素, 即单独地

对属性实体、代指提及、观点描述语以及情感倾向进行抽取, 单实体匹配用于评估模型的实体抽取能力. (2) 对匹

配: 抽取四元组中的元素对 (属性实体-代指提及对、属性实体-观点描述语对以及代指提及-观点描述语对), 对匹

配用于评估模型理解属性指代映射和属性情感映射的能力. (3) 四元组匹配: 抽取完整的四元组. 在衡量模型性能

时, 只有四元组完全匹配才被认为正确, 四元组匹配用于评估模型在大语言模型对话属性情感理解任务上的性能.

模型对单个元素抽取时, 可能会出现内容不同但是表达相同含义的情况, 比如对于观点描述语“很好看”、 模型抽

取“很好看”和“好看”都表达了积极的情感, 因此在四元组的单个元素中, 我们采用模糊匹配的方式. 在本次实验中,

我们将模糊匹配的阈值设置为 2, 即如果预测结果和标注结果字符差异小于等于 2, 我们会认为模型单实体预测正确.

3.3 基准方法

本文在第 3.1 节构建的数据集中比较 MACR 与其他基准方法, 以全面评估 MACR 的有效性. 因为选取的方法

包括基于 RoBERTa 等预训练模型, 这些模型在参数量上远远小于大模型, 将这些方法放在一起比较是不公平的,