Page 315 - 《软件学报》2025年第10期

P. 315

4712 软件学报 2025 年第 36 卷第 10 期

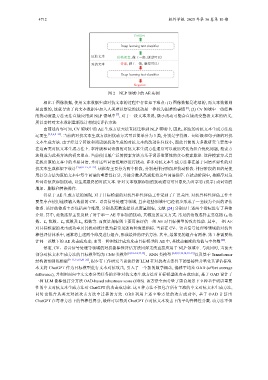

Positive

Deep learning text classifier

原始文本 价格便宜, 做工一般, 版型可以!

对抗文本 价廉, 做工一般, 版型可以!

Deep learning text classifier

Negative

图 2 NLP 领域中的 AE 实例

相比于图像数据, 使用文本数据生成对抗文本的过程中存在如下难点: (1) 图像数据是连续的, 而文本数据则

是离散的, 这就导致了向文本数据中加入人类难以察觉的扰动是一件较为困难的事情 [6] ; (2) CV 领域中一些经典

的扰动度量方法无法直接应用到 NLP 领域中 [7] , 对于一段文本来说, 微小改动可能会直接改变整段文本的语义,

所以需针对文本数据重新设计相似度评估方法.

由前述内容可知, CV 领域中的 AE 生成方法无法直接迁移到 NLP 领域中, 因此, 相应的对抗文本生成方法应

运而生 [3,4,6,8−23] . 当前的对抗文本生成方法用扰动方式可以简单分为 3 类, 分别是字符级、词语级和句子级的对抗

文本生成方法. 由于经过字符级和词语级扰动生成的对抗文本的改动往往较小, 因此目前的大多数研究主要集中

在这两类对抗文本生成方法上. 字符级和词语级的对抗文本生成方法通常可以被形式化为组合优化问题, 搜索方

法则成为此类方法的研究重点. 当前使用最广泛的搜索方法为基于词语重要性的贪心搜索算法. 这种搜索方式旨

在找出原始文本中的重要词语, 并对这些词语按顺序进行扰动. 许多对抗文本生成方法都在基于词语重要性的对

抗文本生成框架下设计 [3,4,10−15,17−21] . 该框架主要分为两个阶段, 分别是排序阶段和扰动阶段. 排序阶段的目的是使

用打分方法为原始文本中每个词语的重要性打分, 并按分数从高到低将这些词语排序. 在扰动阶段中, 按顺序对这

些词语依次添加扰动, 以生成最终的对抗文本. 针对文本数据添加的扰动通常可具象化为对字符 (汉字) 或词语的

增加、删除和替换操作.

得益于 AE 生成方法的涌现, 对于目标模型的对抗鲁棒性评估工作受到了广泛关注. 对抗鲁棒性评估工作主

要集中在使用连续输入数据的 CV、语音信号处理等领域, 且在这些领域中已经初步形成了一套较为全面的评估

体系. 该评估体系主要包括两个维度, 分别是范数选择以及度量指标, 文献 [24] 分别对上述两个指标进行了具体

介绍. 其中, 范数选择主要反映了对于单一 AE 中添加的扰动, 其幅度的定义方式. 常见的范数选择主要包括 L 0 范

数、 L 1 范数、 L 2 范数及 L ∞ 范数等. 而度量指标则主要用来评估一组 AE 对目标模型的攻击性能. 其中, 一组 AE

对目标模型的攻击成功率及其扰动统计量为最常见的两种度量指标. 当前在 CV、语音信号处理等领域的对抗鲁

棒性评估体系中, 通常将上述两个维度进行组合, 形成最终的评估方法. 其中, 最常见的组合有两种. 第 1 种需要统

计同一范数下的 AE 攻击成功率; 而另一种则统计成功攻击目标模型的 AE 中, 其扰动幅度的均值与中位数 [24] .

然而, CV、语音信号处理等领域的对抗鲁棒性评估方法同样无法直接应用于 NLP 领域中. 与此同时, 当前大

部分对抗文本生成方法的目标模型均为 CNN 类模型 [4,12−14,17,19] 、RNN 类模型 [3,4,8,9,12,14,17−19] 以及基于 Transformer

结构的预训练模型 [9−11,15,16,20−22] , 很少有工作研究当前流行的 LLM 在对抗攻击条件下的鲁棒性并量化其评估标准.

本文将 ChatGPT 作为目标模型进行文本对抗攻击, 引入了一个新的数学概念, 偏移平均差 OAD (offset average

difference), 并利用面向中文文本分类任务的多种对抗文本生成方法对目标模型的攻击成功率, 基于 OAD 设计了

一种 LLM 鲁棒性打分方法 OAD-based robustness score (ORS). 该方法全面考量了黑盒场景下 9 种基于词语重要

性的中文对抗文本生成方法对 ChatGPT 的攻击成功率. 这 9 种方法不仅包含所有主流的中文对抗文本生成方法,

同时也包含从英文对抗攻击方法中迁移的方法. ORS 利用上述 9 种方法的攻击成功率, 基于 OAD 计算出

ChatGPT 在每种方法下的鲁棒性得分, 最终可以得到 ChatGPT 在对抗文本攻击下的平均鲁棒性分数. 该方法不但