Page 218 - 《软件学报》2025年第8期

P. 218

田丽丽 等: 因果时空语义驱动的深度强化学习抽象建模方法 3641

MDP 能够保持与原始 MDP 中相同的最优策略 [7] .

定义 2. 抽象马尔可夫模型. 设 M= (S ,A,R,P,γ) 表示真实的 MDP, 其对应的抽象 MDP 表示为 ¯ M= ( ¯ S , ¯ A, ¯ P, ¯ R,γ),

Φ : S → ¯ S 表示状态抽象函数, Φ(s) ∈ ¯ S 为抽象状态, 其逆映射表示为 Φ (¯s), 其中 ¯ s ∈ ¯ S . ¯ S 是与抽象函数 Φ 对应的

−1

−1

抽象状态集, Ψ : A → ¯ A; Ψ(a) ∈ ¯ A 表示动作抽象函数, 其逆映射表示为 Ψ (¯a), ¯a ∈ ¯ A. ¯ A 是与动作抽象函数 Ψ 对应

的抽象动作集.

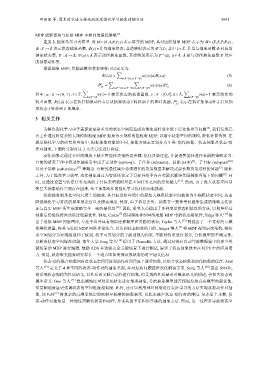

根据抽象 MDP, 奖励函数和状态转移可以定义为:

∑

¯ R(¯s,¯a) = w(s)v(a)R(s,a) (5)

s∈Φ −1 (¯s), a∈Ψ −1 (¯a)

∑ ∑

¯ P ¯ a ′ = w(s)v(a)P a (6)

¯ s¯s s∈Φ −1 (¯ s), a∈Ψ −1 (¯ a) s ′ ∈Φ −1 (¯ s ′ ) ss ′

∑ ∑

其中, w : S → [0, 1] , ¯s ∈ ¯ S , w(s)= 1 表示状态的权重函数, v : A→ [0,1], ¯a ∈ ¯ A, v(a)= 1 表示动作的

s∈Φ −1 (¯s) a∈Ψ −1 (¯a)

权重函数. ¯ R(¯s,¯a) 表示在执行抽象动作 ¯ a 后从抽象状态 转移到 ¯ s 的即时奖励, ¯ P ¯ a ¯ s¯s ′ 表示在执行抽象动作 ¯ a 后从抽

′

¯ s

′

象状态 ¯ s 转移到 ¯ s 的概率.

3 相关工作

为解决强化学习由于需探索复杂多变的状态空间而造成决策生成时效率低下泛化性差等问题 [6] , 我们发现已

有工作通过将复杂的大规模细粒度 MDP 抽象为小规模的粗粒度 MDP, 以缩小状态空间的规模, 降低计算负担. 在

深度强化学习的研究和应用中, 根据抽象对象的不同, 抽象方法主要划分为 3 类: 动作抽象、状态抽象及状态-动

作对抽象, 下面将分别对这 3 大类方法进行总结.

动作抽象是通过在时间维度上减少智能体决策所需步骤, 优化决策过程, 并促进智能体进行长期的策略学习.

[5]

目前的研究工作中将动作抽象引申出了宏动作 (options)、子任务 (subtasks)、技能 (skill) 、子目标 (subgoal) [12]

以及子策略 (sub-policy) [13] 等概念. 有研究通过减少必须进行的决策数量来解决需要长期决策过程的问题 [5] . 除此

之外, 为了提高学习效率, 动作抽象通过为智能体设定子目标并给予内在奖励来解决奖励稀缺环境下的问题 [8] . 同

时, 还通过设置与特定任务无关的子目标来增强模型在不同任务之间的泛化能力 [14] . 然而, 由于庞大状态空间导

致巨大抽象动作空间存在困难, 基于抽象动作的强化学习优化仍面临挑战.

状态抽象则是在空间尺度上的抽象, 其目标是将环境中的原始大规模状态空间抽象为小规模状态空间, 从而

降低强化学习算法的样本复杂度以及探索难度. 然而, 由于信息丢失、抽象非一致性等问题所生成的策略无法保

证与真实 MDP 所生成策略完全一致的最优性 [15] . 因此, 研究人员提出了多种度量状态相似性的方法, 以期望经过

[7]

抽象后仍能保持原决策过程最优性. 例如, Castro 使用深度神经网络度量 MDP 中的状态相似性; Taïga 等人 [16] 提

出了近似 MDP 同胚理论, 专注于合并具有相似迁移概率和奖励的状态; Taylor 等人 [17] 则提出了一个宽松的互模

拟等价度量, 将其与近似 MDP 同胚理论结合, 以达到状态抽象的目的. Junges 等人 [3] 将 MDP 视为层次结构, 将状

态空间划分为宏观级别和子级别, 将不可再划分的子级别视为约束, 不断对约束进行划分, 分析模型的不确定性,

以解决状态空间爆炸问题. 清华大学 Feng 等人 [18] 提出了 DenseRL 方法, 通过对现有自动驾驶数据集中的安全关

键场景的 MDP 进行编辑, 鼓励 ADS 在这些安全关键场景下进行测试, 展示了状态抽象技术在 ICPS 中的应用潜

力. 但是, 状态聚类抽象研究存在一个难点即如何保证原状态的时空语义信息.

状态-动作联合抽象同时在状态空间尺度和动作时间尺度上进行抽象, 以结合状态抽象和动作抽象的优点. Abel

等人 [19] 定义了 4 种不同的状态-动作对的抽象类别, 并对原始问题提供次优解决方案. Song 等人 [20] 提出 SIEGE,

将系统状态规约为性质语义, 以性质语义联合动作进行抽象, 但是规约性质缺乏对概率语义的描述, 会损失状态的

概率语义. Guo 等人 [21] 提出测地度量对系统状态进行聚类抽象, 考虑抽象模型能否保留原始真实模型的最优性,

但是测地度量更强调状态的空间维度相似度. 此外, 还可以利用神经网络进行表征学习的方法实现状态动作对抽

象, 如 FuN [22] 将复杂的高维系统空间映射至低维的抽象表示, 以此来减少状态-动作对的维度. 从本质上来看, 状

态-动作对抽象是一种通过离散化状态和动作, 并求其笛卡尔积后实施的抽象方法. 然而, 这一过程常导致状态空