Page 217 - 《软件学报》2025年第8期

P. 217

3640 软件学报 2025 年第 36 卷第 8 期

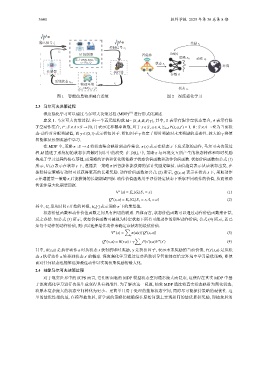

输入信号 i t

奖励 r t

控制信号 c t

s t

AI 控制器 智能体 DNN

策略 π θ

基于 DNN、DRL 等 动作 a t

c t =C(s t , i t )

状态 s t

环境

传感器 执行器

参数 θ

系统状态 s t+1

物理环境 c t

s t+1 =M(s t , c t )

状态 s t

图 1 智能信息物理融合系统 图 2 深度强化学习

2.3 马尔可夫决策过程

深度强化学习可以通过马尔可夫决策过程 (MDP) [11] 进行形式化描述.

定义 1. 马尔可夫决策过程. 由一个五元组构成 M= (S,A,R,P,γ), 其中, S 表示有限非空状态集合, A 表示有限

非空动作集合, P : S × A×S → [0, 1] 表示迁移概率函数, 对于 s ∈ S , a ∈ A, Σ s ′ ∈S P(s,a,s ) = 1. R : S × A → R 为当前状

′

态-动作对分配奖励值, 而 γ ∈ (0,1) 表示折扣因子. 折扣因子 γ 决定了即时奖励对未来奖励的重要性. 较大的 γ 将使

智能体从长期奖励中学习.

在 MDP 中, 策略 π : S → A 将状态集合映射到动作集合. π(s) 表示在状态 s 下应采取的动作, 马尔可夫决策过

程 M 描述了系统初始状态在离散时间步中的演变. 在 DRL 中, 策略 π 与环境交互所产生的状态转移和即时奖励

构成了学习过程的核心基础, 而策略的评估和优化则依赖于状态价值函数和动作价值函数. 状态价值函数如公式 (1)

所示, V (s) 表示在状态 下, 遵循某一策略 π 后智能体能获得的累计奖励期望值. 该值越高表示从该状态出发, 在

s

按照特定策略行动时可以获得更高的长期奖励. 动作价值函数如公式 (2) 所示, Q(s,a) 表示在状态 下, 采取动作

s

a 并遵循某一策略 π 后能获得的长期期望回报. 动作价值函数用于评估特定状态下采取不同动作的价值, 从而帮助

智能体最大化期望回报.

π

V (s) = E π [G t |S t = s] (1)

π

Q (s,a) = E π [G t |S t = s,A t = a] (2)

t

其中, G t 是从时间 开始的回报, E π [·] 表示策略 π 下的期望值.

状态价值函数和动作价值函数之间具有密切的联系. 具体而言, 状态价值函数可以通过动作价值函数来计算,

反之亦然. 如公式 (3) 所示, 状态价值函数可被视为特定状态下所有可能动作的期望动作价值; 公式 (4) 所示, 若已

知每个动作的动作价值, 则可以选择最佳动作来确定该状态的最优价值.

∑

π

π

V (s) = π(a|s)[Q (s,a)] (3)

a

∑

π

π

Q (s,a) = R(s,a)+γ P(s |s,a)V (s ) (4)

′

′

s ′

其中, R(s,a) 是执行动作 a 时从状态 获得的即时奖励, γ 是折扣因子, 表示未来奖励的当前价值, P(s |s,a) 是从状

s

′

s 的概率. 深度强化学习通过这些函数引导智能体在给定环境中学习最优策略, 即使

′

态 s 执行动作 a 转移到状态

面对任何状态也能够选择最佳动作以实现长期奖励的最大化.

2.4 抽象马尔可夫决策过程

对于现实世界中的 ICPS 而言, 它们所面临的 MDP 模型状态空间通常庞大而复杂, 这使得在真实 MDP 中基

于深度强化学习进行决策生成变得具有挑战性. 为了解决这一问题, 抽象 MDP 通过将真实状态映射为简化状态,

将原本复杂庞大的状态空间转化为更小、更简单且易于处理的抽象状态空间, 同时尽可能保持策略的最优性. 这

里的最优性指的是, 在模型抽象后, 所学到的策略仍能确保在原始问题上实现相同的最优累积奖励, 即抽象后的