Page 297 - 《软件学报》2025年第4期

P. 297

樊铭瑞 等: 基于深度学习的多视图立体视觉综述 1703

了基于知识蒸馏的自监督网络, 包括自监督教师训练和基于蒸馏的学生训练. 其中, 教师模型根据光度一致性和特

征一致性进行自监督训练, 并将教师模型中的知识转移到学生模型中.

表 2 中总结了无监督多视图立体视觉的方法. 无监督方法的关键是准确对应视图之间的关系. 目前, 无监督学

习的方法已经能够有效缓解监督模糊和光照变化敏感等问题.

表 2 无监督和自监督多视图立体视觉方法对比

方法 特点 优点 缺点

Unsup_MVS [16] 利用多视图间光度一致性 不再依赖有标签数据 对光照变化敏感

MVS 2[59] 对所有视图对称 使深度图有相同的3D几何结构 消耗大量的GPU内存

3

M VSNet [61] 加入语义信息的特征损失 能够通过特征感知场景 对光照变化敏感

引入流深度一致性损失和不确 处理前景监督模糊和后景监督

U-MVSNet [63] 需要预训练语义特征

定性感知的自训练损失 无效问题

KD-MVS [66] 采用知识蒸馏的思想 结果超越教师模型 不适用于小规模数据集

Ray 2

2.3 基于辐射场的方法

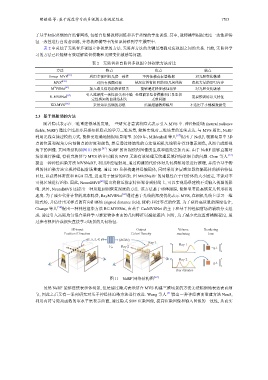

随着隐式表示在三维重建领域的发展, 一些研究者尝试将隐式表示引入 MVS 中. 神经辐射场 (neural radiance

fields, NeRF) 通过全连接多层感知机隐式的学习三维场景, 能够实现对三维场景的连续表达. 与 MVS 相比, NeRF

利用光线直接建模的方式, 能够更准确地捕捉场景细节. 2020 年, Mildenhall 等人 [67] 提出了 NeRF, 根据场景中 3D

点的位置和视角方向预测点的密度和颜色, 然后通过体渲染的方法沿相机光线积分得到像素颜色, 从而合成新视

角下的图像. 其网络结构如图 11 所示 [67] . NeRF 的出现使得图像的生成和渲染更加真实. 由于 NeRF 能够直接对

场景进行推理, 有研究将其与 MVS 结合以解决 MVS 无法有效处理无纹理区域和场景细节的问题. Chen 等人 [17]

提出一种神经渲染方法 MVSNeRF, 利用神经辐射场, 通过构建的代价体对几何感知场景进行推理, 并结合基于物

理的体渲染方法实现神经辐射场重建. 通过 3D 卷积构建神经编码体, 同时采用多层感知器将编码体的插值特征

回归, 以获得体密度和 RGB 亮度, 进而用于最后的渲染. 但 MVSNeRF 的局限性在于代价体的大小固定, 不能对不

可视区域进行渲染. 因此, NeuralMVS [68] 提出将附近像素特征聚合到射线上, 可以实现场景建模不受输入视图的影

响. 此外, NeuralMVS 还提出一种从粗到细恢复深度的方法. 该方法基于球体跟踪, 能够显著提高恢复几何形状的

速度. 为了减少代价计算的成本耗费, RayMVSNet [69] 通过基于光线的深度优化表示 MVS, 在相机光线上学习一维

隐式场, 并估计出采样点的有向距离场 (signed distance field, SDF) 和过零点的位置. 为了获得高质量的深度估计,

Change 等人 [70] 提出一种神经渲染方法 RC-MVSNet, 由基于 CasMVSNet 的主干和基于神经辐射场的辅助分支组

成. 通过引入高斯均匀混合采样学习靠近物体曲面的几何特征以减轻遮挡. 同时, 为了减少光度监督模糊程度, 通

过参考视图合成损失直接学习场景的几何特征.

5D input Output Volume Rendering

Position+Direction Color+Density rendering loss

(x, y, z, θ, ϕ) (RGBσ)

Ray 1 σ Ray 1 2

F Θ −g.t.

2

σ Ray 2 2

−g.t.

2

Ray distance

图 11 NeRF 网络结构图 [67]

虽然 NeRF 能够连续表示体场景, 但是通过隐式表示结合 MVS 构建三维场景的方法无法精细地表达表面细

节, 因此之后又有一系列研究对基于神经体渲染方法进行改进. Wang 等人 [71] 提出一种神经表面重建方法 NeuS,

利用有符号距离函数的零水平集表示曲面, 通过隐式 SDF 渲染图像, 提高渲染图像和输入图像的一致性, 从而实