Page 158 - 《软件学报》2025年第4期

P. 158

1564 软件学报 2025 年第 36 卷第 4 期

实体在类型匹配阶段的性能.

QA-driven slot filling framework (QASF) [17] : 将槽填充任务转换为答案抽取任务, 并加入了弱监督学习.

Reading comprehension for slot filling (RCSF) [18] : 使用大量的 MRC 语料对模型进行预训练, 将每个槽类型转换

为查询问题, 使用模型抽取相应的槽实体.

[20]

Abundant information slot filling generator (AISFG) : 将槽填充任务转换为生成式任务, 使用领域、槽类型、

样例信息构造一个新奇的查询模板, 引导模型生成相应的槽实体.

Slot-prefix prompting and attention relationship descriptor (SPFT) [21] : 在输入中加入槽前缀序列并且使用自定义

的注意力描述特征对当前词进行标签预测.

3.3 数据集

本文首先在用于槽填充任务主流评测的公开数据集 SNIPS 上进行实验 [22] . SNIPS 数据集的信息如表 2 所示,

该数据集包含 7 个领域, 每个领域都有其特定的槽类型, 领域之间也存在相同的槽类型, 共 39 个. 每个领域的训练

样本数在 2 000 左右. 与以往的研究相同, 我们选取其中一个领域的数据作为目标数据, 然后选择其他领域的数据

领域数据) 将不同领域作为目标领域得到的模型性能的

作为训练数据, 以此来设置领域迁移的场景. 数据集中的槽类型分为两个部分, 对于不同领域之间共存的槽类型称

为领域共享槽类型, 对于仅存在于当前领域的槽类型称为领域特定槽类型. 为了进一步验证模型的泛化能力和实

用性, 本文在另一个面向导航和事件查询的语义解析数据集 TOP 上进行验证 [23] , TOP 中包含 36 个槽类型, 其测

试集样本数有 9 042 条, 复杂度相对较高, 更能展现模型的泛化能力. 与之前的工作一样, 本文使用 SNIPS 中的 7

个领域作为源域数据对 TOP 测试集进行评估.

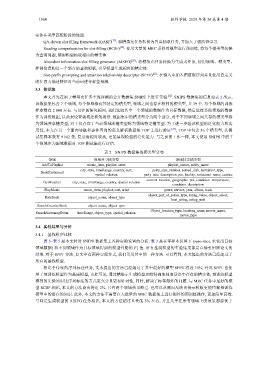

表 2 SNIPS 数据集的槽类型分布

领域 领域共享槽类型 领域特定槽类型

AddToPlaylist music_item, playlist, artist playlist_owner, entity_name

city, state, timeRange, country, sort, party_size_number, served_dish, restaurant_type,

BookRestaurant

spatial_relation party_size_description, poi, facility, restaurant_name, cuisine

current_location, geographic_poi, condition_temperature,

GetWeather city, state, timeRange, country, spatial_relation

condition_description

PlayMusic music_item, playlist, sort, artist genre, service, year, album, track

object_part_of_series_type, rating_value, object_select,

RateBook object_name, object_type

best_rating, rating_unit

SearchCreativeWork object_name, object_type -

Object_location_type, location_name, movie_name,

SearchScreeningEvent timeRange, object_type, spatial_relation

movie_type

3.4 实验结果与分析

3.4.1 基线模型比较

表 3−表 5 是本文针对 SNIPS 数据集上各种实验设置的分析. 表 3 是在零样本设置下 (zero-shot, 未使用目标

F1 值. 所有基线模型的实验结果都是直接引用原论文的

结果. 对于 SPPT 方法, 原文中有两种实现方式, 我们引用其中的一种方法. 可以看到, 本文提出的方法已经超过了

所有的基线模型.

相比于传统的序列标注任务, 文本提出的方法已经超过了其中最好的模型 SPPT 将近 10%, 并且 SPPT 也使

用了预训练模型作为基座模型, 由此可见, 通过槽提示生成模型更能精确地抽取话语中存在的槽实体, 预训练模型

得到的先验知识比序列标注的方式更充分且更有针对性. 同时, 解决了标签爆炸的问题. 与 MRC 任务中最好的模

型 RCSF 相比, 本文的方法高出将近 2%, 只有两个领域效果略差. 也可以从侧面反映出提示模板更能挖掘预训练

模型中的潜在的知识. 此外, 本文的方法不需要在大批量的 MRC 数据集上进行额外的预训练操作, 更加简单高效.

与同是生成模型的 AISFG 任务相比, 本文的方法超过其性能 3% 左右, 并且几乎在所有领域上的效果都要优于