Page 194 - 《软件学报》2021年第11期

P. 194

3520 Journal of Software 软件学报 Vol.32, No.11, November 2021

每一集合的扰动数据δ′[i],初始优化系数为 r 0 .在保持攻击成功的前提下,对集合内的数据进行压缩,并

在迭代的过程中逐步增大优化系数.直到扰动δ′无法攻击成功,则停止压缩该集合的扰动数据.当所有

集合都经过该优化过程,返回更新后的扰动和对抗样本.

3 实验评估

本节通过在 ImageNet 数据集 [41] 上实验来验证本文提出的方法在黑盒攻击场景下的有效性.主要包含以下

内容:第 3.1 节介绍实验设置的相关内容;第 3.2 节讨论 ES-Attack 攻击方法相关的参数设置实验;第 3.3 节为

AM-Com 扰动压缩优化方法的相关实验;第 3.4 节将本文提出的方法与 4 种相关工作进行对比;第 3.5 节为对抗

训练实验.

3.1 实验设置

本文从 ImageNet 数据集中随机选择 1 000 张图像作为实验测试数据.相比于非目标攻击,目标攻击更具有

难度与挑战性,因此所有的实验都是基于目标攻击进行的.为了公平地对比,每张测试图像的攻击标签 y 将随机

选择,并在实验过程中保持不变.

为了探讨不同模型之间的内在特性,本文将基于 7 种不同结构的神经网络模型进行讨论,包括 4 种预训练

[8]

[7]

[8]

[6]

模型 VggNet-16 、InceptionNet-v3 、ResNet-50 和 ResNet-101 以及 3 种通过对抗训练 [42] 得到的鲁棒防御

模型 Adv-Inception、Inception-v3 ens3 和 Inception-v3 ens4 .以下实验将这 7 种网络模型简称为 Vgg-16、Inc-v3、

Res-50、Res-101、Adv-Inc、Inc-v3 ens3 和 Inc-v3 ens4 .在第 3.2 节与第 3.3 节的实验中,本文主要基于广泛部署于

实际场景的 4 种预训练模型来寻找提出方法的最优参数,且在第 3.4 节的实验中加入 3 种对抗防御模型进行测

试,验证提出方法的泛化性和鲁棒性.

实验的评估指标包括:(1) 交互查询次数(query numbers,简称 QN) [28,29] ,即攻击过程中查询目标模型输出结

果的次数,次数越少,则代表攻击效率越高;(2) L p 距离范数(L p -norm),用于衡量扰动幅度 [22,40] ,定义为

⎛ n p ⎞ − p

|| ||δ p ⎜ = |δ i | ⎟∑ (11)

⎝ i= 1 ⎠

本文方法选择平均 L 2 范数作为整体扰动幅度的评估指标.扰动的 L 2 范数越小,意味着对初始图像修改的程

度越小,更不容易被人类的视觉系统所感知.考虑到本文提出方法在黑盒攻击的过程中存在随机性,因此相关实

验中都运行 5 次进行统计,并且记录测试数据的平均结果.

所有的黑盒攻击都在 Tensorflow 框架下进行测试.其中,

• 算法 1(ES-attack 方法)的参数设置如下:单位扰动幅值约束ε=0.063(图像像素值域归一化为 x∈[0,1]),

5

最大迭代次数 T=2×10 ,随机采样数量 M=10,协方差矩阵的标准差σ=0.005,步长α=1.0,协方差矩阵的维

度 m=70×70×3,搜索路径学习率 c=0.01,协方差矩阵学习率 c 1 =c 2 =0.001.

• 算法 2(AM-Com 方法)的参数的设置如下:初始压缩率 r 0 =0.75,最大压缩率 r max =0.9,分组数量 N=100.

相关参数的详细讨论见第 3.2 节与第 3.3 节的实验.

3.2 ES-Attack方法相关参数实验

本节将验证 ES-Attack 黑盒攻击方法的有效性,并探讨不同的参数选择对结果的影响.经过实验发现,协方

差矩阵的维度 m,搜索路径的学习率 c 与步长参数α的设置对攻击结果产生较大的影响.

• 协方差矩阵的维度 m 实验.

本文考虑 5 种大小的协方差矩阵维度 m=l×l×3,即 30×30×3,50×50×3, 70×70×3,90×90×3 与 110×110×3,通过

ES-Attack 攻击包括 Vgg-16、Inc-v3、Res-50 和 Res-101 在内的 4 种模型来研究维度参数 m 的影响.

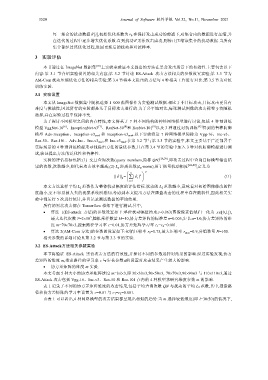

表 1 记录了不同的协方差矩阵维度的攻击结果,包括平均查询次数 QN 与扰动的平均 L 2 范数,其中,搜索路

径和协方差矩阵的学习率设置为 c=0.01 与 c 1 =c 2 =0.001.

由表 1 可以看出,4 种网络模型的攻击结果都呈现出相似的趋势:当 m 选择较低维度(即 l=30/50)的情况下,