Page 189 - 《软件学报》2021年第11期

P. 189

黄立峰 等:一种基于进化策略和注意力机制的黑盒对抗攻击算法 3515

目标模型的数据集训练一个新的替代模型,并利用替代模型为白盒场景生成对抗样本欺骗目标模型;

另一些研究 [24,25] 则专注于研究对抗样本在模型之间的迁移能力.与传统方法主要攻击神经网络输出

层的思路不同,Zhou 等人 [25] 选择对中间特征层进行攻击,通过使范数距离最大化,可以较好地提升黑

盒场景下的迁移成功率.Dong 等人 [24] 基于神经网络的平移不变性质,将替代模型计算得到的梯度向

量进行卷积操作,成功地让对抗样本躲避了大多数防御方法的检测.

(2) 基于决策反馈的攻击:该类方法约束模型只反馈预测的标签结果,目前相关的研究较少,主要思路是

将对抗样本作为初始数据来逐步逼近原始图像,在保持对抗攻击成功的前提下,不断缩小二者的距

离,直到满足攻击成功的条件.这类方法需要预设定对抗样本进行初始化,对超参数不敏感,有较强的

实用性.Brendel 等人 [33] 提出的 D-based Attack 方法通过在决策边缘寻找距离更小的对抗样本来进行

攻击.Dong 等人 [34] 提出了基于进化策略的 Face Attack 方法,该方法不依赖替代模型,也不需要对梯度

方向进行拟合,而是每次从分布中采集一个样本对模型的分类边界进行几何建模,并以此为基础判定

对抗样本的移动方向,并自适应调整步长和分布参数,对当前数据进行更新,直到满足最大迭代次数

则停止.

(3) 基于概率反馈的攻击:这类方法约束模型能输出标签的概率信息,通过与目标模型进行交互查询,观

察输出结果的置信度数值变化来拟合损失函数的梯度方向,并结合迭代攻击的思路生成对抗样本.

本小节对几种主流的梯度拟合攻击方法进行简单介绍.

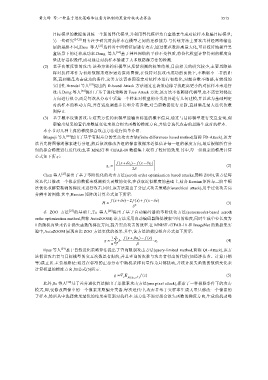

Bhagoji 等人 [26] 提出了基于有限差分的黑盒攻击方法(finite differences based method,简称 FD-Attack),该方

法首先将图像的像素进行分组,然后依次修改各组的像素数据来近似估计每一组的梯度方向,最后根据所有分

组的拟合梯度进行迭代攻击,在 MNIST 和 CIFAR-10 数据集上取得了较好的效果.其中,每一组像素的梯度计算

公式如下所示:

( f x δ + ⎡ e ) − ( f x δ − e )⎤

g ≈ ⎢ i i ⎥ (2)

i

⎣ 2δ ⎦

Chen 等人 [27] 提出了基于零阶优化的攻击方法(zeroth order optimization based attacks,简称 ZOO),该方法每

次迭代只修改一个像素的数据来观测损失函数的变化,在获取近似梯度的基础上,结合 Hessian 矩阵与二阶牛顿

法优化求解更精确的梯度来进行攻击.同时,该方法提出了分层式攻击策略(hierarchical attack),用于泛化攻击高

分辨率的图像.其中,Hessian 矩阵的计算公式如下所示:

( f x δ+ e ) 2 ( )f x− + ( f x δ− ) e

H ≈ (3)

δ 2

在 ZOO 方法 [27] 的基础上,Tu 等人 [28] 提出了基于自动编码器的零阶优化方法(autoencoder-based zeroth

order optimization method,简称 AutoZOOM).该方法采用自动编码器降低搜索空间的维度,同时生成单位长度为

1 的随机向量来估计损失函数的梯度方向,提升黑盒攻击的效率.在 MNIST、CIFAR-10 和 ImageNet 的数据集实

验中,AutoZOOM 展现出比 ZOO 方法更优的效果.其中,该方法的梯度拟合公式如下所示:

g ≈ 1 n b ⋅ ∑ ( fx β+ u i ) − f ( )x u ⋅ i (4)

n i β

Ilyas 等人 [29] 基于自然进化策略算法提出了查询限制攻击方法(query-limited method,简称 QL-Attack),该方

法假设攻击者与目标模型的交互次数是有限的,并且查询的次数与攻击者付出的代价(如经济花费、计算开销

等)成正比.主要思路是:通过在标准的正态分布中随机采样向量作为局部扰动,并统计损失函数的数值变化来

计算模型的梯度方向,如公式(5)所示.

()

g ∇≈ E 2 fz (5)

x N (| ,σ )

zx

此外,Su 等人 [30] 基于差分进化算法提出了单像素攻击方法(one pixel attack),探索了一种极限条件下的攻击

模式,即,仅修改图像中的一个像素来欺骗分类器.每次迭代中,攻击者基于父样本生成大量只修改一个像素的

子样本,然后从中选择效果最优的结果来更新对抗样本.该方法不需要拟合损失函数的梯度方向,生成的扰动噪