Page 284 - 《软件学报》2021年第9期

P. 284

2908 Journal of Software 软件学报 Vol.32, No.9, September 2021

且通过结合前两个卷积层的小尺寸卷积核与第 3 个卷积层的大尺寸卷积核,使网络能够有效地捕获低嵌入率

下的隐写噪声特征.

本文在卷积层中取消了池化层的使用,避免了池化层的下采样操作造成隐写特征的丢失.基于 Xu 等人 [14]

的研究,在 3 个卷积层后使用 TanH 函数作为激活函数,第 1 个全连接层后使用 ReLU 函数作为激活函数,通过在

浅层 TanH 函数和深层 ReLU 函数的结合使用,一定程度上提升了网络性能.

Shen-Net 网络能够对低嵌入率的隐写特征进行有效学习,并使模型最终进行正确分类,关键在于预处理层、

小尺寸卷积核和大尺寸卷积核的结合使用.预处理层中,通过 30 个高通滤波器,从低嵌入率隐写图像中提取出

30 种不同的噪声残差图像.在卷积模块中,通过小尺寸卷积核与大尺寸卷积核对噪声残差图像的卷积操作,使模

型能够有效地提取低嵌入率下微弱的隐写特征.通过对网络的层数进行一定控制,让模型的复杂度尽量缩小.同

时,Shen-Net 中,通过批量归一化操作来控制各卷积模块中的数据分布,并在网络的卷积层中,通过 TanH 函数进

行非线性激活操作,提高网络的表达能力,使网络收敛性得到有效保证.由于低嵌入率时图像中的隐写特征信息

本就非常微弱,而池化层进行下采样操作时无可避免地会对特征图的信息产生丢失,因此在 Shen-Net 中取消了

池化层,避免了池化操作所造成的隐写特征的丢失,间接地提高了模型的检测能力.通过对网络结构的合理设

计,使 Shen-Net 的模型能够对低嵌入率的隐写图像的检测能够达到很好的效果.

2.7 逐步迁移(step by step)的迁移学习

由于内容自适应隐写算法 [5−7] 会根据图像纹理特征和嵌入率,将信息从纹理最复杂的区域开始嵌入,因此

当嵌入率很低时,秘密信息会被嵌入在图像最复杂的纹理区域中,从而导致网络在训练阶段难以学习到足够的

隐写特征,使训练模型的检测效果并不理想.

本文为了进一步提升低嵌入率的检测效果,在相同的隐写算法中,通过迁移学习的方法将高嵌入率下的训

练模型作为初始参数迁移至低嵌入率的网络中进行训练,使低嵌入率的网络能够借助高嵌入率训练模型的参

数作为辅助,来提升对隐写特征的学习能力.文献[17]中,利用迁移学习的方法有效地提升了 Qian-Net [16] 的检测

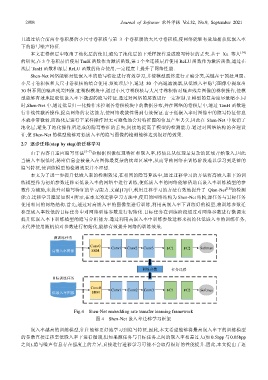

能力.迁移学习框架如图 4 所示,在本文的迁移学习方法中,使用的网络结构为 Shen-Net 结构,源任务与目标任务

使用相同的网络结构.首先,通过对高嵌入率的图像集进行训练,利用高嵌入率下训练好的模型,将训练参数迁

移至嵌入率较低的目标任务中对网络训练参数进行初始化.目标任务在训练阶段通过对网络参数进行微调来

提升低嵌入率下训练模型的隐写分析能力.通过利用高嵌入率中训练参数迁移来初始化低嵌入率的训练任务,

来代替使用随机值对参数进行初始化,能够有效提升网络的训练效果.

源训练任务

Conv0 Conv1 Conv2 Conv3 Softmax

高嵌入率图像 SRM FC1 FC2

训练参数 任务迁移

目标训练任务

Conv0 Conv1 Conv2 Conv3 FC1 FC2 Softmax

低嵌入率图像 SRM

Fig.4 Shen-Net embedding rate transfer learning framework

图 4 Shen-Net 嵌入率迁移学习框架

嵌入率越高的训练模型,往往能够更好地学习到隐写特征,因此,本文希望能够将最高嵌入率下的训练模型

的参数直接迁移至低嵌入率下进行微调,但如果源任务与目标任务之间的嵌入率相差过大(如 0.5bpp 与 0.05bpp

之间),隐写噪声信息存在强度上的差异,直接进行迁移学习可能不会取得很好的性能提升.因此,本文提出了逐