Page 193 - 《软件学报》2020年第11期

P. 193

周塔 等:基于训练空间重构的多模块 TSK 模糊系统 3509

K

x

u k () u=x k () ∑ u k′ ()x (4)

k′= 1

[2]

经常采用高斯函数作为模糊隶属函数 :

u k ()x = exp ( (x− − c k ) (2δ k ) 2 ) (5)

2

i

i A i i i

[2]

k

k

k

k

这里, c 和 δ 可通过聚类技术或其他方法获得 .如果我们采用模糊 c 均值聚类算法 [15] ,则 c 和 δ 可以表

i

i

i

i

示为

N N

i ∑

k

c = u x ji ∑ u jk (6)

jk

j= 1 j= 1

N N

2

δ = i k h u jk (x − ∑ ji c k i ) ∑ u jk (7)

j= 1 j= 1

T

[2]

其中,u jk 表示属于第 k 个簇的第 j 个输入样本 x j =(x j1 ,x j2 ,…,x jd ) 的模糊隶属度.这里,h 是尺度参数 .

k

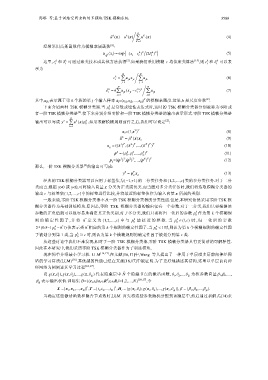

下面介绍两种 TSK 模糊分类器.当 p 是常数或线性表达式时,这时的 TSK 模糊分类器分别被称为零阶或

0

[2]

者一阶 TSK 模糊分类器 .接下来分别介绍零阶和一阶 TSK 模糊分类器的输出表示形式.零阶 TSK 模糊分类器

K

输出可以写成 y = ∑ u k ()px k 0 .如果求解模糊规则前件之后,我们可以设定 :

o

[2]

k = 1

T T

x e =(1,x ) (8)

x k = μ k ()x x (9)

e

) ,...,(

) )

= (( ) ,( x x 1 T x 2 T x K T T (10)

g

k

,

p k = (pp k ,..., p k T (11)

)

0 1 d

2 T

1 T

K T T

p g =((p ) ,(p ) ,…,(p ) ) (12)

[2]

那么,一阶 TSK 模糊分类器 的输出可写成:

0

T

y = p x g (13)

g

经典的 TSK 模糊分类器可以应用于标签集为{−1,+1}的二分类任务和{1,2,…,c}类的多分类任务.对于二分

类而言,根据 y>0 或 y<0,可将输入向量 x 分类为正类或负类.而当面对多分类任务时,我们将选取模糊分类器的

输出 c 与标签集{1,2,…,c}中的标签进行比较,并将最近的标签值作为输入向量 x 所属的类别.

一般来说,零阶 TSK 模糊分类器不及一阶 TSK 模糊分类器的分类性能.但是,本研究依然采用零阶 TSK 模

糊分类器作为基础训练模块.原因是,零阶 TSK 模糊分类器的输出仅有一个参数.对于二分类,我们只要根据该

k

参数的正负值就可以很容易地确定其正负类别.对于多分类,我们只要将归一化后的参数 p 作为第 k 个模糊规

0

k

k

*

则的确定性 因子 , 并将 h 定义为 {1,2,…,c} 中与 p 最接近的整数 . 当 p ∈ (1, )c 时 , 归一化后的实数

0

0

k

*

2*(0.5 | p− 0 k − h * |) 值表示类 h 相应的第 k 个规则的确定性因子.当 p < 时,则认为第 k 个模糊规则的确定性因

1

0

k

c

子被划分到第 1 类,当 p ≥时,则认为第 k 个模糊规则的确定性因子被划分到第 c 类.

0

从这些讨论中我们不难发现,相对于一阶 TSK 模糊分类器,零阶 TSK 模糊分类器具有更简洁的可解释性.

因此在本研究中,我们采用零阶 TSK 模糊分类器作为子训练模块.

现在简单介绍最小学习机 LLM [16,17] .在文献[16,17]中,Wang 等人提出了一种用于单层或多层前向神经网

络的学习算法(LLM) [16] .其优越的性能已经在文献[16,17]中被证明.为了更好地描述其结构,这里以单层前向神

经网络为例阐述其学习过程 [16,17] .

设 (, ), (, ),..., (,g x θ 1 g x θ 2 g x N θ ) 代表隐藏层中 N 个隐藏节点的激活函数, θ 1 , ,...,θ 2 N θ 为核参数向量β 1 ,β 2 ,…,

d

β N 表示输出权值.训练集 D={(x i ,t i )|x i ∈R ,t i ∈R,i=1,2,…,N} [16,17] ,令

T

X = [ ,x x ,..., x ] ,T = [ , ,..., ] ,tt t T H = [ ( , ), ( ,g x θ g x ),..., ( ,g x θ )],β ( ,β β = θ ,...,β ).

1 2 N 1 2 N i i 1 i 2 i N 1 2 N

当确定这些激活函数和隐含节点数时,LLM 首先将这些参数随机分配到该隐层中,然后通过求解式(14)来