Page 76 - 《软件学报》2020年第12期

P. 76

3742 Journal of Software 软件学报 Vol.31, No.12, December 2020

g to 0

41: End If

42: End for

43: Until termination criterion met

3 实验结果与分析

在实验中,我们使用公开的机器学习工具包 scikit-learn.编程语言为 python.实验电脑的配置是 Intel Core i7

CPU(3.60GHz),8G 内存;使用显卡为 NVIDIA GeForce GTX 1050.

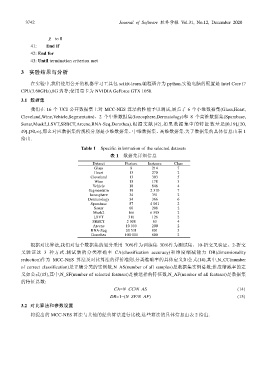

3.1 数据集

我们在 16 个 UCI 公开数据集上对 MCC-NES 算法的性能予以测试,涵盖了 6 个小维数据集(Glass,Heart,

Cleveland,Wine,Vehicle,Segmentatin)、2 个中维数据集(Ionosphere,Dermatology)和 8 个高维数据集(Spambase,

Sonar,Musk2,LSVT,SRBCT,Arcene,RNA-Seq,Dorothea).根据文献[42],如果数据集中的特征数量是[0,19],[20,

49],[50,∞],那么对应数据集的规模分别是小维数据集、中维数据集、高维数据集.关于数据集的具体信息由表 1

给出.

Table 1 Specific information of the selected datasets

表 1 数据集详细信息

Dataset Feature Instance Class

Glass 9 214 7

Heart 13 270 2

Cleveland 13 303 5

Wine 13 178 3

Vehicle 18 846 4

Segmentatin 19 2 310 7

Ionosphere 34 351 2

Dermatology 34 366 6

Spambase 57 4 061 2

Sonar 60 208 2

Musk2 166 6 598 2

LSVT 310 126 2

SRBCT 2 308 63 4

Arcene 10 000 200 2

RNA-Seq 20 531 801 5

Dorothea 100 000 800 2

根据对比算法,我们对每个数据集的划分采用 70%作为训练集 30%作为测试集、10-折交叉验证、2-折交

叉验证这 3 种方式.测试集的分类准确率 CA(classification accuracy)和维度缩减能力 DR(dimensionality

reduction)作为 MCC-NES 算法及对比算法的评价准则.分类准确率的具体定义如公式(14),其中,N_CC(number

of correct classification)是正确分类的实例数,N_AS(number of all samples)是数据集实例总数;维度缩减率的定

义如公式(15),其中,N_SF(number of selected features)是被选择的特征数,N_AF(number of all features)是数据集

的特征总数:

CA=N_CC/N_AS (14)

DR=1−(N_SF/N_AF) (15)

3.2 对比算法和参数设置

将提出的 MCC-NES 算法与其他的经典算法进行比较,这些算法的具体信息由表 2 给出.