Page 111 - 《武汉大学学报(信息科学版)》2025年第6期

P. 111

第 50 卷第 6 期 朱 军等:结构语义特征约束的地震灾害 AR 场景精准建模方法 1133

2.2.2 结构语义特征匹配分析 确匹配点对数如表 2 所示。

在虚实位姿解算过程中,需根据提取结果对 由 图 11 和 表 2 可 以 看 出 ,ORB、Harris、ED‑

虚实特征进行匹配以获得特征对。本文分别采 Lines+RANSAC 方法受到异质性虚实图像的影

用 现 有 的 4 种 主 流 匹 配 方 法 SURF [28] 、ORB [29] 、 响,特征描述符无法准确描述特征,匹配精度较

Harris [30] 、EDLines+RANSAC [31] 与 本 文 方 法 进 低。SURF 方法使用质量较高的三维重建模型的

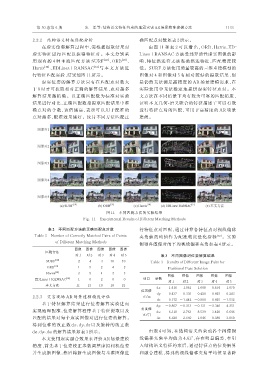

行特征匹配实验,结果如图 11 所示。 图像对 4 和图像对 5 有相对较好的提取结果,但

虚实位姿的解算方法只有在匹配点对数大 是仍然无法满足高精度的 AR 场景建模需求,在

于 8 时才可获取相对正确的解算结果,点对越多 实际使用中无法稳定地提供虚实特征点对。本

解算结果越精确。以正确匹配数为标准对实验 文方法在不同情景下均有较为可靠的匹配精度,

结果进行对比,正确匹配数指提取匹配结果中准 证明本文几何-语义联合的特征描述子可以有效

确点对的个数,该值越高,表示可以用于配准的 进行特征点对的匹配,可用于高精度的 AR 场景

点对越多,配准效果越好。统计不同方法匹配正 建模。

图 11 不同匹配方法的实验结果

Fig. 11 Experimental Results of Different Matching Methods

表 2 不同匹配方法的正确匹配点对数 行特征点对匹配,通过计算各特征点对视线偏移

Table 2 Number of Correctly Matched Pairs of Points 夹角值的均值作为配准精度量化指标 [32] 。实验

of Different Matching Methods

测得各图像对的平均视线偏移夹角如表 4 所示。

图像 图像 图像 图像 图像

匹配方法

对 1 对 2 对 3 对 4 对 5 表 3 不同图像对位姿解算结果

[28]

SURF 2 4 3 10 10 Table 3 Results of Different Image Pairs for

ORB [29] 1 5 2 4 2

Positional Pose Solution

Harris [30] 3 5 4 2 2

图像 图像 图像 图像 图像

[31] 项目 参数

EDLines+RANSAC 1 0 2 0 0

对 1 对 2 对 3 对 4 对 5

本文方法 11 13 10 18 21

dx −1.416 1.061 −1.608 −0.654 −1.070

位置修

dy 0.437 −0.339 −0.420 0.865 −0.243

2.2.3 灾害现场 AR 场景建模精度评估 正/m

dz 0.172 −1.442 −0.800 0.665 −1.532

基于特征解算结果进行位姿解算实验进而 dφ −0.867 −0.213 −0.131 −2.340 4.251

实现地理配准,位姿解算程序基于特征提取以及 角度修 dω 6.318 2.763 −8.539 3.420 6.646

正/(°)

匹配的结果对每个虚实图像对进行位姿的解算。 dκ −6.520 −2.550 −1.046 0.380 −3.850

得到位移的改正数 dx、dy、dz 以及旋转的改正数

dκ、dφ、dω 的解算结果如表 3 所示。 由表 4 可知,在结构语义约束前各个图像视

本文使用虚实融合效果来评价 AR 场景建模 线偏移夹角平均值为 4.63°,存在明显偏差,在引

精度,首先基于位姿校正参数调整虚拟相机位姿 入结构语义特征约束后,通过特征点的位姿解算

并生成新图像,然后将新生成图像与基准图像进 和融合建模,得到的视线偏移夹角平均值显著降