Page 320 - 《软件学报》2025年第12期

P. 320

钱忠胜 等: 结合时间间隔数据增强的对偶视图自监督会话推荐模型 5701

例 5: 用户购买了书、钢笔、信纸、书桌. 我们认为可把“书桌”替换为“书架”, 以谋求推荐对于阅读类偏好物

品建立联系.

利用时间间隔信息进行数据增强的具体过程见算法 1.

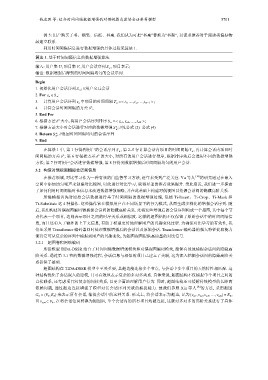

算法 1. 基于时间间隔信息的数据增强算法.

输入: 用户集 U, 项目集 V, 用户会话序列 S u , 项目表示;

输出: 数据增强后得到的时间间隔均匀的会话序列.

Begin

1. 初始化用户会话序列 S u ; //用户交互会话

2. For s u ∈ S u :

3. 计算用户会话序列 s u 中项目的时间间隔 T u =< t 1 ,...,t j ,...,t N−1 >;

2

4. 计算会话时间间隔的方差 δ ;

5. End For

2

6. 根据方差 δ 大小, 将用户会话序列排序 S u =< s u1 , s u2 ,..., s uN >;

S ; //见公式 (2)–公式 (4)

a

7. 根据方差大小对会话进行对应的数据增强 u

8. Return S ; //返回时间间隔均匀的会话序列

a

u

9. End

在算法 1 中, 第 1 行得到用户的会话序列 S u ; 第 2–5 行计算会话内项目的时间间隔 T u , 再计算会话内项目时

δ ; 第 6 δ 的大小, 对所有的用户会话进行排序, 根据排序先后会选用不同的数据增强

2

2

间间隔的方差 行根据方差

方法; 第 7 行对用户会话进行数据增强; 第 8 行得到数据增强后时间间隔均匀的用户会话.

3.2 构造对偶视图捕捉会话间信息

在推荐领域, 对比学习作为一种有效的自监督学习方法, 近年来受到广泛关注. Yu 等人 [30] 的研究通过在嵌入

空间中添加均匀噪声来创建对比视图, 以此进行对比学习, 取得显著的推荐效果提升. 受此启发, 我们进一步探索

了如何利用时间间隔时长信息来改进数据增强策略, 并在此基础上构建对偶视图以挖掘会话间的隐藏高阶关系.

所提模型首先对原始会话数据进行基于时间间隔的数据增强处理, 包括 Ti-Insert、Ti-Crop、Ti-Mask 和

Ti-Substitute 这 4 种操作. 这些操作旨在模拟用户在不同场景下的行为模式, 从而生成多样化的增强会话序列. 随

后, 我们构建对偶视图编码器捕捉会话间的隐藏高阶关系. 先将这些增强后的会话序列构成一个超图, 其中每个节

点代表一个项目, 边则表示项目之间的时序关系或相似度. 这样的超图结构不仅保留了原始会话中的时间间隔信

息, 而且还引入了额外的上下文信息, 有助于模型更好地理解用户的兴趣变化过程. 为确保对比学习的有效性, 我

们还采用 Transformer 编码器同时处理数据增强后的会话以及原始会话. Transformer 编码器的强大特征提取能力

使得它可从复杂的序列中捕捉到用户的兴趣变化, 为超图视图提供高质量的对比信号.

3.2.1 超图卷积网络编码

所提模型 TIDA-DSSR 结合了时间间隔数据增强模块和对偶视图编码模块, 能够有效地捕捉会话间的隐藏高

阶关系. 通过第 3.1 节的数据增强过程, 会话信息与相似的项目已建立了关联, 这为深入挖掘会话间的隐藏高阶关

系提供了基础.

超图结构在 TIDA-DSSR 模型中至关重要, 其超边能连接多个节点, 与会话中多个项目的天然特性相匹配. 这

种结构优化了会话嵌入的建模, 且可有效地表示复杂的多对多关系. 具体来说, 超图结构不仅捕捉单个项目之间的

直接联系, 还考虑项目间复杂的间接关系, 以更全面地理解用户行为. 同时, 超图结构还可缓解传统模型的长距离

依赖问题, 通过超边连接增强了模型对长会话序列关联的捕捉能力. 故我们参照 Xia 等人 [8] 的方法, 采用超图

G h = (V h ,E h ) 来表示所有会话, 捕捉会话中的这种关系. 形式上, 将会话表示为超边, 记为 {v s,1 ,v s,2 ,v s,3 ,...,v s,m } ∈ E h ,

且 v s,m ∈ V h . 在将会话信息转换为超图后, 单个会话内的所有项目均被连接, 这就对多对多的高阶关系进行了具体