Page 288 - 《软件学报》2025年第10期

P. 288

李靓果 等: 结合大语言模型和领域知识库的证券规则规约方法 4685

先, 我们确定了要评估的业务和数据集. 随后, 在领域专家完成对比实验后, 我们共同对需求规约和依赖关系进行

了修改和最终确认. 我们的目标是通过这种方法覆盖证券领域内多样化的业务场景, 以确保评估数据集和评估实

验的代表性和有效性.

在对比对象的选择上, 鉴于目前证券领域业务规则的规约实际上完全依赖于人工进行, 不存在其他规约生成

工具作为对比基准, 我们考虑将本文方法与人类参与者以及通用大型语言模型 GPT-4 和 GLM-4 [26] 的规约结果进

行对比分析. 参与实验的人类参与者包括 3 位领域专家和 2 位非专家. 领域专家来自国泰君安证券股份有限公司

的测试部门, 拥有平均 5–7 年的证券行业工作经验. 非专家则由平均具备 1–2 年工作经验但并非专门从事证券领

域工作的研发人员组成. GPT-4 是目前最优秀的大语言模型之一, GLM-4 是清华大学研发的中文大语言模型, 曾

登顶过中文大模型评估基准 c-eval 榜单. 我们使用大语言模型端到端地处理数据集中的业务规则, 从而生成规约.

参与实验的大语言模型的详细的版本说明如表 3 所示, 其中, GPT-4 和 GLM-4 将参与所有的 4 个实验, 而 Mengzi-

[18] [27]

BERT-base-fin 和 Llama 2 将在实验 2 中被用到.

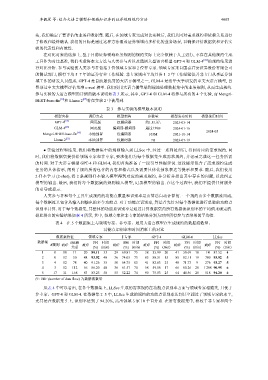

表 3 参与实验的模型版本说明

模型名称 调用方式 模型架构 参数量 模型发布时间 模型使用时间

[14]

GPT-4 网页版 仅解码器 约1.8万亿 2023-03-14

[26]

GLM-4 网页版 编码器-解码器 超过130B 2024-01-16

2024-05

[18]

Mengzi-BERT-base-fin 本地部署 仅编码器 103M 2021-10-14

[27]

Llama 2 本地部署 仅解码器 7B 2023-07-19

● 实验过程和结果. 我们将数据集中的规则输入到 LLSec 中, 经过一系列处理后, 得到对应的需求规约. 同

时, 我们将数据集提供给领域专家和非专家, 要求他们为每个数据集生成需求规约, 并记录完成这一任务所需

的时间. 对于大语言模型 GPT-4 和 GLM-4, 我们首先准备了一段引导性提示词. 这段提示包含了需求规约生成

任务的具体指示, 阐明了规约所需包含的内容和格式以及需要具体化抽象表达等提示和要求. 随后, 我们使用

2 样本学习 (2-shot), 将 2 条规则样本输入模型得到对应的需求规约, 并分析并指出其中存在的问题, 以此纠正

模型的输出. 最后, 我们将每个数据集的规则输入模型, 记录模型的输出. 在这个过程中, 我们不提供任何额外

的引导或提示.

人类参与者和每个工具生成规约的功能点数量和识别率是由算法自动计算的. 一个规约由多个数据流组成,

每个数据流又包含从输入到输出的多个功能点. 对于功能点识别率, 算法首先针对每个数据流进行单独的功能点

识别率计算. 对于每个数据集, 其整体的功能点识别率是通过计算数据集内所有数据流识别率的平均值来确定的.

据此得出的实验结果如表 4 所示, 其中, 领域专家和非专家的结果分别为对应所有参与者结果的平均值.

表 4 在 5 个数据集上与领域专家、非专家、通用大语言模型在生成规约的数据流数量、

功能点识别率和时间消耗上的对比

数据集特征 领域专家 非专家 GPT-4 GLM-4 LLSec

数据集 #依赖 FPI 时间 FPI 时间 FPI 时间 FPI 时间 FPI 时间

#规则 #DF #DF #DF #DF #DF #DF

关系 (%) (min) (%) (min) (%) (min) (%) (min) (%) (min)

1 0 10 11 20 89.11 33 29 69.81 75 38 55.99 20 41 50.69 18 14 87.52 4

2 0 12 50 48 93.92 40 36 74.05 73 85 80.31 15 88 82.11 19 700 93.92 5

3 4 12 78 40 91.26 35 50 64.75 85 41 82.63 25 48 71.73 9 276 93.27 5

4 3 12 112 56 86.20 40 36 61.57 70 58 59.56 17 66 60.26 20 1 288 90.95 6

5 17 11 168 83 83.25 50 55 52.22 74 90 75.83 25 64 40.56 20 518 94.20 6

注: #DF (number of data flow) 为数据流数量

从表 4 中可以看出, 在各个数据集上, LLSec 生成的需求规约在功能点识别率方面与领域专家相媲美, 且优于

非专家、GPT-4 和 GLM-4. 在数据集 2–5 中, LLSec 生成的规约的功能点识别率达到甚至超过了领域专家的水平,

尤其是在数据集 5 上, 识别率达到了 94.20%, 高出领域专家 10 个百分点. 在所有数据集中, 相较于非专家和两个