Page 484 - 《软件学报》2025年第9期

P. 484

朱建秋 等: 视觉注意力和域特征融合的人脸活体检测方法 4395

长度为 10 s, 帧率为 30 Hz, 分辨率大小为 720×480. 攻击方式包括照片打印攻击和视频回放攻击, 在照片打印攻击

中, 使用分辨率为 5184×3456 的高清晰度照片作为攻击媒介, 视频回放攻击分为高清晰度和低清晰度重放视频攻

击两种方式.

另外, 本文引用活体检测领域常用评估指标来评估所提模型的性能, 主要包括半错误率 (half total error rate,

HTER) 和受试者工作特征曲线下面积 (area under curve, AUC). 错误拒绝率 (false rejection rate, FRR) 和错误接收

率 (false acceptance rate, FAR) 是相关评估指标, 分别表示将正样本预测为负样本的概率和将负样本预测为正样本

的概率, FRR 和 FAR 通常成反比关系, 为了综合评价算法的好坏, 引入了 HTER 和 EER 作为衡量指标. HTER 为 FAR

和 FRR 的均值, 计算公式为:

FAR+ FRR

HTER = (13)

2

受试者工作特征曲线 (receiver operating characteristic, ROC) 是一种用于分析分类模型性能的工具, 将假阳率

(false positive rate, FPR) 作为 X 轴, 将真阳率 (true positive rate, TPR) 作为 Y 轴, 其中 FPR 表示被错误预测为正样

本的负样本数目占所有负样本数量的比率, TPR 表示被正确分类为正样本的正样本数目占所有正样本数量的比

率. 评估指标 AUC 则为 ROC 曲线下与坐标轴围成的面积, 取值范围 [0,1], AUC 越接近 1, 检测方法真实性越高.

3.2 实验设置

为了验证所提方法的有效性, 本文实验在 CASIA-FASD、Replay-Attack、OULU-NPU 和 MSU-MFSD 数据集

上进行了测试, 采用 HTER 和 AUC 作为评估标准. 对于视频数据, 本文以特定的时间间隔进行取帧, 获取图像格式

的数据后, 采用 MTCNN 进行人脸检测, 然后将人脸进行裁剪和调整为 256×256 作为输入. 本文实验在 NVIDIA

RTX 3090 显卡上进行, 网络结构利用 PyTorch 框架进行实现, 损失的优化器是 Adam. 实验具体的超参数设置如

表 1 所示.

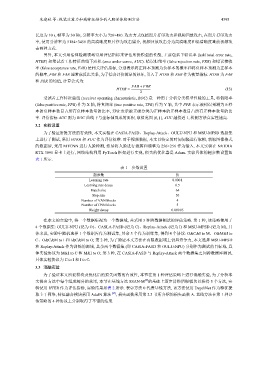

表 1 参数设置

超参数 值

Learning rate 0.000 1

Learning rate decay 0.5

Batch size 64

Step size 50

Number of VAN blocks 4

Number of CNN blocks 3

Weight decay 0.000 05

在本文的实验中, 将一个数据集视为一个数据域, 共采用 3 种跨数据测试的评估策略. 第 1 种, 该策略使用了

4 个数据集: OULU-NPU (记为 O)、CASLA-FASD (记为 C)、Replay-Attack (记为 I) 和 MSU-MFSD (记为 M), 具

体来说, 实验中随机选择 1 个数据库作为测试集, 其余 3 个作为训练集, 得到 4 个协议: O&C&I to M、O&M&I to

C、O&C&M to I 和 I&C&M to O; 第 2 种, 为了验证本文方法在有限数据域上仍具竞争力, 本文选择 MSU-MFSD

和 Replay-Attack 作为训练的源域, 其余两个数据集 (即 CASIA-FASD 和 OULU-NPU) 分别作为测试的目标域, 具

体实验协议为 M&I to C 和 M&I to O; 第 3 种, 在 CASIA-FASD 与 Replay-Attack 两个数据集之间跨数据库测试,

具体实验协议为 C to I 和 I to C.

3.3 消融实验

为了验证本文所提模块及优化后的损失函数的有效性, 本节在第 1 种评估策略上进行消融实验, 为了分析本

[8]

文提出方法中每个组成部分的效果, 本节在基线方法 SSAN-M 的基础上逐步替换所提模块以获得 5 个方法, 实

验使用 HTER 作为评估指标, 实验结果如表 2 所示. 表中方法 0 代表基线方法, 该方法使用 DepthNet 作为特征提

取主干网络, 特征融合模块采用 AdaIN 算法 [27] , 损失函数采用第 2.3 节所介绍的损失函数 A. 基线方法在第 1 种评

估策略的 4 种协议上分别取得了不错的结果.