Page 481 - 《软件学报》2025年第7期

P. 481

3402 软件学报 2025 年第 36 卷第 7 期

识别的视频以获取稳定的视频传输特征来训练模型, 且对于所有新视频也都要进行相应的训练. 而本文方法只需

要对各个平台的少量数据进行 1 次训练即可获取特征修正参数, 从而对平台中的新视频进行识别.

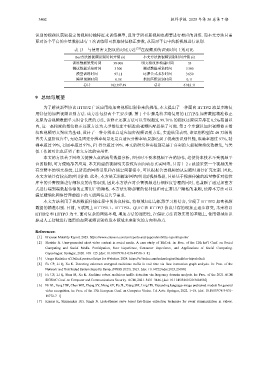

表 13 与使用密文指纹的对比方法 [25] 在视频系统识别时间上的对比

Bae方法的视频识别时间开销 (s) 本文方法的视频识别时间开销 (s)

训练数据采集时间 99 000 明文指纹库构建时间 33

测试数据采集时间 3 300 测试数据采集时间 3 300

模型训练时间 97.11 还原公式求参时间 3 650

模型预测时间 0.38 指纹匹配识别时间 0.11

总计 102 397.49 总计 6 983.11

9 总结与展望

为了解决新型协议 HTTP/2 广泛应用给加密视频识别带来的挑战, 本文提出了一种面向 HTTP/2 流量多路复

用特征的加密视频识别方法. 该方法包括两个主要步骤. 第 1 个步骤是将多路复用的 HTTP/2 加密数据精准修正

还原为音视频数据单元组合长度的方法, 该修正还原方法可以实现超过 99.70% 的指纹还原误差都在 0.5‰范围以

内, 这一高精度的指纹修正还原方法为大型指纹库中精准的视频匹配提供了可能. 第 2 个步骤以加密视频修正指

纹和视频明文指纹为基础, 设计了一种分辨率自适应加密视频识别方法, 实验结果表明, 该识别模型在 40 万级的

真实大型指纹库中, 无论是固定分辨率场景还是自适应分辨率场景都达到了较高的识别性能, 准确率超过 97%, 精

确率超过 99%, 召回率超过 97%, F1 得分超过 99%. 本文的研究和实验都是基于真实的大型视频指纹数据集, 与类

似工作的对比也证明了本文方法的实用性.

本文的方法基于网络关键接入点的流量数据分析, 应用时不要求视频平台的协作, 这使得本技术不受视频平

台的限制, 可方便地部署应用. 本文构建的视频明文指纹库面向动态真实网络, 只需 1–2 s 就能采集一个视频的所

有分辨率的明文指纹, 且所需的网络带宽和存储空间都很小, 可以根据公害视频的认定随时进行扩充更新. 因此,

本文方法具有较高的应用价值. 此外, 本方法无须解密网络应用层视频数据, 只是基于视频传输的流量特征对指纹

库中的公害视频进行细粒度的内容识别, 因此本方法在对公害视频进行细粒度管理的同时, 也兼顾了通过加密方

式进行端到端数据传输的正常用户的隐私. 本方法实际部署的便利性和对正常用户隐私的兼顾, 使得本方法可以

满足精细化网络管理前提下的互联网信息共享需求.

本文方法利用了视频数据传输过程中的协议特征, 将领域知识与机器学习相结合, 实现了 HTTP/2 加密视频

数据的精准识别. 目前, 互联网上 HTTP/1.1、HTTP/2、QUIC 和 HTTP/3 协议共存的现象正逐步演变, 未来将以

HTTP/2 和 HTTP/3 为主. 面对复杂的网络环境, 增加方法的通用性, 在保证方法高效实用的基础上, 使用领域知识

驱动人工智能进行通用的加密视频识别将是本领域未来研究的方向和热点.

References:

[1] Ericsson Mobility Report. 2023. https://www.ericsson.com/en/reports-and-papers/mobility-report/reports/

[2] Shutsko A. User-generated short video content in social media. A case study of TikTok. In: Proc. of the 12th Int’l Conf. on Social

Computing and Social Media. Participation, User Experience, Consumer Experience, and Applications of Social Computing.

Copenhagen: Springer, 2020. 108–125. [doi: 10.1007/978-3-030-49576-3_8]

[3] Usage Statistics of Default protocol https for Websites. 2024. https://w3techs.com/technologies/details/ce-httpsdefault

[4] Fu CP, Li Q, Xu K. Detecting unknown encrypted malicious traffic in real time via flow interaction graph analysis. In: Proc. of the

Network and Distributed System Security Symp. (NDSS 2023). 2023. [doi: 10.14722/ndss.2023.23080]

[5] Fu CP, Li Q, Shen M, Xu K. Realtime robust malicious traffic detection via frequency domain analysis. In: Proc. of the 2021 ACM

SIGSAC Conf. on Computer and Communications Security. ACM, 2021. 3431–3446. [doi: 10.1145/3460120.3484585]

[6] Ni BL, Peng HW, Chen MH, Zhang SY, Meng GF, Fu JL, Xiang SM, Ling HB. Expanding language-image pretrained models for general

video recognition. In: Proc. of the 17th European Conf. on Computer Vision. Tel Aviv: Springer, 2022. 1–18. [doi: 10.1007/978-3-031-

19772-7_1]

[7] Kumar K, Shrimankar DD, Singh N. Eratosthenes sieve based key-frame extraction technique for event summarization in videos.