Page 480 - 《软件学报》2025年第7期

P. 480

吴桦 等: 面向 HTTP/2 流量多路复用特征的加密视频识别方法 3401

表 11 中的实验 1 中, 本文使用了与表 10 中的实验 1 相同的数据集, 并且设置了相同的训练集样本容量. 表 10 中

的实验 1 采用随机的方式划分训练集和测试集, 而表 11 中的实验 1 采用分类的方式划分, 分类的依据为采集过程

中视频是否发生了分辨率切换从而导致其流量模式发生改变. 将采集过程中流量模式未发生改变的 30 条数据样

本作为训练集, 其余作为测试集. 通过这种划分方式, 可以使训练集中的数据样本的流量模式较为单一, 通常为固

定分辨率的视频数据样本.

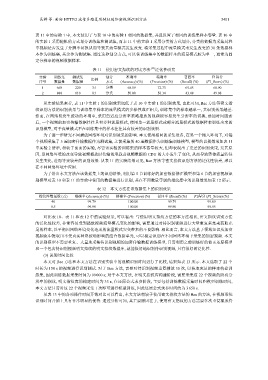

表 11 使用密文指纹的对比方法 [25] 泛化性研究

实验 训练集 测试集 比例 划分 准确率 精确率 召回率 F1得分

序号 数据量 数据量 方式 (Accuracy) (%) (Precision) (%) (Recall) (%) (F1_Score) (%)

1 660 220 3:1 分类 68.19 72.73 65.45 68.90

2 880 110 8:1 分类 50.00 56.34 43.48 49.08

从实验结果来看, 表 11 中实验 1 的识别效果远低于表 10 中实验 1 的识别效果, 由此可知, Bae 方法等密文指

纹识别方法的识别效果与训练集中样本的流量模式的多样性成正相关, 训练集中的样本越单一, 其识别效果越差.

然而, 在网络易发生波动的环境中, 采用自适应分辨率策略播放的视频很容易发生分辨率的切换, 叠加时间因素

后, 一个视频的加密传输数据往往具有多种流量模式, 使用单一流量模式或部分流量模式的数据样本训练出来的

识别模型, 对于流量模式不在训练集中的样本往往具有较差的识别效果.

为了进一步研究不同播放网络环境对识别效果的影响. 本文使用相同的采集设备, 在另一个接入环境下, 对每

个视频采集了 5 遍加密传输数据作为测试集, 之前采集的 40 遍数据作为训练集训练模型, 模型的识别效果如表 11

中实验 2 所示, 相较于前面的实验, 尽管该实验的训练集的样本容量较大, 但却表现出了更差的识别效果, 究其原

因, 是网络环境的改变导致视频播放时传输的承载音视频数据的 CDU 的大小发生了变化, 从而导致整体流量特征

发生变化, 进而导致较差的识别效果. 从表 11 的实验结果可见, Bae 方法等密文指纹识别方法的泛化性较差, 难以

在不同网络环境中应用.

为了给出本文方法在该数据集上的识别结果, 利用第 5 节训练好的加密数据修正模型和第 6 节的加密视频识

别模型对表 10 和表 11 的实验中使用的数据集进行识别, 其在不同数量等级的指纹库中的识别效果如表 12 所示.

表 12 本文方法在该数据集上的识别效果

指纹库数量级 (万) 准确率 (Accuracy) (%) 精确率 (Precision) (%) 召回率 (Recall) (%) F1得分 (F1_Score) (%)

40 99.79 100.00 99.79 99.89

0.5 99.90 100.00 99.90 99.95

对比表 10、表 11 和表 12 中的实验结果, 可以看出: 与使用明文指纹方法的本方法相比, 密文指纹识别方法

的泛化性较差, 非常容易受到播放视频流量模式变化的影响, 需要通过对待识别视频进行大量重复采集来获取充

足的样本, 以平衡因网络环境变化造成的流量模式突变带来的不良影响. 相比而言, 本文方法基于领域知识从加密

视频流中提取出不受真实网络波动影响的组合数据单元, 可以稳定识别在不同网络环境下采集的加密视频. 本文

的识别模型不需要重复、大量地采集待识别视频的加密传输数据训练模型, 只需利用之前训练好的修正还原模型

和一个包含待识别视频明文指纹的明文指纹数据库, 就能很好地识别待识别视频, 具有很好的泛化性.

(3) 识别时间比较

本文对 Bae 方法和本文方法在识别实验中的视频识别时间进行了比较, 结果如表 13 所示. 本文选取了 22 个

时长为 150 s 的视频进行识别测试. 对于 Bae 方法, 需要对待识别视频重复播放 30 次, 以获取充足的样本构建训

练集, 因此训练数据采集时间为 99 000 s; 对于本文方法, 在明文指纹库构建阶段, 需要采集这 22 个视频的所有分

辨率的指纹, 明文指纹库的构建时间为 33 s, 在还原公式求参阶段, 主要包括训练数据采集时间和模型训练时间,

本文方法只需对这 22 个视频采集 1 次即可进行模型训练, 因此还原公式求参时间约为 3 650 s.

从表 13 中的各项操作时间开销对比可以看出, 本文方法相较于使用密文指纹方法的 Bae 的方法, 在视频系统

识别时间开销上具有非常明显的优势. 通过分析可知, 其主要原因在于, 使用密文指纹的方法需要多次重复播放待